Reviews

Buffalo LinkStation 421

Введение

Не так давно в нашей тестовой лаборатории уже побывало сетевое хранилище компании Buffalo – TeraStation 5600, ориентированное больше на применение в корпоративном сегменте. Сегодня же мы представляем более простую модель для домашних пользователей – LinkStation 421 с двумя SATA дисками.

Внешний вид

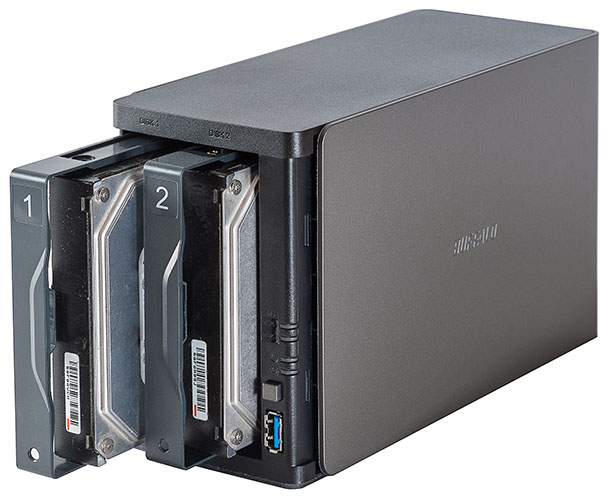

Сетевое хранилище LS421DE представлено в стандартном для подобного рода устройств пластиковом корпусе со скруглёнными углами, габариты которого составляют 87х128х205 мм. Для своей работы устройство использует внешний блок питания со следующими характеристиками: 12В и 4А.

Верхняя и боковые поверхности ничем не примечательны, пожалуй, кроме объёмного названия фирмы-производителя по бокам. На днище устройства размещена одна огромная прорезиненная «ножка» и наклейка с краткой информацией об устройстве.

Лицевая панель съёмная, за ней скрываются две пластиковые корзинки для установки жёстких дисков, а также два неиспользуемых индикатора работы жёстких дисков. На самой лицевой панели расположены индикаторы Power и Function отображающие состояние устройства. Также здесь расположена кнопка, предназначенная для отключения USB-устройств и инициализации настроек. Под индикаторами и кнопкой располагается разъём USB 3.0.

На задней панели хранилища размещён вентилятор 60 мм, переключатель для включения/выключения устройства, порт USB 2.0, разъём для подключения питания, а также держатель для шнура. Кроме того здесь находится сетевой интерфейс Gigabit Ethernet и Кенсингтонский замок.

Заглянем теперь внутрь устройства.

Аппаратная платформа

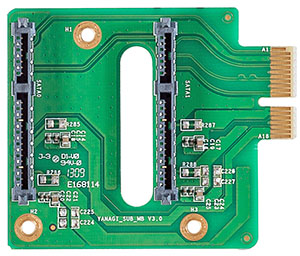

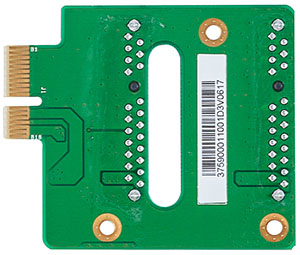

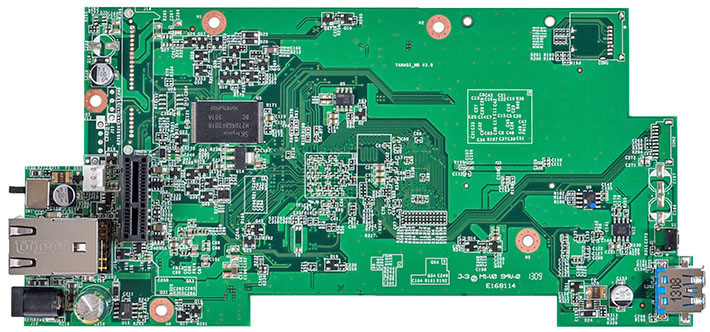

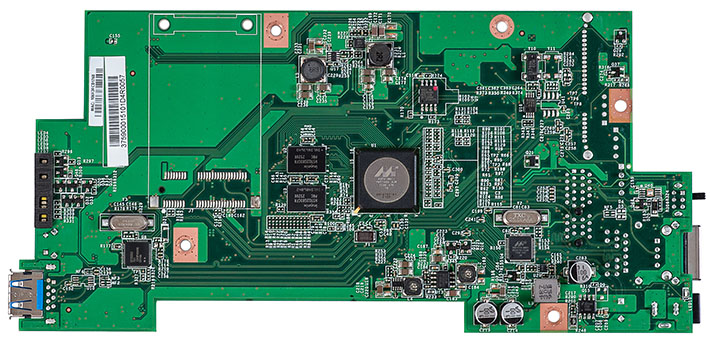

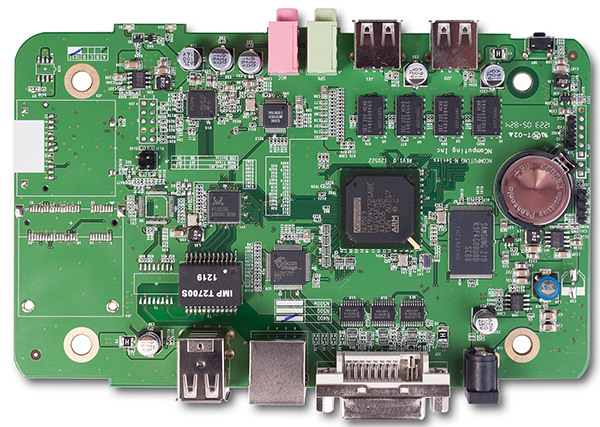

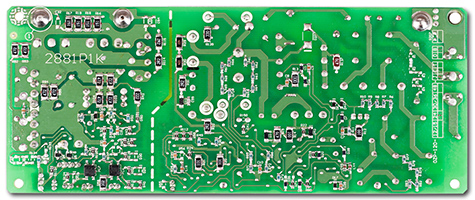

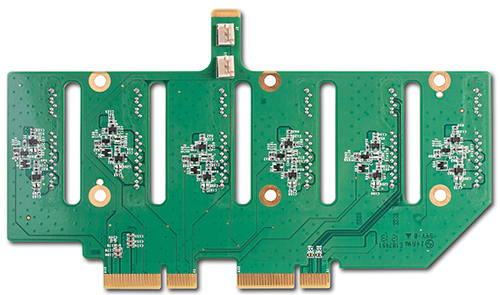

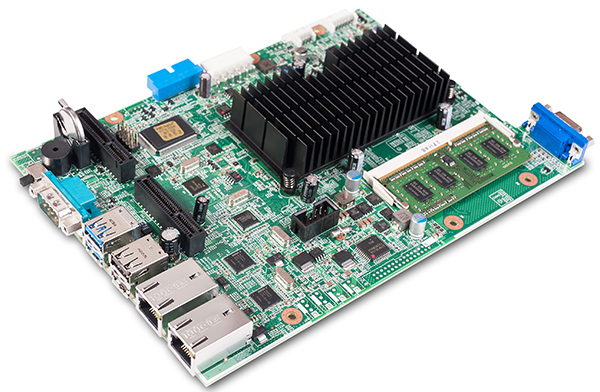

Электронная начинка Buffalo LinkStation 421 состоит из двух зелёных текстолитовых плат, одна из которых выполняет исключительно функции переходника, позволяя подключать жёсткие диски к основной плате.

На основной плате электронные компоненты располагаются с обеих сторон. В качестве флеш-памяти использован чип SK Hynix H27U4G8F2DTR, объём которого составляет 512 Мбайт.

LinkStation 421 построен на базе процессора Marvell 88F6707, работающего на частоте 1.2 ГГц, функции оперативной памяти выполняют два DDR3 чипа Hynix H5TQ2G83CFR по 256 Мбайт, таким образом общий объём доступной хранилищу оперативной памяти составляет 512 Мбайт. Сетевая карта построена на базе гигабитного модуля Marvell Alaska 88E1518. За работу порта USB 3.0 отвечает чип NEC/RENESAS D720202.

На этом мы завершаем рассмотрение аппаратной архитектуры сетевого хранилища LinkStation 421 и переходим к изучению его программных возможностей.

Обновление прошивки, утилиты и начало работы

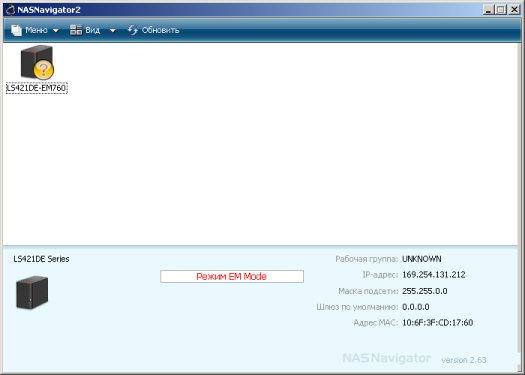

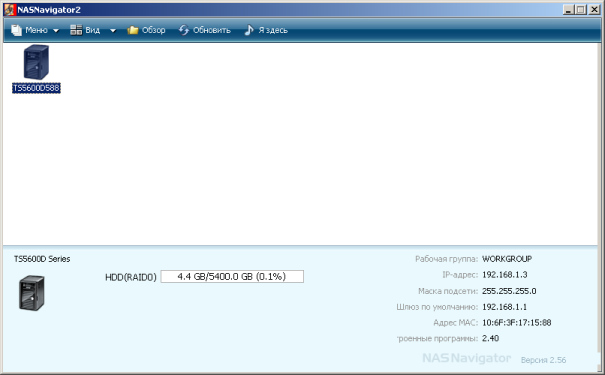

После того, как пользователь приобрёл новое сетевое хранилище Buffalo LinkStation 421, ему будет необходимо провести процедуру подготовки устройства к работе. Для чего сначала требуется установить чистые диски в хранилище, включить его и дождаться полной загрузки со встроенной флеш-карты. После завершения первоначальной загрузки (горят оба индикатора на передней панели устройства: один белый, другой красный), необходимо нажать кнопку Function, что приводит к началу инициализации дисков устройством. Сама инициализации представляет собой создание разделов и перенос микропрограммного обеспечения на жёсткие диски, откуда впоследствии и будет производиться полноценная загрузка хранилища. Единственный горящий белый индикатор на передней панели сигнализирует об успешном завершении всех подготовительных процедур и загрузке LinkStation 421. Стоит отметить, что даже до инициализации дисков тестируемое устройство обнаруживалось утилитой NASNavigator2.

Весь процесс подготовки занимает порядка десяти минут.

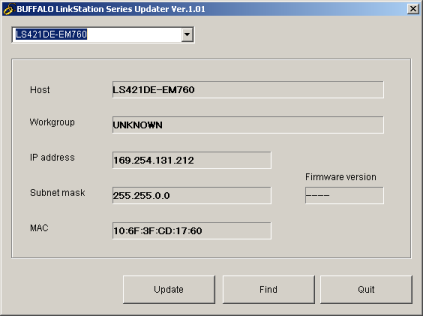

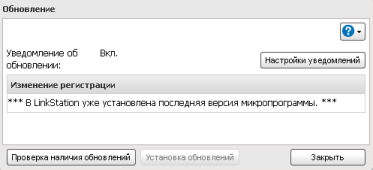

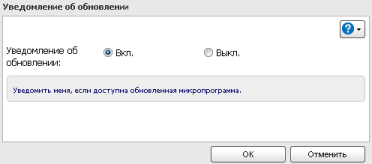

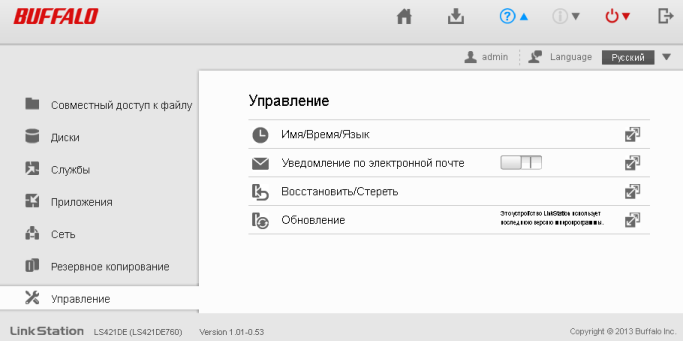

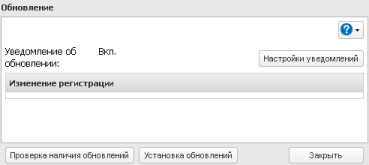

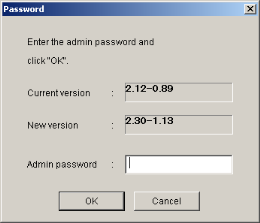

Обновить прошивку работающего хранилища можно с помощью утилиты LSUpdater, либо путём обращения к пункту «Обновление» меню «Управление» веб-интерфейса устройства. Стоит, правда, отметить, что в этом случае LinkStation 421 должен иметь подключение к глобальной сети.

Традиционно мы рекомендуем периодически производить обновление микропрограммного обеспечения, так как в новых версиях не только появляются новые функции, но также закрываются и обнаруженные ошибки и уязвимости.

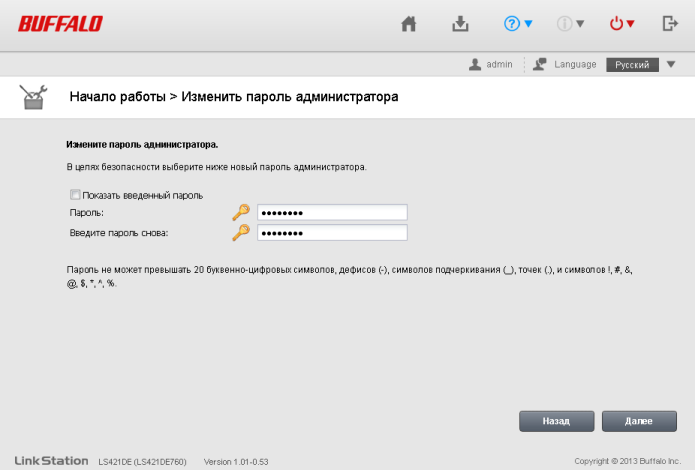

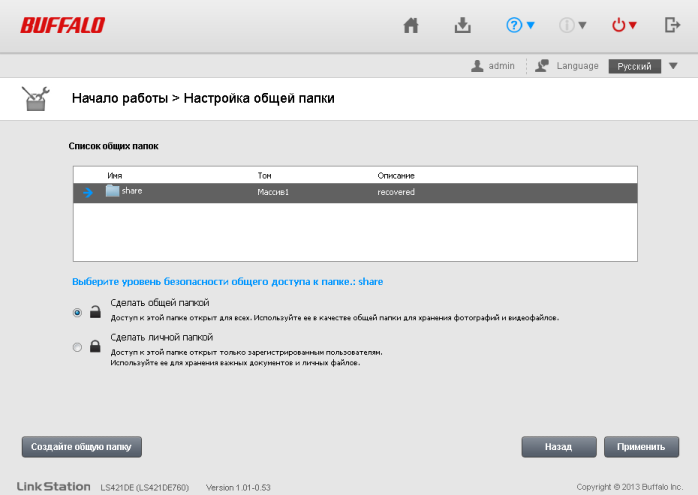

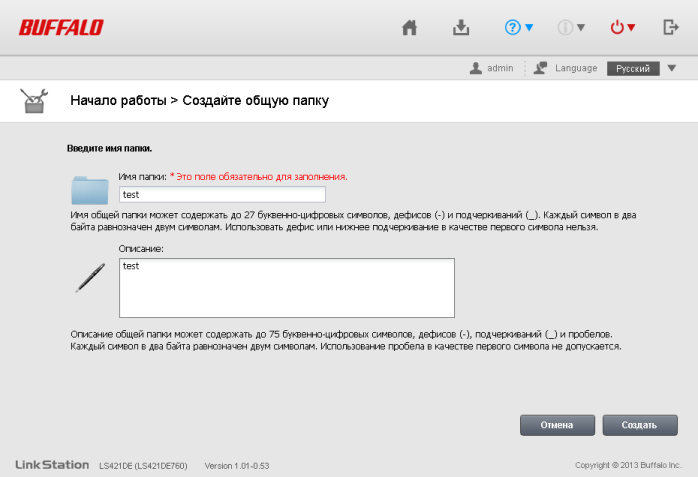

После того, как прошивка была установлена, необходимо перейти к первоначальной настройке оборудования, для чего можно обнаружить хранилище в сети с помощью NASNavigator2 и обратиться к веб-интерфейсу тестируемой модели, где пользователю будет доступен мастер предварительной настройки.

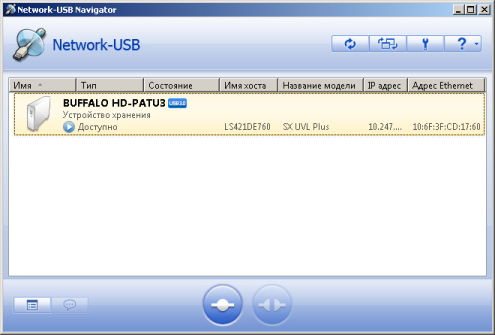

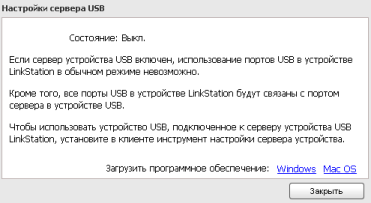

Ещё одной утилитой, которая может оказаться крайне полезной для пользователя, является Network-USB Navigator, позволяющая обнаружить в локальной сети хранилища Buffalo с подключенными USB-устройствами. Такое обнаружение может потребоваться в ситуации, когда пользователь желает виртуально подключить эти устройства к своему ПК.

На этом мы завершаем рассмотрение процедуры подготовки хранилища к работе и переходим к рассмотрению возможностей веб-интерфейса устройства.

Веб-интерфейс

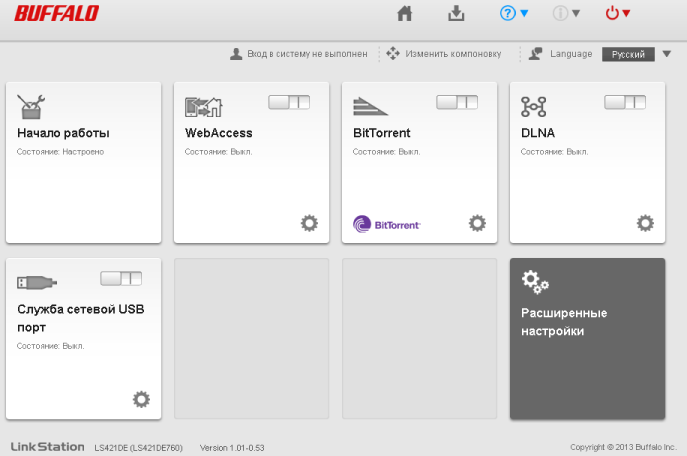

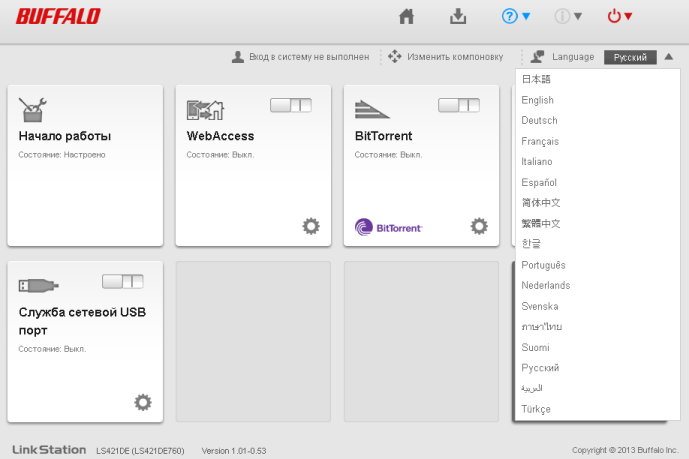

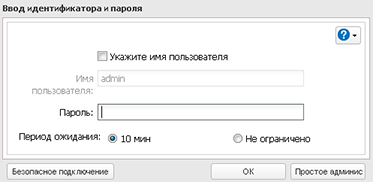

Веб-интерфейс доступен пользователям в двух режимах: режиме простого администрирования и расширенных настроек на семнадцати языках. В режиме простого администрирования пользователь может только просмотреть статусы служб.

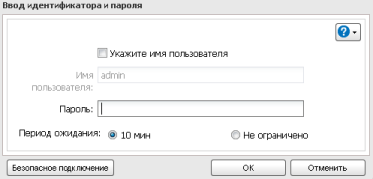

Для получения доступа к расширенным настройкам необходимо пройти процедуру аутентификации.

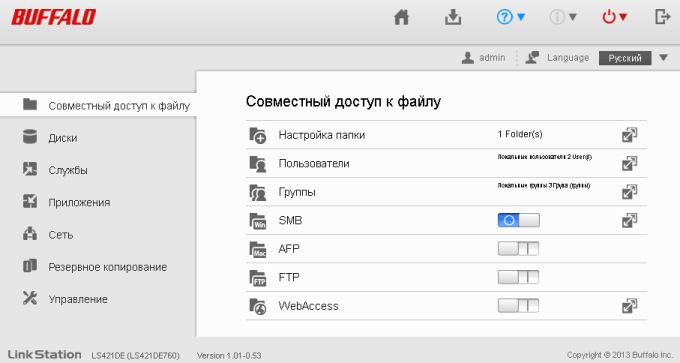

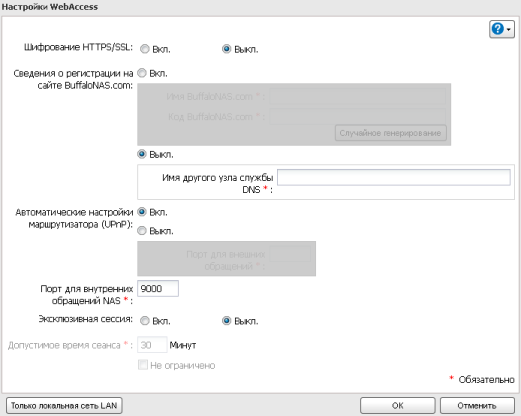

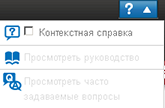

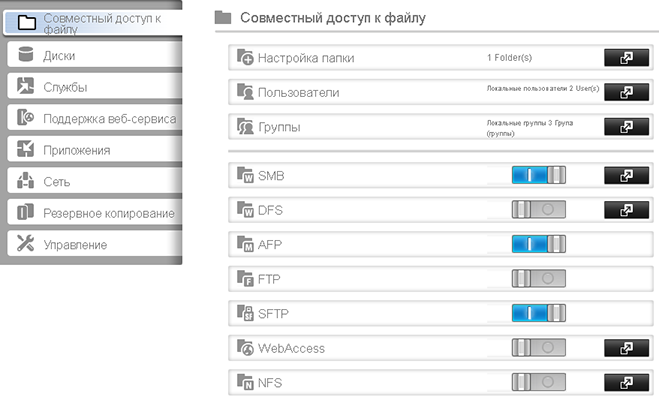

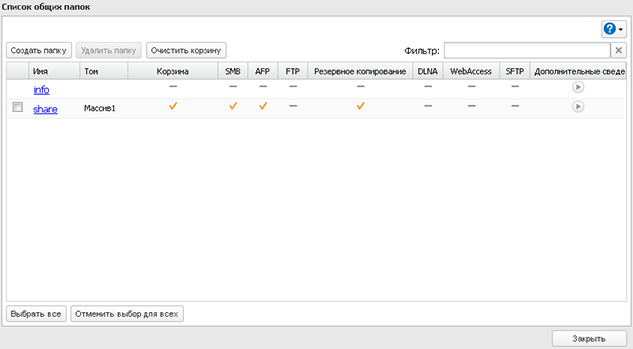

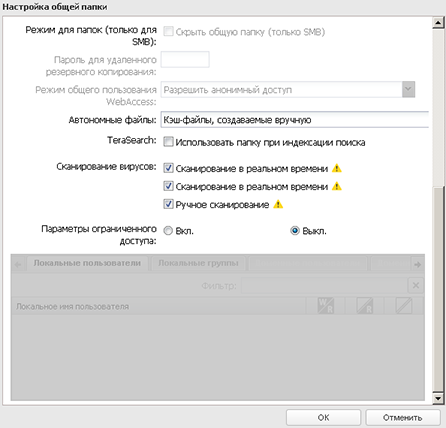

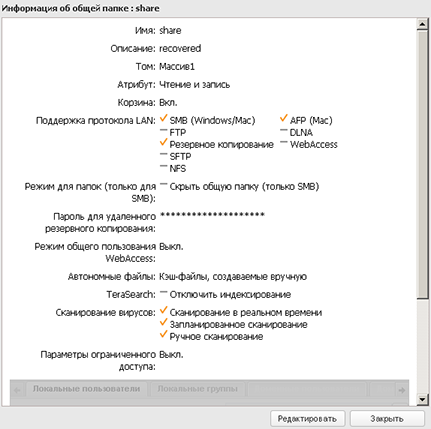

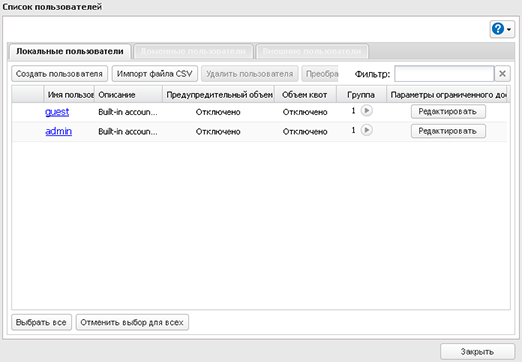

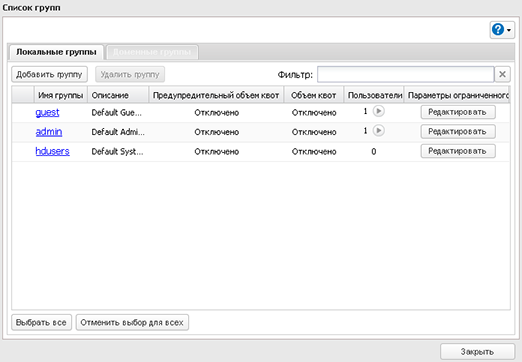

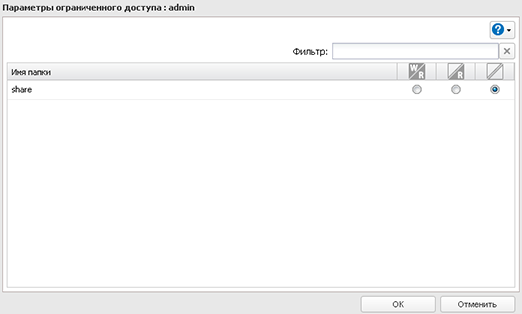

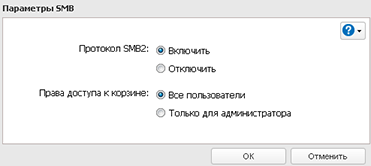

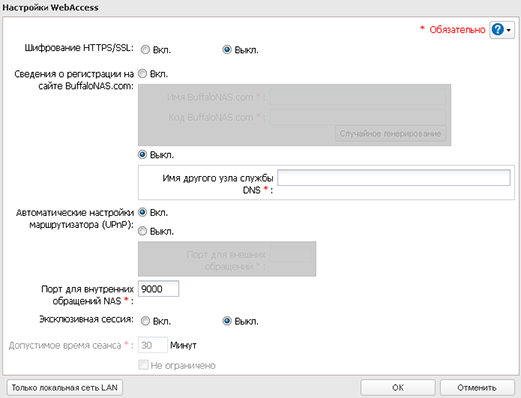

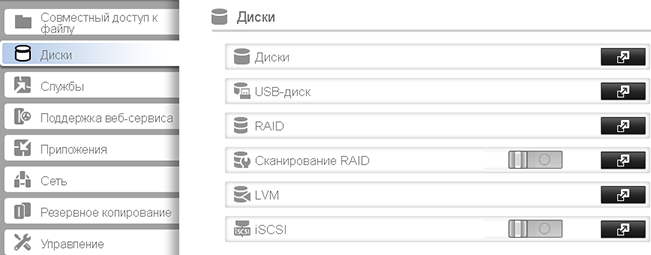

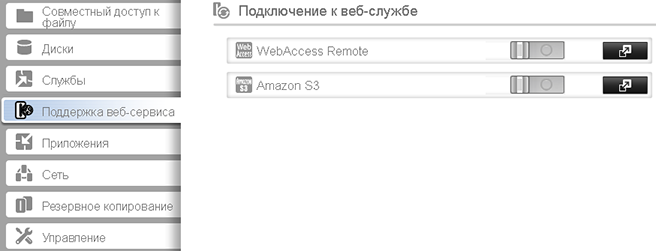

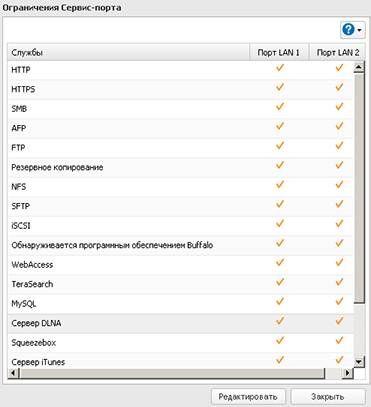

Веб-интерфейс сетевого хранилища LS421DE похож на тот, что мы уже видели в модели TeraStation 5600, поэтому мы не станем подробно рассматривать все возможности, доступные пользователям, но остановимся на наиболее интересных из них. Пункту меню «Совместные доступ к файлу» позволяет управлять папками, пользователями и их группами, а также файловыми службами SMB, AFP, FTP и WebAccess. Последняя предоставляет доступ к данным с использованием протокола HTTP.

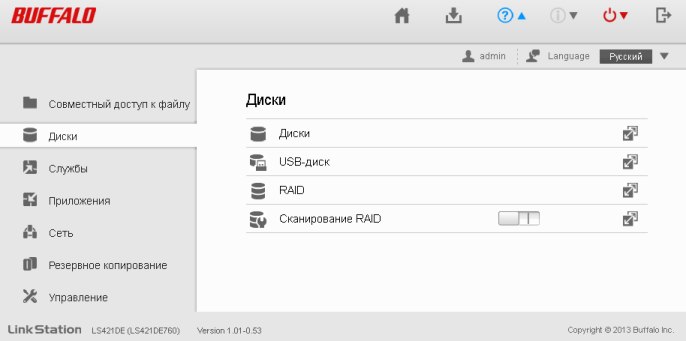

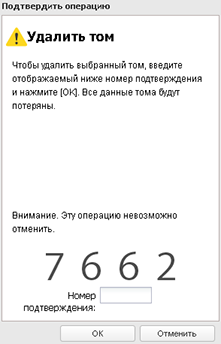

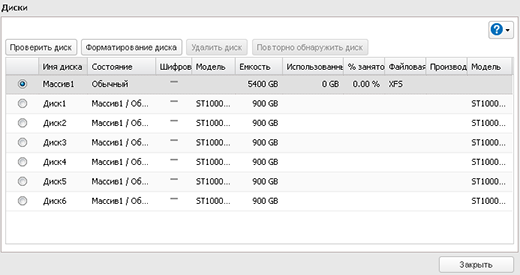

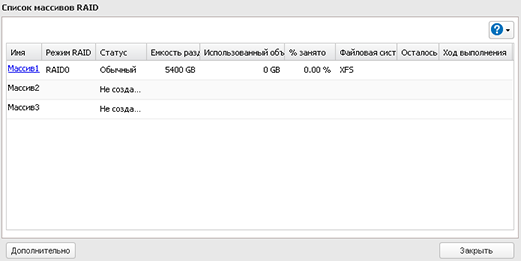

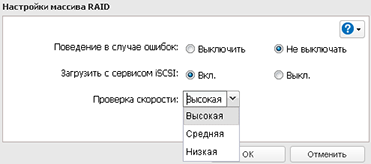

С помощью пункта «Диски» пользователь может управлять внутренними и внешними жёсткими дисками, а также RAID-массивами. Сетевое хранилище Buffalo LinkStation 421 позволяет создавать только следующие массивы: RAID0 и RAID1.

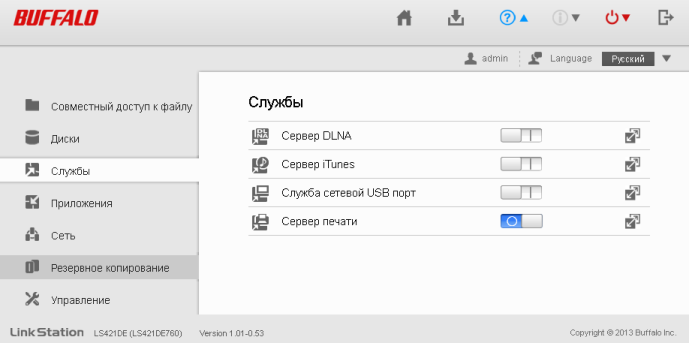

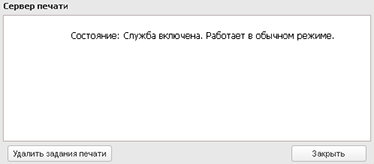

Службы сетевого доступа собраны в группе «Службы», здесь пользователь может настроить службы DLNA, iTunes и сервер печати. Кроме того отсюда пользователь может получить доступ к настройкам службы сетевого USB-порта, позволяющей «перенести» подключенное к USB-порту хранилища устройство на локальный компьютер пользователя, правда, необходимо установить дополнительное программное обеспечение на пользовательский ПК. Включение сервера DLNA может приводить к заметной деградации скоростей доступа к пользовательским данным, размещённым на хранилище, поэтому техническая поддержка производителя рекомендует отключать данную службу во всех случаях, когда она не используется.

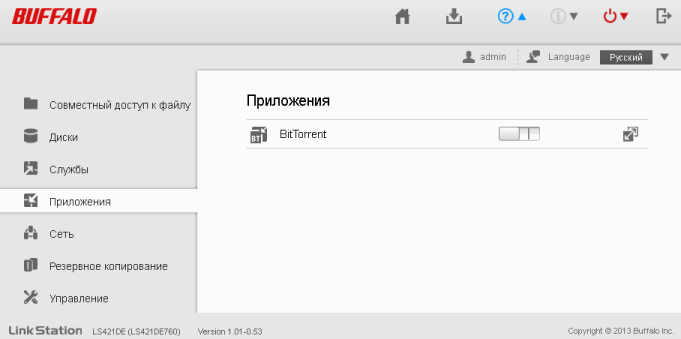

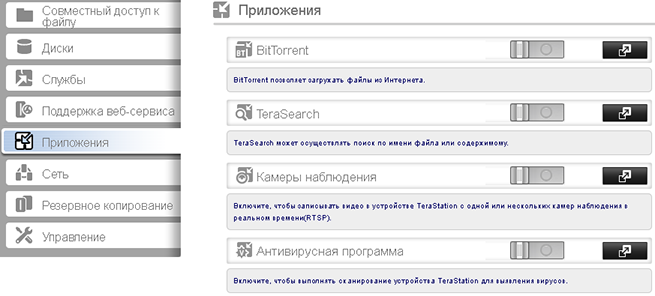

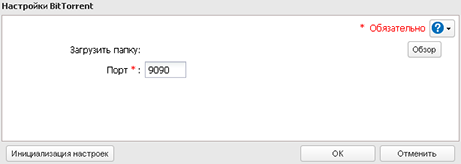

Buffalo LinkStation 421 поддерживает работу в пиринговых сетях, для чего предназначен пункт «BitTorrent» меню «Приложения».

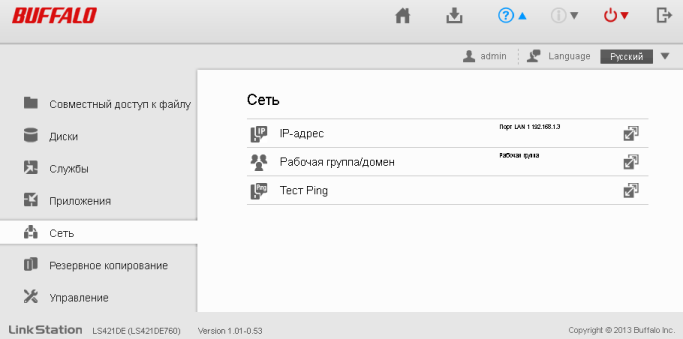

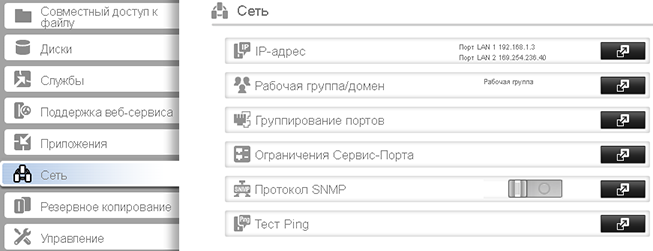

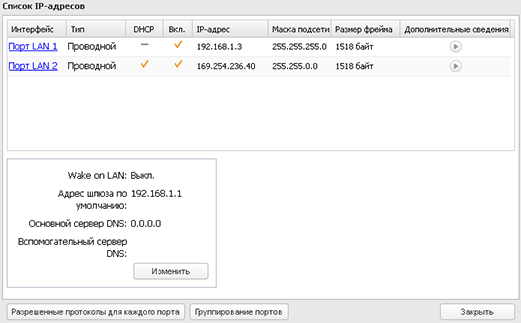

Изменить IP-параметры, добавить устройство в домен, а также проверить связность сети с помощью протокола ICMP можно с помощью пункта меню «Сеть».

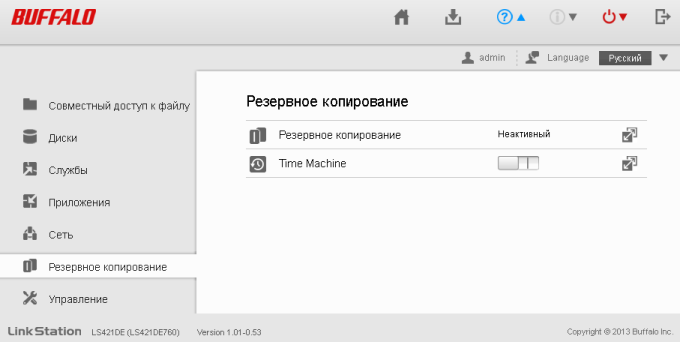

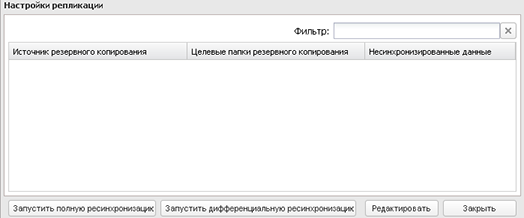

Выполнить резервное копирование данных можно с помощью одноимённого пункта меню.

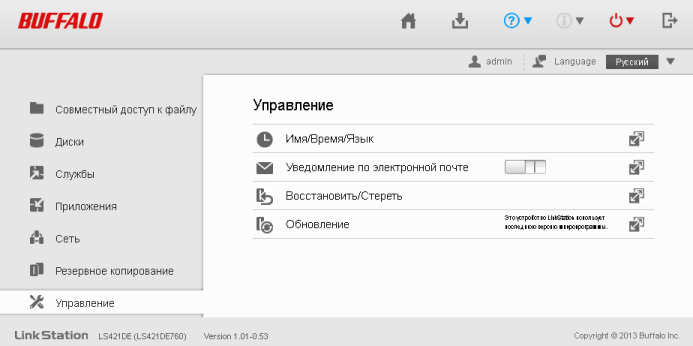

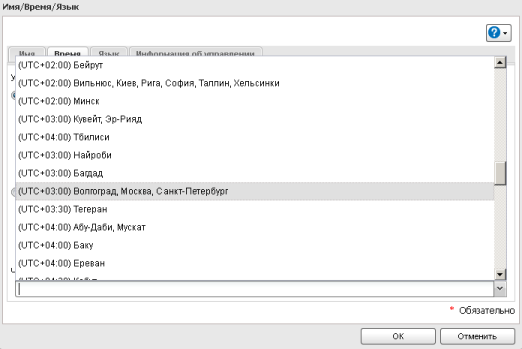

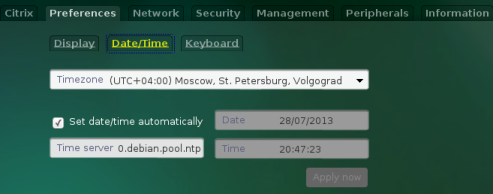

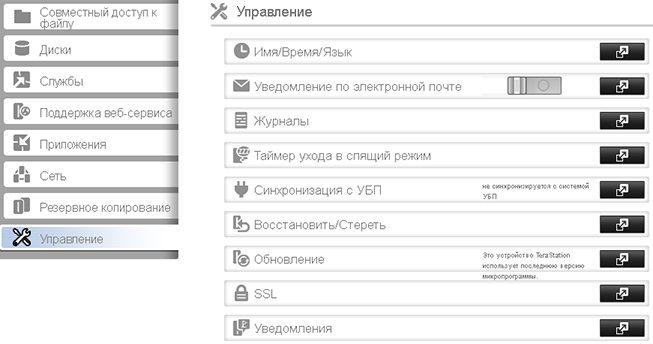

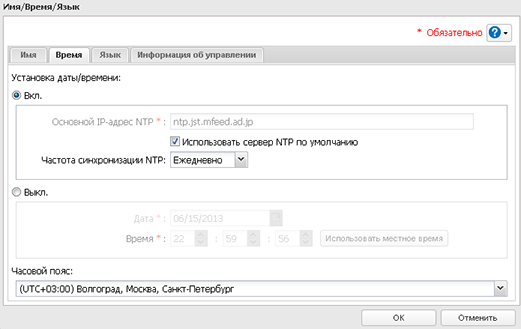

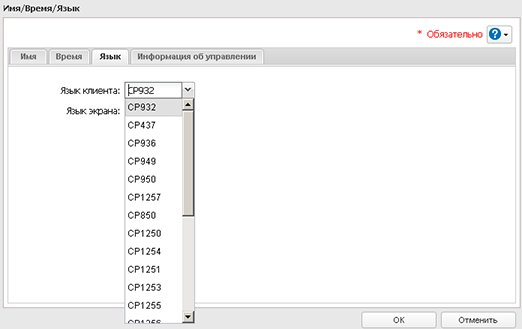

С помощью меню «Управление» можно выбрать имя устройства и язык интерфейса, установить параметры синхронизации времени, управлять пользовательскими настройками и выполнять обновление прошивки.

К сожалению, Buffalo LinkStation 421 до сих пор считает, что часовой пояс Москвы имеет положительное трёхчасовое смещение относительно UTC.

На этом мы завершаем беглое рассмотрение возможностей веб-интерфейса хранилища и переходим непосредственно к тестированию устройства.

Тестирование

Первым тестом, с которого мы обычно начинаем данный раздел, является установление времени загрузки устройства, под которым мы понимаем интервал времени, прошедший с момента подачи питания на оборудование до получения первого эхо-ответа по протоколу ICMP. Buffalo LinkStation 421 загружается за 119 секунд.

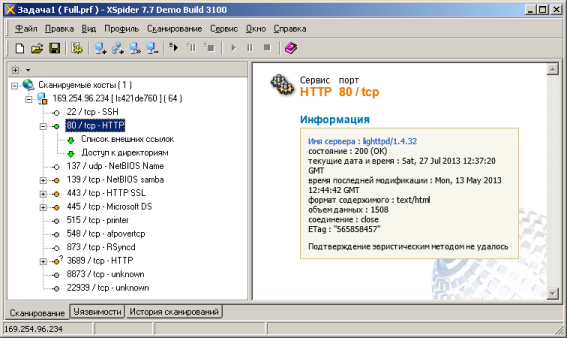

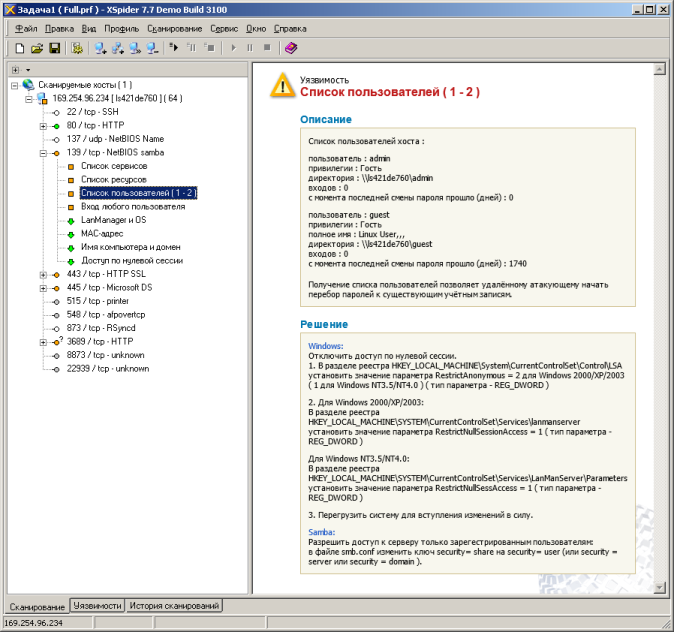

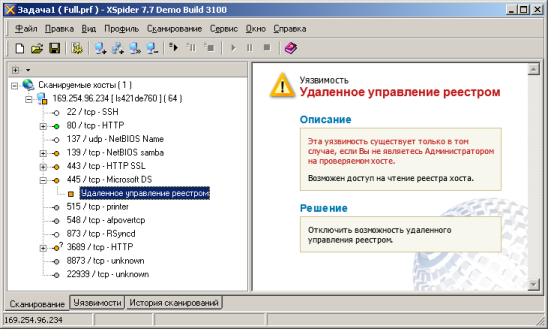

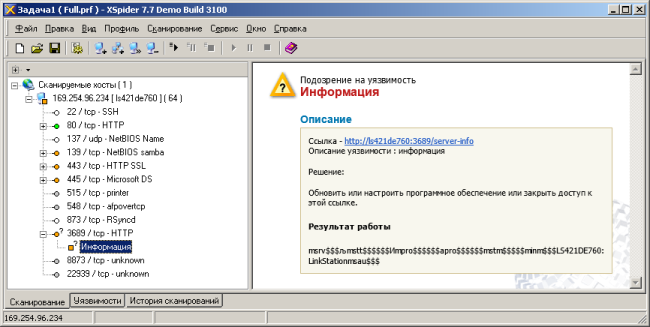

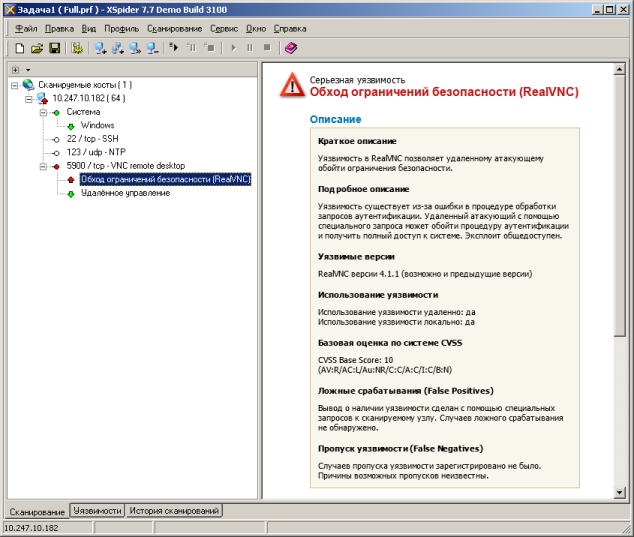

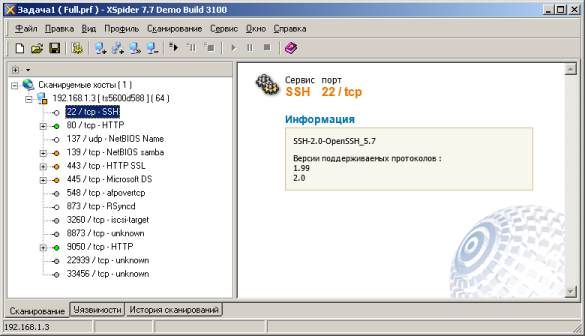

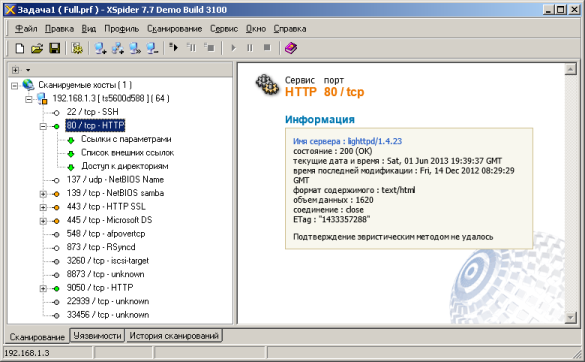

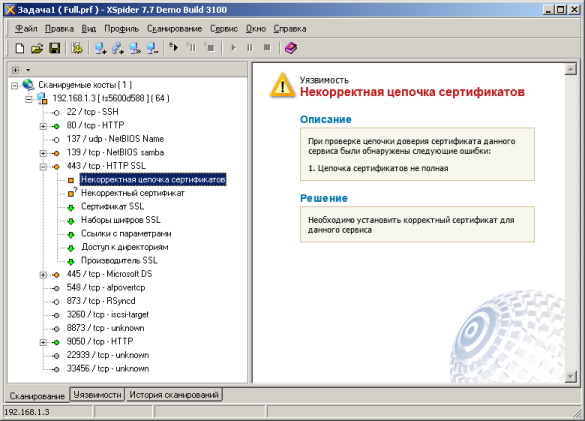

Вторым тестом стала проверка защищённости хранилища, выполняемая с помощью утилиты Positive Technologies XSpider 7.7 (Demo build 3100). Всего было обнаружено двенадцать открытых портов: TCP-22 (SSH), TCP-80 (HTTP), UDP-137 (NetBIOS Name), TCP-139 (NetBIOS Samba), TCP-443 (HTTP SSL), TCP-445 (Microsoft DS), TCP-515 (Printer), TCP-548 (afpovertcp), TCP-873 (RSyncd), TCP-3689 (HTTP), TCP-8873 (unknown) и TCP-22939 (unknown). Наиболее интересные из обнаруженных сведений представлены ниже.

Перед началом тестирования производительности хотелось бы указать основные параметры тестового стенда.

| Компонент | ПК |

| Материнская плата | ASUS Maximus V Extreme |

| Процессор | Intel Core i7 3770K 3.5 ГГц |

| Оперативная память | DDR3 PC3-10700 SEC 32 Гбайта |

| Сетевая карта | Intel Gigabit CT Desktop Adapter Intel Gigabit 82579V |

| Операционная система | Windows 7 x64 SP1 Rus |

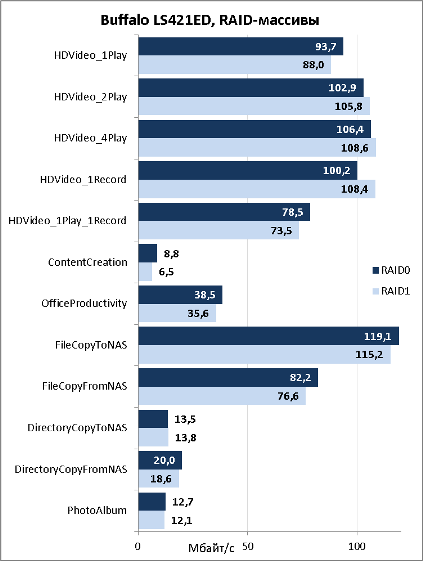

Первым нагрузочным тестом стало установление скорости доступа к данным, размещённым на внутренних жёстких дисках. Для тестирования мы как всегда использовали накопители SATA III Seagate Constellation ST2000NM0011. Так как сетевое хранилище Buffalo LinkStation 421 предназначено для работы с двумя жёсткими дисками, то допустимо создание лишь массивов RAID0 и RAID1.

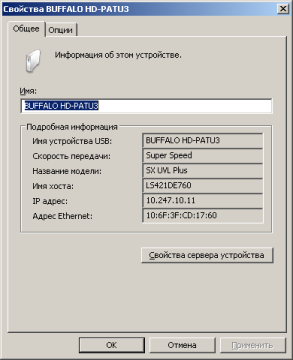

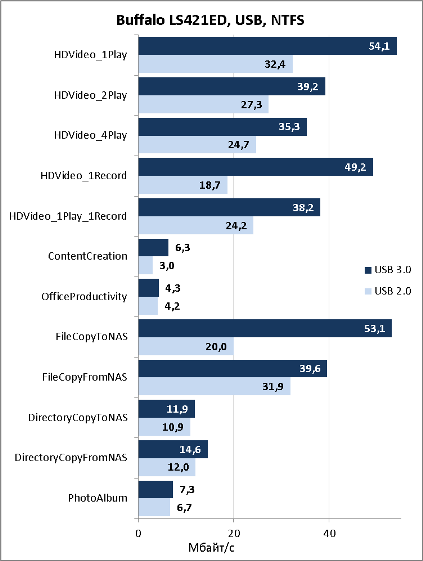

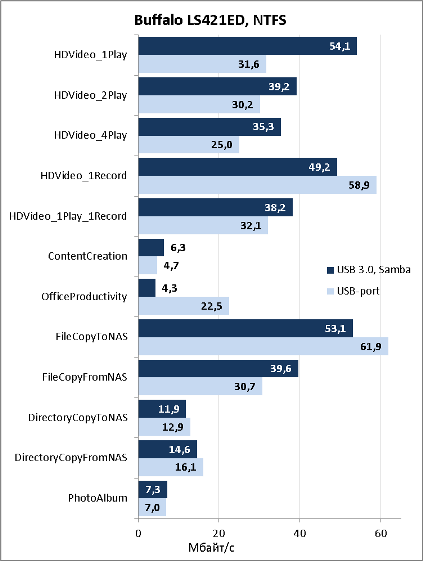

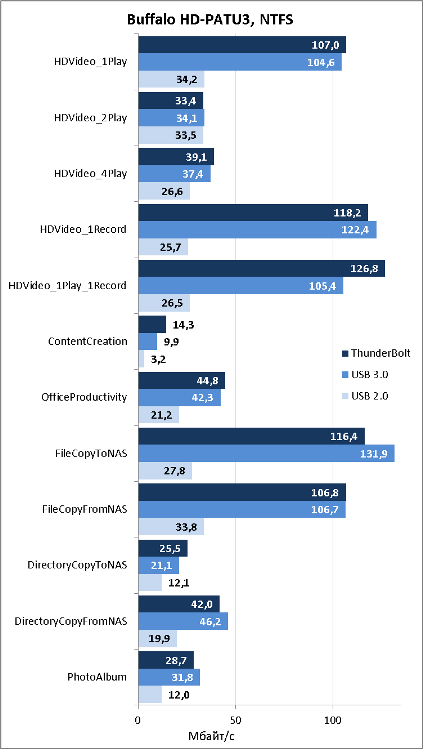

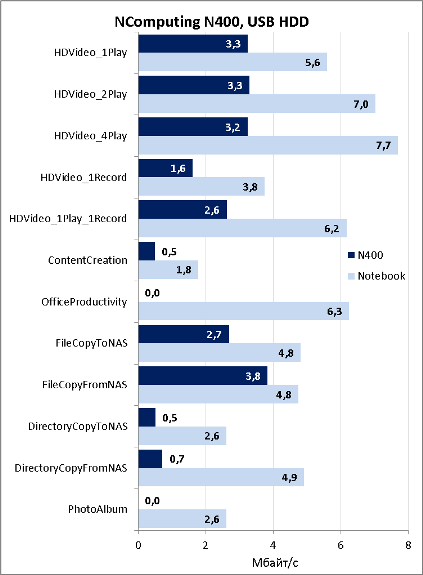

Лицевая панель устройства несёт на себе порт USB 3.0, тогда как сзади располагается порт USB 2.0. Мы решили сравнить скорости доступа к данным, хранящимся на внешнем накопителе, при подключении к порту USB 2.0 и USB 3.0. Для данного теста мы планировали использовать наш стандартный внешний накопитель Transcend StoreJet 25M3 объёмом 750 Гбайт, однако хранилище наотрез отказывалось с ним работать и даже определять. Мы были несколько удивлены такому поведению устройства, ведь более старшая модель – TeraStation 5600, которую мы тестировали ранее, без проблем определяла диск и обменивалась с ним данными. Мы запросили комментарий у производителя, оказалось, что все устройства Buffalo гарантированно поддерживают лишь работу с дисками того же производителя. По нашей просьбе нам доставили накопитель MiniStation Thunderbolt (HD-PATU3), с которым мы и провели сравнительный тест с разделом в файловой системе NTFS.

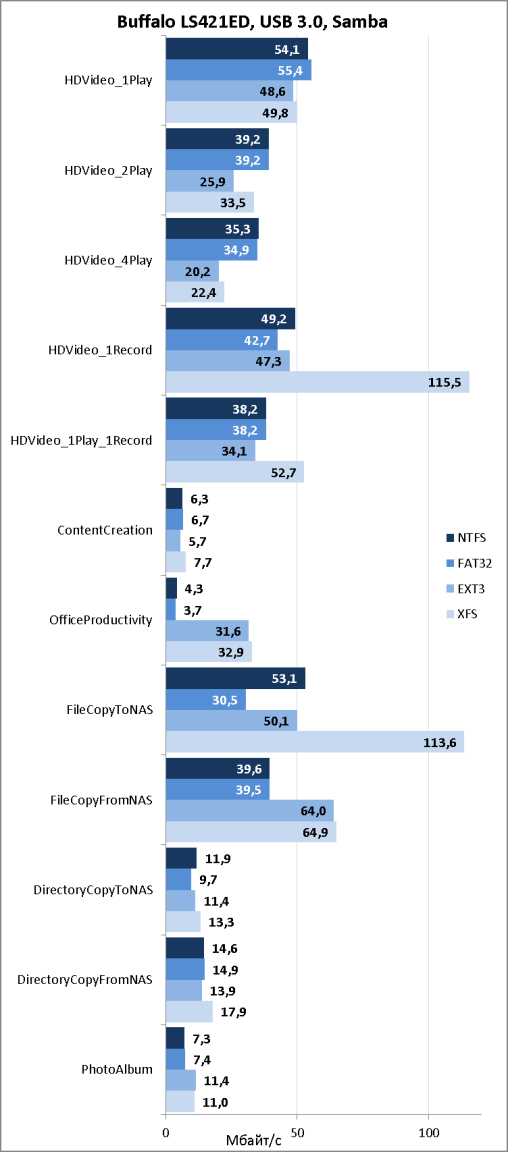

Также мы решили выяснить влияние файловой системы на скорость доступа к данным, размещённым на внешнем диске USB 3.0. Мы не знаем, чем объяснить столь высокие показатели файловой системы XFS, возможно, здесь играет роль какое-либо кэширование, поэтому нам кажется, что не стоит безоговорочно полагаться на эти результаты.

Интересной возможностью, которой обладает LinkStation 421, является функция USB-port, позволяющая переносить на локальный ПК удалённое устройство, подключенное к USB-порту хранилища. Для работы данной функции требуется установка дополнительного программного обеспечения, позволяющего обнаруживать устройства Buffalo в сети и эмулировать локальное подключение устройства. Мы решили сравнить скорость доступа к данным, размещённым на диске MiniStation Thunderbolt с использованием Samba и USB-port.

Мы считаем необходимым пару слов сказать также и о самом внешнем диске Buffalo MiniStation Thunderbolt, поддерживающего подключения с помощью интерфейсов Thunderbolt и USB 2.0/3.0. При подключении к ПК по интерфейсу Thunderbolt диспетчер устройств отображает название подключённого диска - ST500LM012 HN-M500MBB ATA Device.

На этом мы завершаем раздел тестирования и переходим к подведению итогов.

Заключение

В целом мы остались довольны протестированным сетевым хранилищем для дома и небольшого офиса Buffalo LinkStation 421: оно небольшое и относительно тихое, без лишних кнопок и индикаторов. Пожалуй, единственное, что нас удивило в данном устройстве – отсутствие поддержки сторонних внешних накопителей. С одной стороны, это позволило нам поближе познакомиться с другим устройством компании Buffalo – MiniStation Thunderbolt, но с другой стороны, может обернуться головной болью тем пользователям LinkStation 421, кто не планировал покупать внешний жёсткий диск Buffalo. К счастью, в протестированной модели нет такой привязки к внутренним жёстким дискам, как мы видели в модели TeraStation 5600.

Сильные стороны сетевого хранилища Buffalo LinkStation 421 перечислены ниже.

- Высокие скорости передачи данных.

- Наличие функции USB-порт для подключения удалённых устройств к ПК.

- Возможность управления как с помощью HTTP, так и с помощью HTTPS.

- Наличие контекстной справки для каждой страницы веб-интерфейса.

- Поддержка работы в пиринговых сетях.

- Компактный корпус.

- Приемлемая цена.

К сожалению, мы не можем не указать и на обнаруженные недостатки.

- Неправильные часовые пояса.

- Длительное создание массиваRAID1.

- Ограниченная поддержка внешних USB-дисков.

- Отсутствие поддержки IPv6.

На момент написания статьи средняя цена на сетевое хранилище Buffalo LinkStation 421E (без дисков) в интернет-магазинах Москвы составляла 8200 рублей.

D-Link DGS-3620-28TC

Введение

Желание протестировать коммутатор D-Link DGS-3620-28TC в нашей тестовой лаборатории возникло из-за наличия у данной модели функции VLAN Translation. Мы уже видели реализацию данного функционала у другого производителя, однако тогда нам так и не удалось заставить его заработать. Коммутатор DGS-3620-28TC успешно справился с задачей, но обо всём по порядку.

Внешний вид

Маршрутизирующий коммутатор D-Link DGS-3620-28TC выполнен в 1U металлическом корпусе с пластиковой передней панелью и предназначен для монтажа в стойку. Габариты устройства (без учёта ушей) составляют 441х310х44 мм. Вместе с коммутатором поставляются «уши» для крепления в стойку, а также резиновые ножки для настольного размещения.

Верхняя и нижняя поверхности ничем особенным не примечательны. На боковых панелях расположена вентиляционная решётка для охлаждения устройства (направление воздушного потока не изменяемо: от одной боковой стенки до другой). Стоит, пожалуй, отметить, что уши к DGS-3620-28TC могут крепиться как ближе к передней панели, так и к задней.

На задней стороне устройства расположен разъём для подключения основного питания, а также ввод для подсоединения к резервному источнику питания постоянного тока (закрыт защитной пластинкой).

Лицевая панель несёт на себе 20 медных порта Gigabit Ethernet (с 1 по 20), также четыре комбо-порта (21-24) для подключения к медной или оптической сети, а также четыре порта SFP+ для подключения к оптическим сетям 10GE. Кроме того на передней панели расположен слот для SD-карт, разъём для подключения внешних датчиков, световые индикаторы состояния портов и всего устройства, а также консольный и управляющий интерфейсы.

Заглянем теперь внутрь корпуса.

Аппаратная платформа

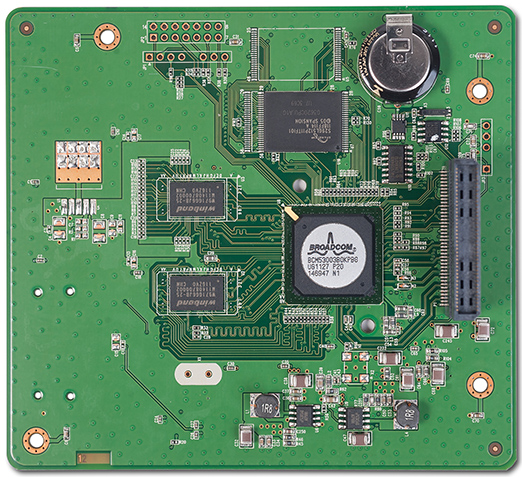

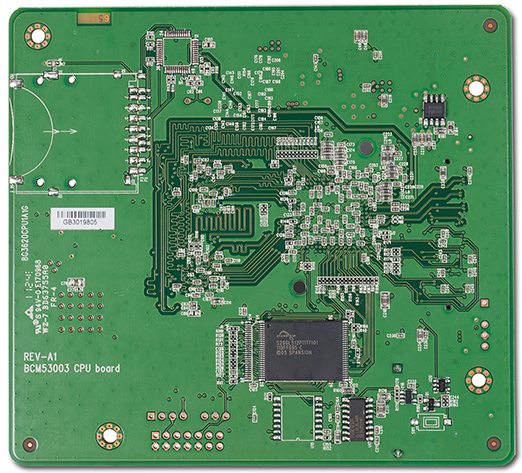

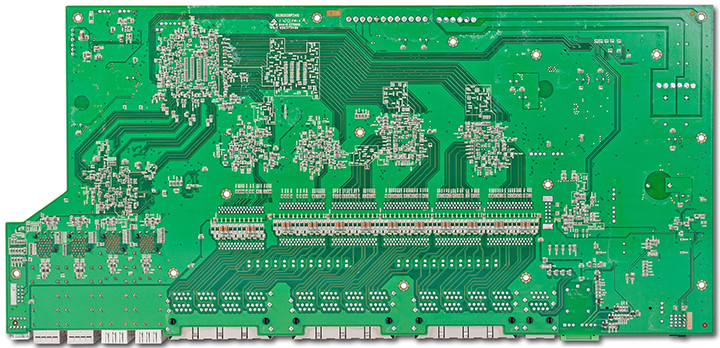

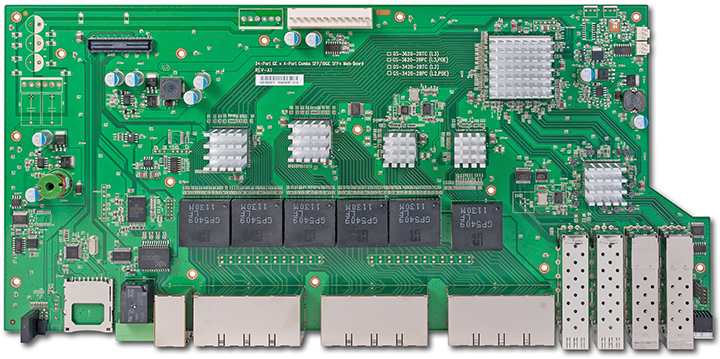

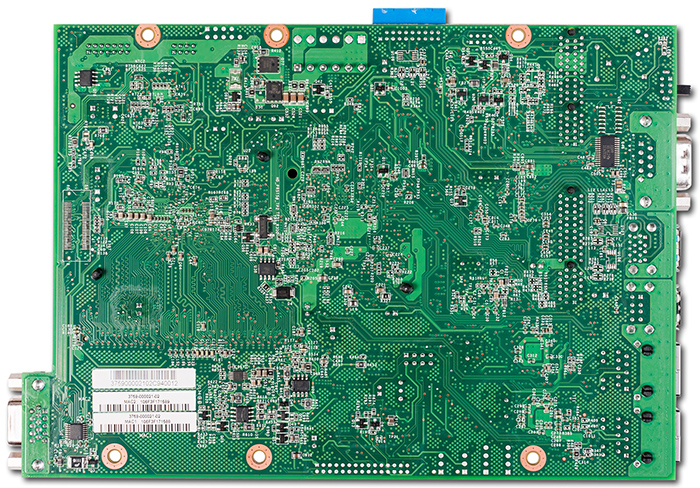

Электронная начинка коммутатора DGS-3620-28TC состоит из четырёх плат: двух основных и двух вспомогательных. Вспомогательные платы выполняют функции блока питания и вывода световой индикации о состоянии портов.

Маленькая плата выполняет функции управляющего модуля, на ней основные элементы размещаются с двух сторон.

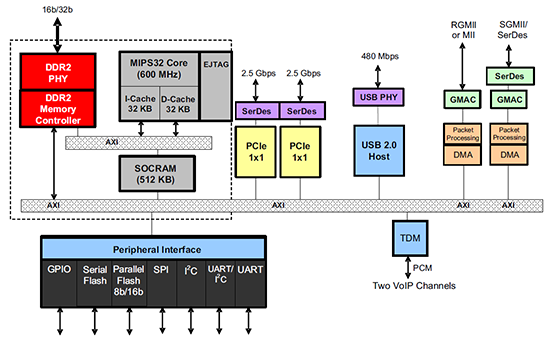

Система построена на базе одноядерного MIPS процессора Broadcom BCM53003B3KPBG, работающего на частоте 600 МГц. Блок-схема данного процессора представлена ниже.

В качестве флеш-памяти использованы два модуля Spansion S29GL512P11TFI01, объём каждого составляет 64 Мбайта, таким образом системе доступно 128 Мбайт флеш-памяти. Функции оперативной памяти выполняют два DDR2 модуля Winbond W971GG6JB-25, объём каждого равен 128 Мбайт, то есть всего 256 Мбайт оперативной памяти доступно системе.

На большой плате для коммутации используются следующие чипы Broadcom: BCM54680B0KFBG, BCM54640B0KFBG, BCM8747BKFBG и BCM56334B0KFSBG. Модуль Broadcom BCM5461SA1KPFG обеспечивает работу MGMT-порта. Работа с SD картами поддерживается чипом Realtek RTS5159.

На этом мы завершаем рассмотрение аппаратной части и переходим к изучению программной составляющей.

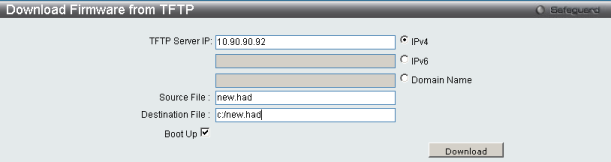

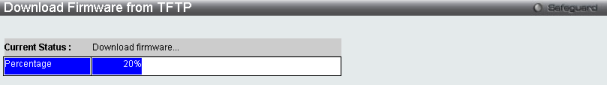

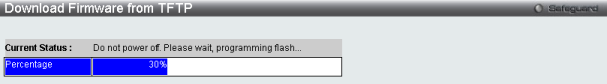

Обновление прошивки

Смена версии микропрограммного обеспечения может производиться с помощью командной строки или веб-интерфейса устройства. Рассмотрим сначала процедуру обновления через интерфейс командной строки. Перед началом обновления пользователю необходимо загрузить файл с новой прошивкой с сервера производителя и разместить этот файл на своём TFTP-сервере.

Выяснить текущую версию прошивки можно с помощью команды show switch.

DGS-3620-28TC:admin#sho swi

Command: show switch

Device Type : DGS-3620-28TC Gigabit Ethernet Switch

MAC Address : 84-C9-B2-1F-BE-00

IP Address : 10.90.90.90 (Manual)

VLAN Name : default

Subnet Mask : 255.0.0.0

Default Gateway : 0.0.0.0

Boot PROM Version : Build 1.00.012

Firmware Version : Build 1.00.035

Hardware Version : A1

Firmware Type : EI

Serial Number : PVXF1B8000113

System Name :

System Location :

System Uptime : 0 days, 1 hours, 22 minutes, 1 seconds

System Contact :

Spanning Tree : Disabled

GVRP : Disabled

IGMP Snooping : Disabled

MLD Snooping : Disabled

RIP : Disabled

RIPng : Disabled

DVMRP : Disabled

PIM : Disabled

PIM6 : Disabled

OSPF : Disabled

OSPFv3 : Disabled

BGP : Disabled

VLAN Trunk : Disabled

Telnet : Enabled (TCP 23)

Web : Enabled (TCP 80)

SNMP : Disabled

SSL Status : Disabled

SSH Status : Disabled

802.1X : Disabled

Jumbo Frame : Off

CLI Paging : Enabled

MAC Notification : Disabled

Port Mirror : Disabled

SNTP : Disabled

DHCP Relay : Disabled

DNSR Status : Disabled

VRRP : Disabled

HOL Prevention State : Enabled

Syslog Global State : Disabled

Single IP Management : Disabled

Password Encryption Status : Disabled

DNS Resolver : Disabled

Первое, что требуется сделать, - выгрузить файл с прошивкой на коммутатор.

DGS-3620-28TC:admin#download firmware_fromTFTP 10.90.90.92 src_file new.had dest_file c:/new.had

Command: download firmware_fromTFTP 10.90.90.92 src_file new.had dest_file c:/new.had

Connecting to server................... Done.

Download firmware...................... Done. Do not power off!

Please wait, programming flash......... Done.

Success.

Затем необходимо указать, что после перезагрузки должен быть использован именно эта версия микропрограммного обеспечения, и выполнить саму перезагрузку.

DGS-3620-28TC:admin#dir

Command: dir

Directory of /c:

Idx Info Attr Size Update Time Name

--- ------- ---- -------- ------------------- ----------------

1 RUN(b) -rw- 7182308 2000/01/01 02:06:39 new.had

2 RUN(*) -rw- 7182308 2000/01/01 02:01:38 runtime.had

3 d--- 0 2000/01/01 00:00:12 system

126002 KB total (111882 KB free)

(*) -with boot up info (b) -with backup info

DGS-3620-28TC:admin#config firmware image c:/new.had boot_up

Command: config firmware image c:/new.had boot_up

Success.

DGS-3620-28TC:admin#show boot_file

Command: show boot_file

Bootup Firmware : /c:/new.had

Bootup Configuration : /c:/config.cfg

DGS-3620-28TC:admin#reboot

Command: reboot

Are you sure you want to proceed with the system reboot?(y/n)

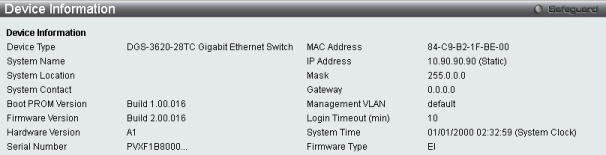

Убедиться в успешности произведённого обновления можно также с помощью команды show switch (часть вывода удалена).

DGS-3620-28TC:admin#show switch

Command: show switch

Device Type : DGS-3620-28TC Gigabit Ethernet Switch

Boot PROM Version : Build 1.00.012

Firmware Version : Build 1.00.038

Стоит также отметить, что смена прошивки возможна не только для одного конкретного коммутатора, но также и для их группы. В этом случае необходимо специально указывать идентификатор устройства, для которого производится обновление.

DGS-3620-28TC:admin#download firmware_fromTFTP sr src_file new.had unit ?

Command: download firmware_fromTFTP sr src_file new.had unit

Next possible completions:

<unit_id>

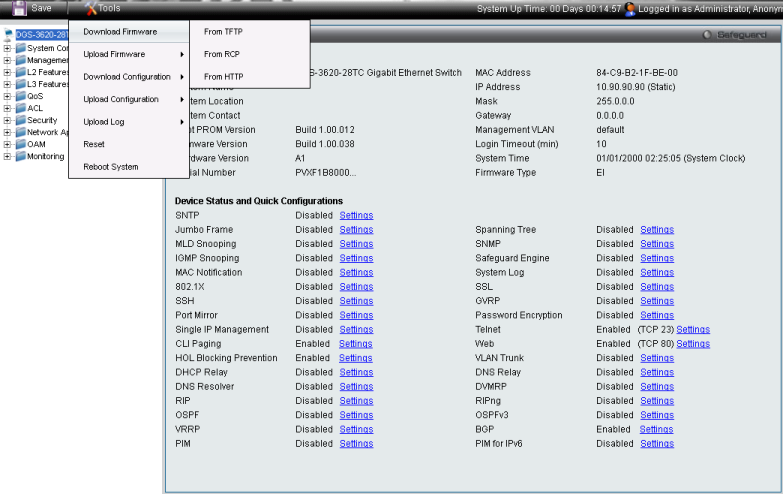

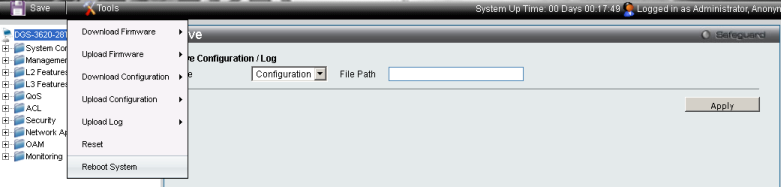

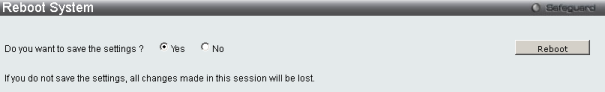

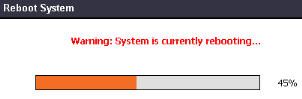

Аналогичных результатов можно добиться с помощью веб-интерфейса, где требуется обратиться к пункту Download Firmware меню Tools.

После того, как файл выгружен на коммутатор, необходимо сохранить текущую конфигурацию и перезагрузить устройство.

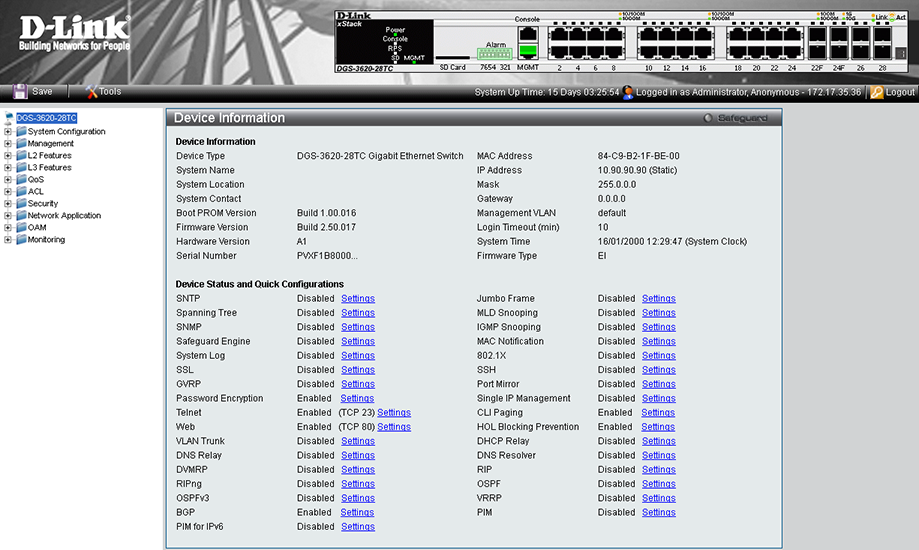

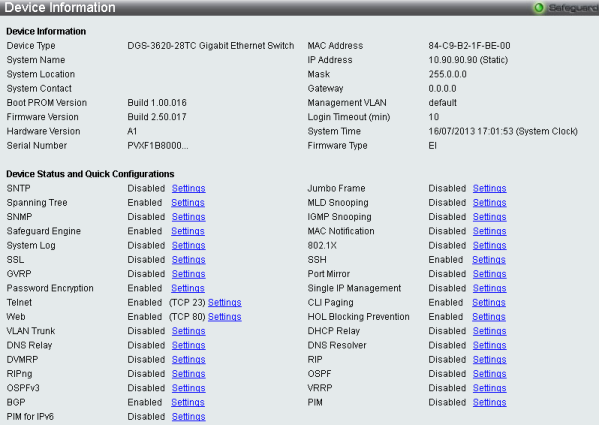

Убедиться в успешности проведённого обновления можно с помощью стартовой странички устройства.

На этом мы завершаем рассмотрение процедуры обновления микропрограммного обеспечения коммутатора D-Link DGS-3620-28TC и переходим к изучению его программных возможностей.

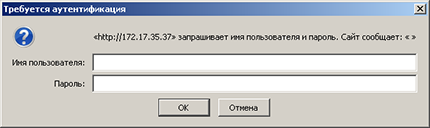

Обзор веб-интерфейса

Кроме заявленной во введении функции VLAN Translation коммутатор D-Link DGS-3620-28TC обладает ещё огромным набором разнообразных возможностей, к беглому рассмотрению которых мы и приступаем. При входе запрашивается логин и пароль. При использовании современных прошивок оба эти поля при первом входе необходимо оставить пустыми.

После ввода логина и пароля администратор попадает на стартовую страничку устройства, где представлены краткие сведения о самом устройстве и поддерживаемых протоколах.

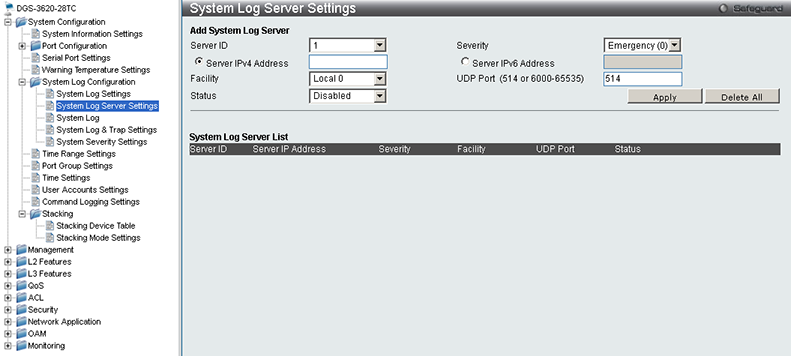

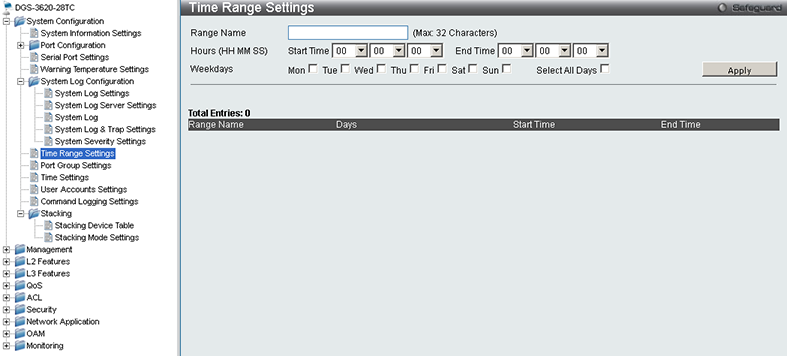

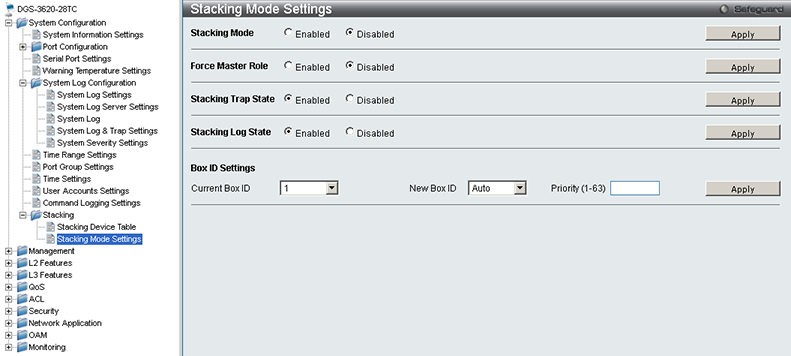

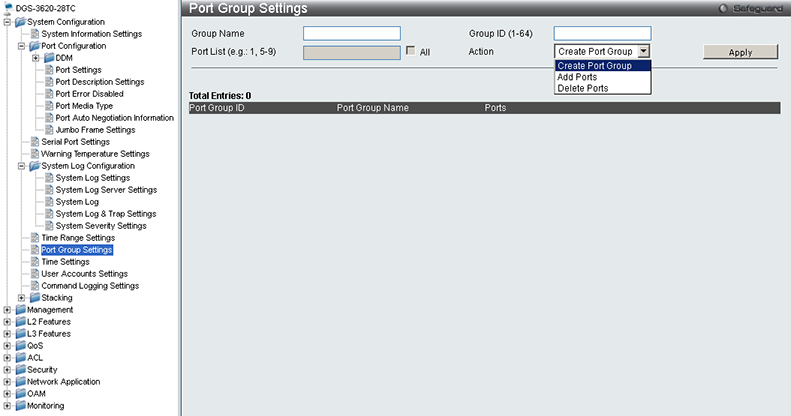

Группа меню System Configuration позволяет администратору управлять настройками времени на коммутаторе, изменять базу данных пользователей, задавать параметры стекирования и журналирования. Также здесь можно объединять физические порты в группы.

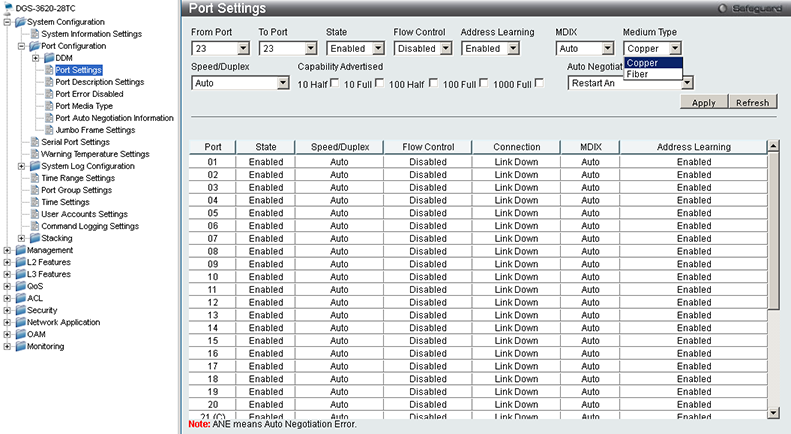

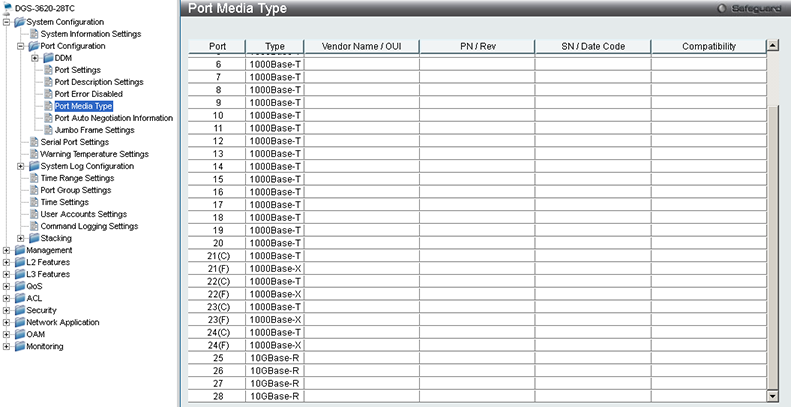

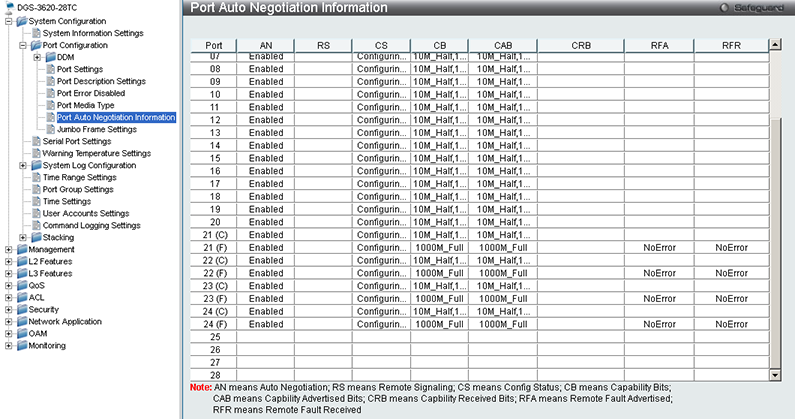

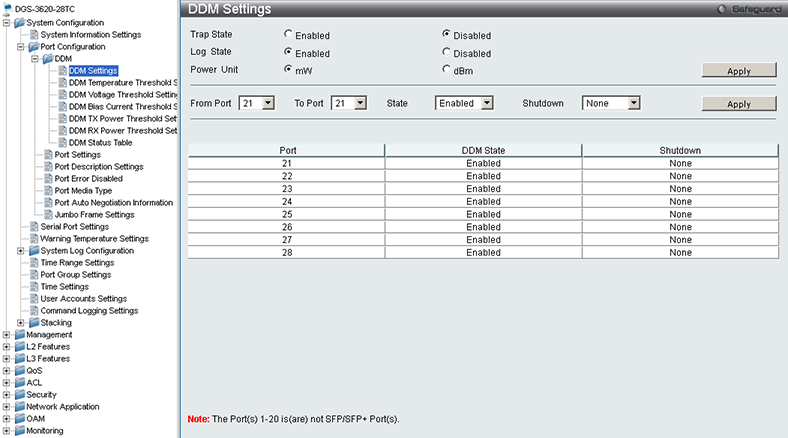

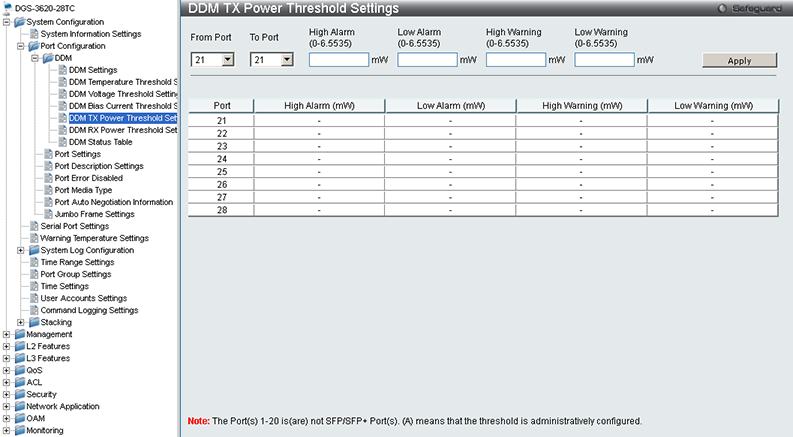

Отдельно хотелось бы упомянуть о подгруппе Port Configuration, позволяющей управлять физическими параметрами работы сетевых интерфейсов коммутатора. Если оптические SFP-модули обладают поддержкой DDM (Digital Diagnostic Monitoring), то доступ к ней администратор может получить с помощью пунктов одноимённой подгруппы.

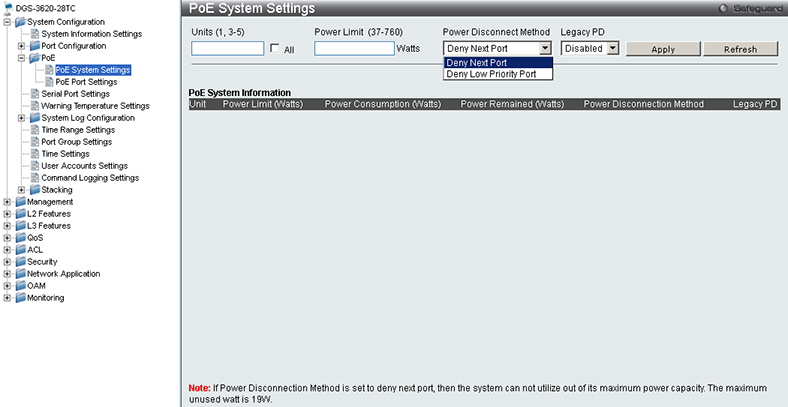

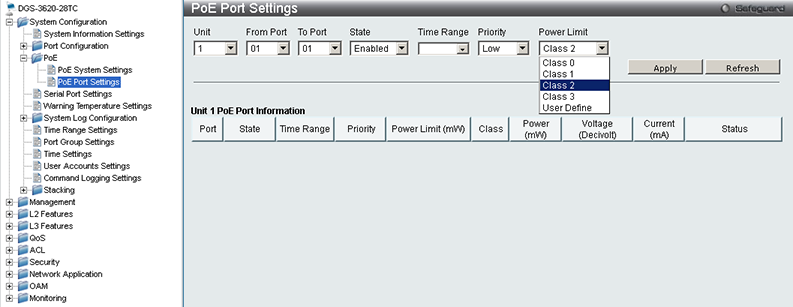

Коммутатор D-Link DGS-3620-28TC не имеет поддержки PoE (Power over Ethernet), однако при включении стекирования соответствующая подгруппа появляется в меню, что объясняется возможностью добавления в стек коммутатора с поддержкой PoE.

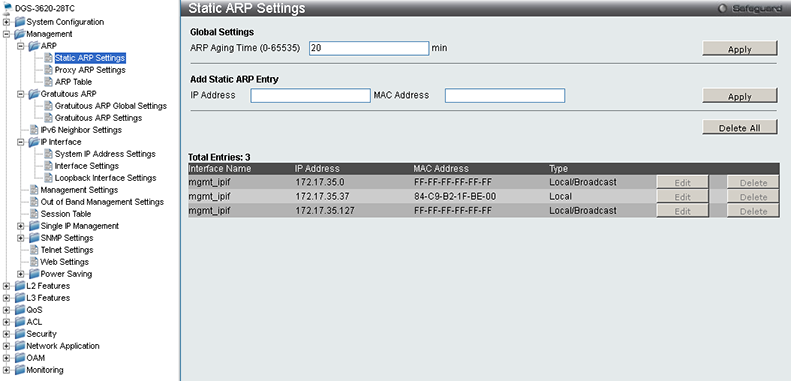

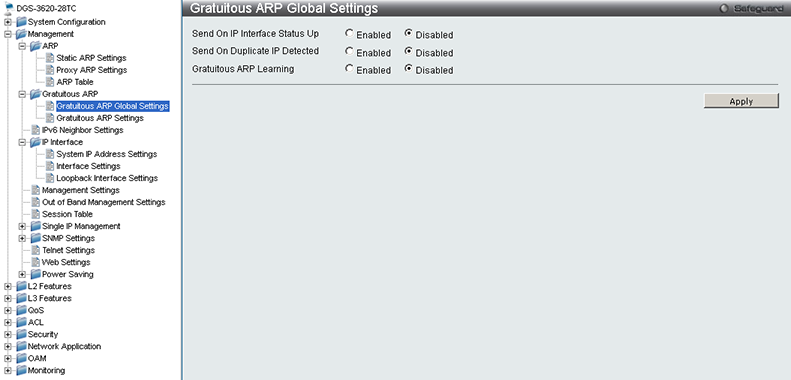

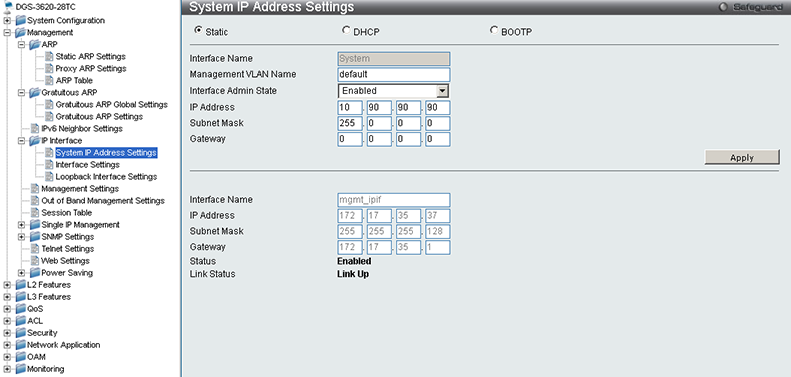

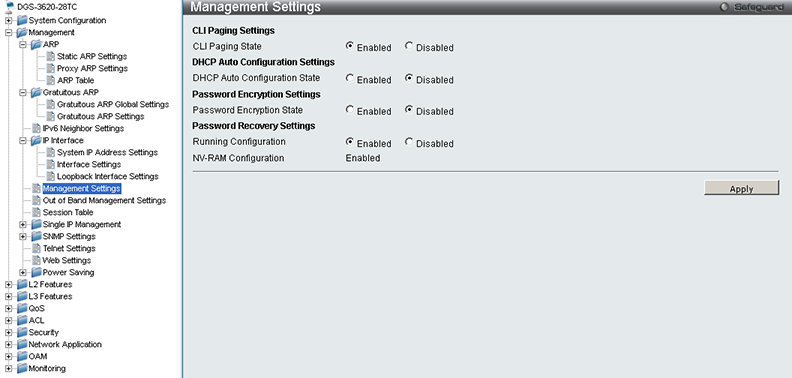

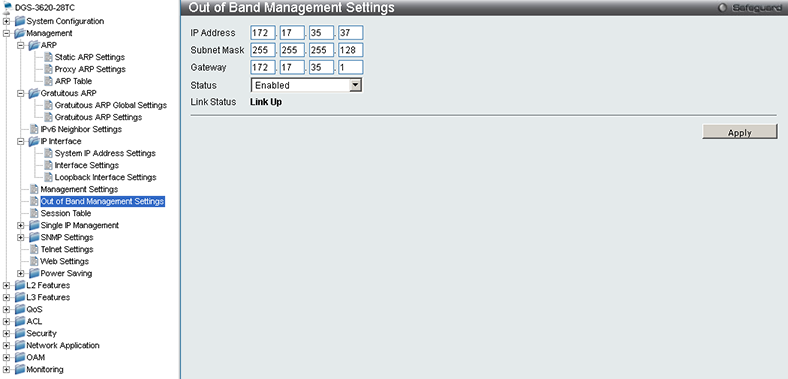

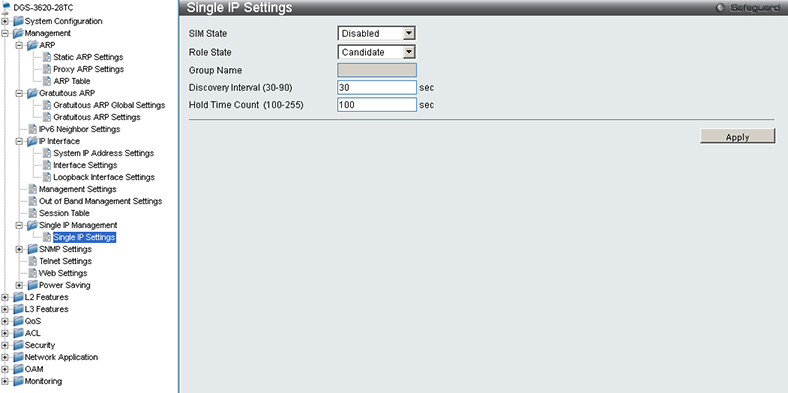

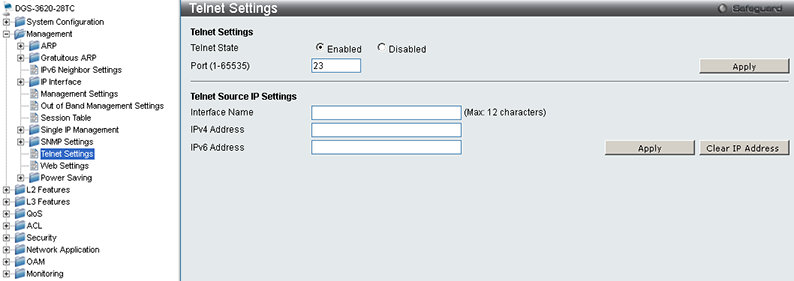

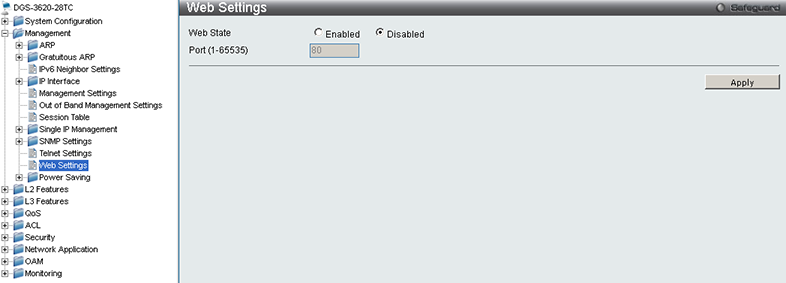

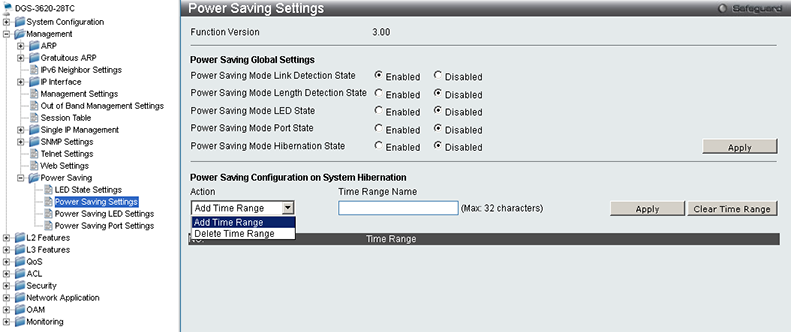

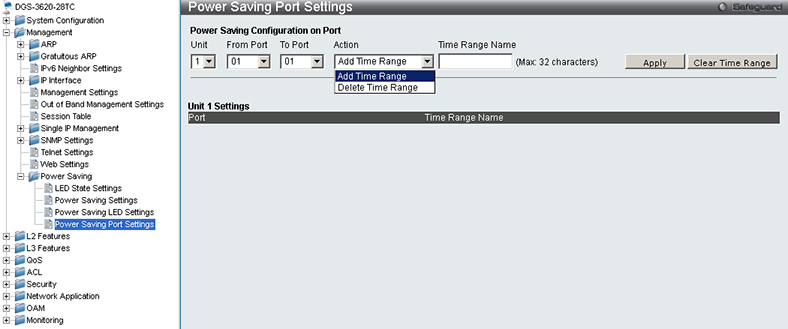

Параметры доступа к коммутатору для управления собраны в группе Management. D-Link DGS-3620-28TC поддерживает как внеполосное, так и внутриполосное управление. Также в этой группе расположена подгруппа Power Saving, позволяющая изменить параметры сбережения электроэнергии.

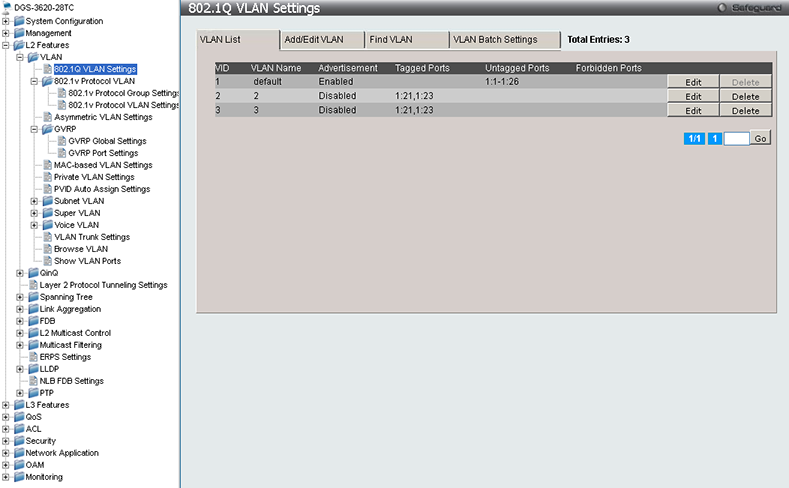

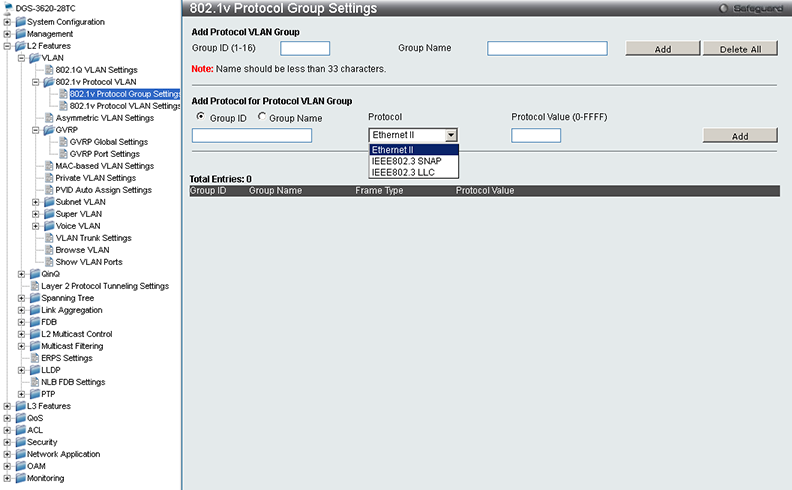

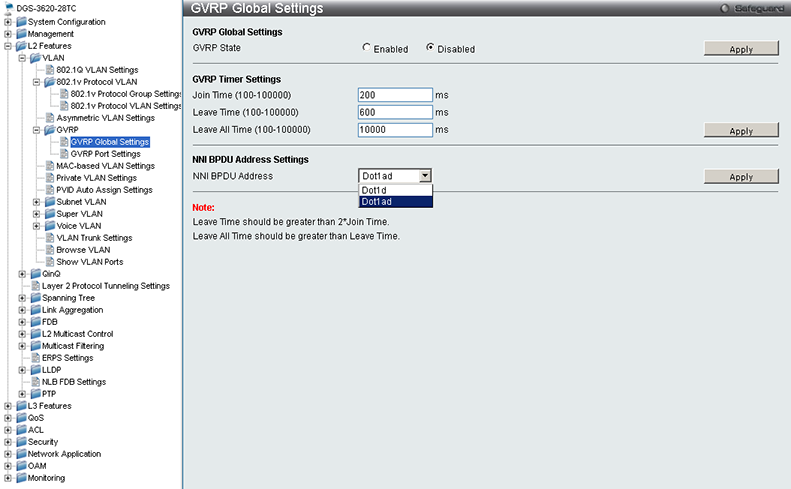

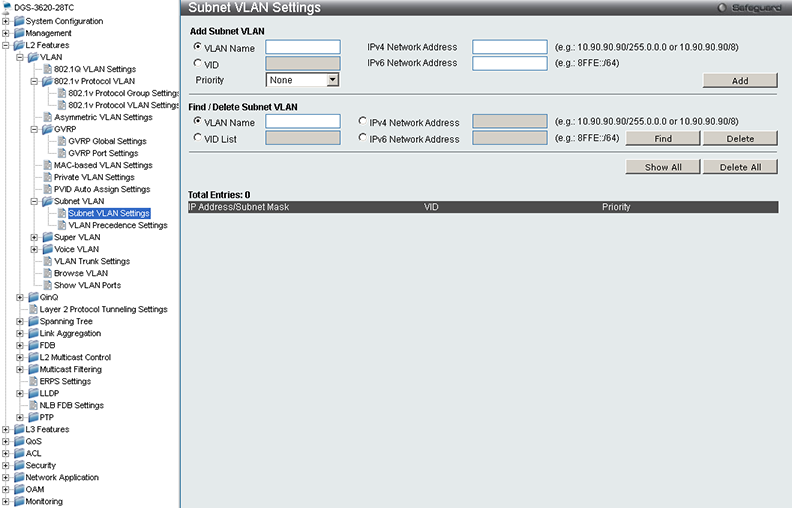

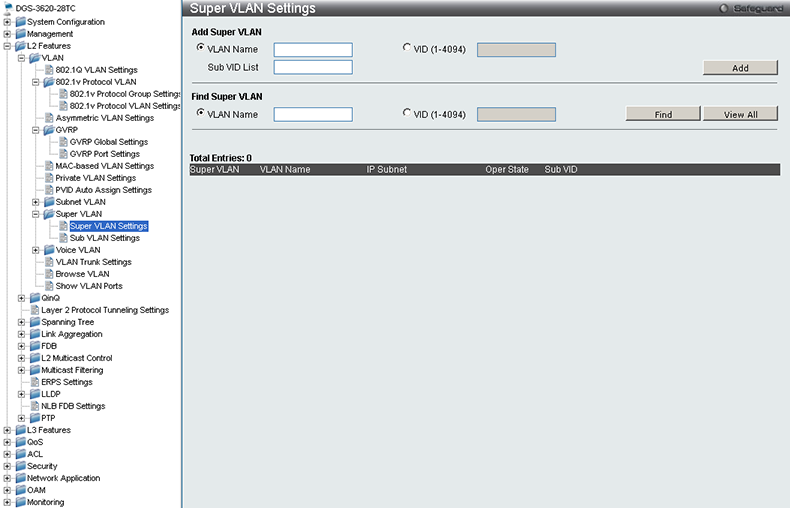

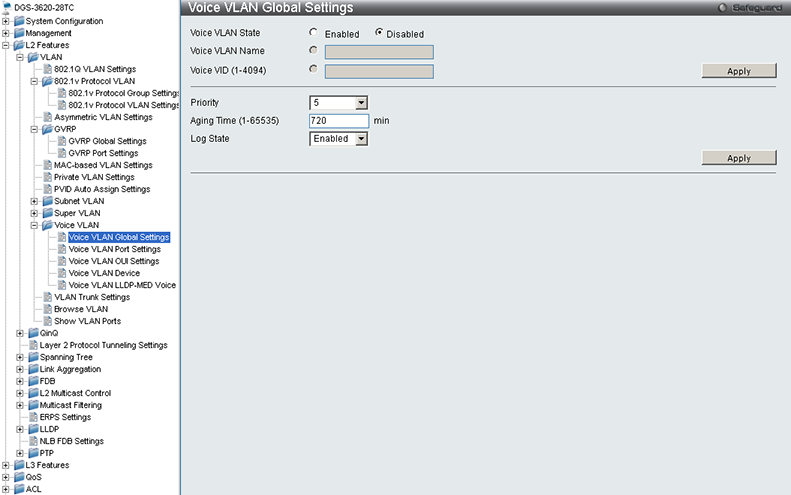

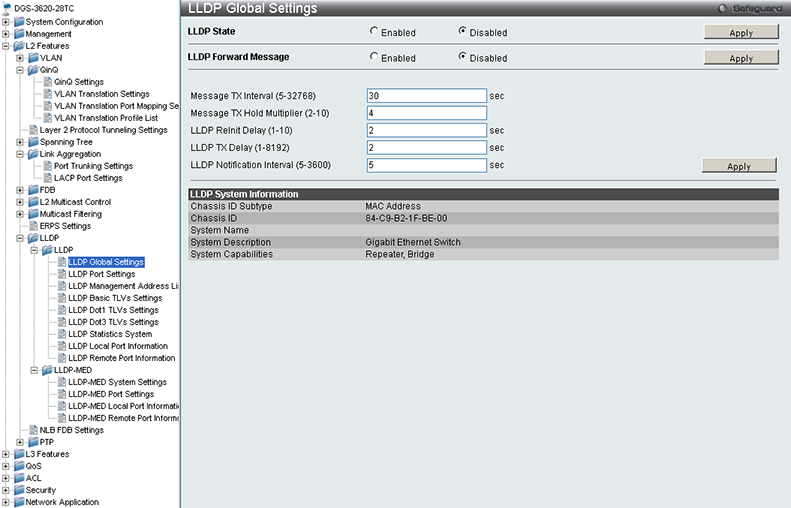

Подгруппа VLAN группы L2 Features позволяет администратору определять принадлежность к той или иной виртуальной сети на основе тэгов, портов, MAC или IP-адресов, протоколов сетевого уровня. Настройки протокола распространения информации о виртуальных сетях GVRP, супер виртуальных сетях, голосовых и приватных VLAN также представлены в этой подгруппе. В принципе, принадлежность к голосовым виртуальным сетям может быть также определена с помощью подгруппы LLDP.

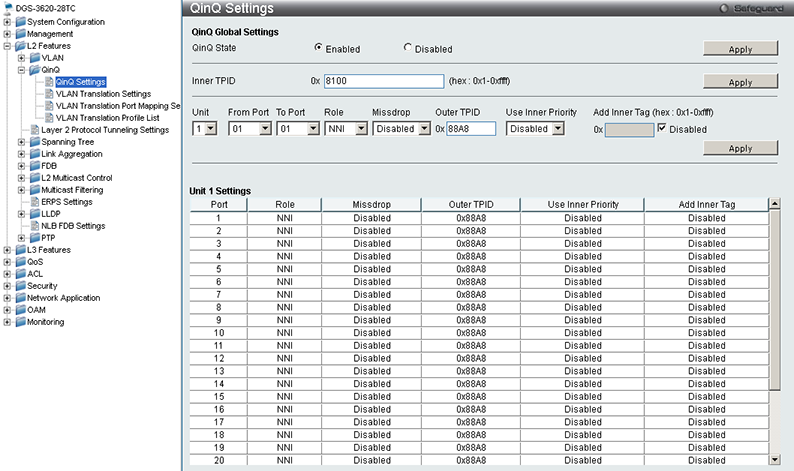

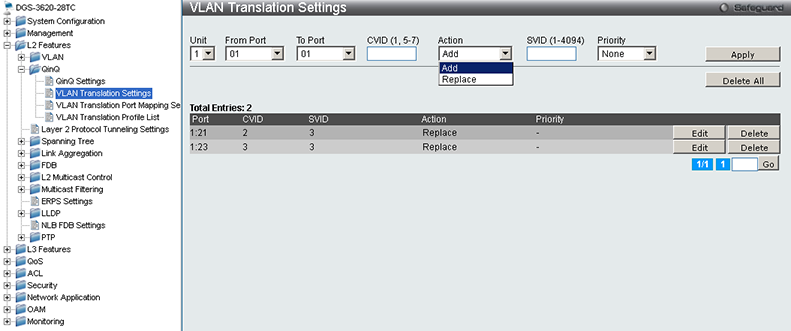

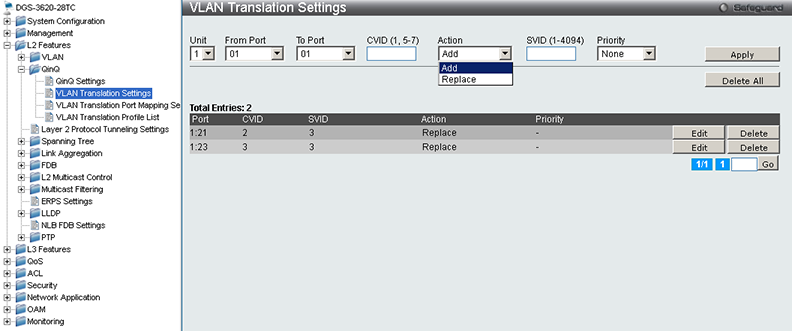

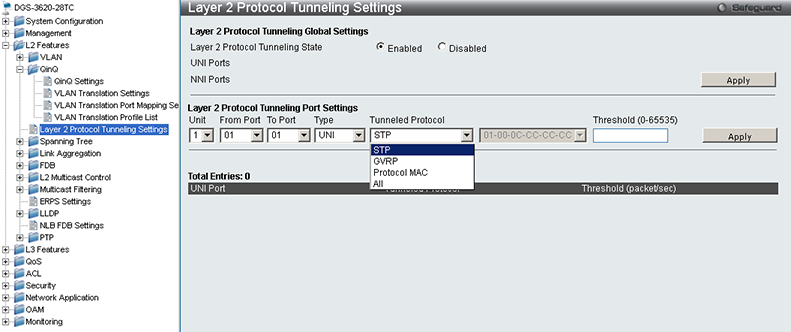

Параметры работы технологии QinQ и протокола связующего дерева собраны в подгруппах QinQ и Spanning Tree той же группы. Приятной возможностью коммутатора D-Link DGS-3620-28TC стало наличие функции трансляции номеров виртуальных сетей, то есть когда один VID, приходящий через транковый порт, заменяется другим VID.

Агрегация физических портов в один логический производится с помощью подпункта Link Aggregation того же пункта меню. Для поддержки агрегированного интерфейса используется протокол LACP.

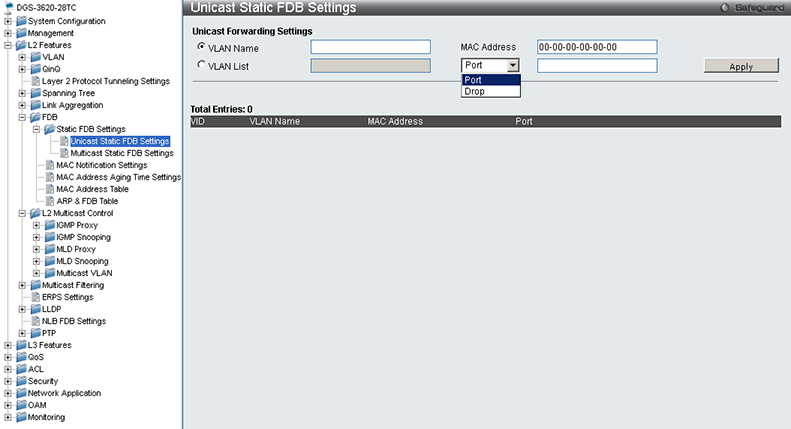

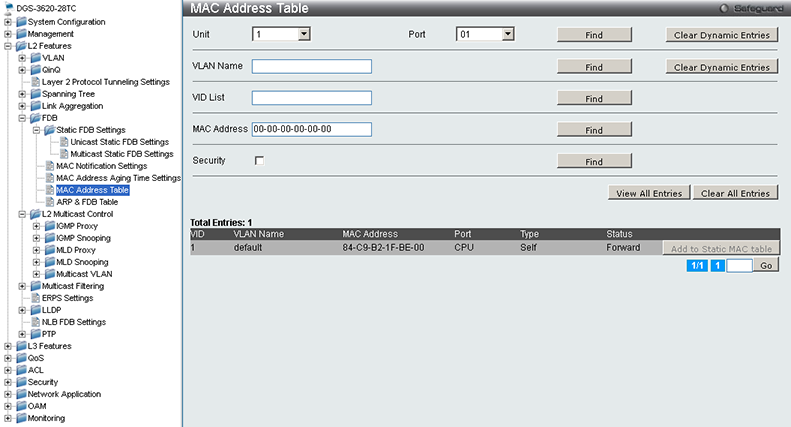

Таблица MAC-адресов и параметры её работы доступны администратору в подгруппе FDB.

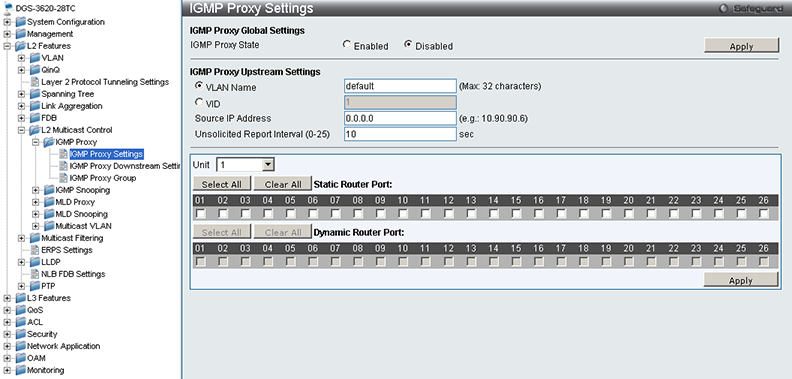

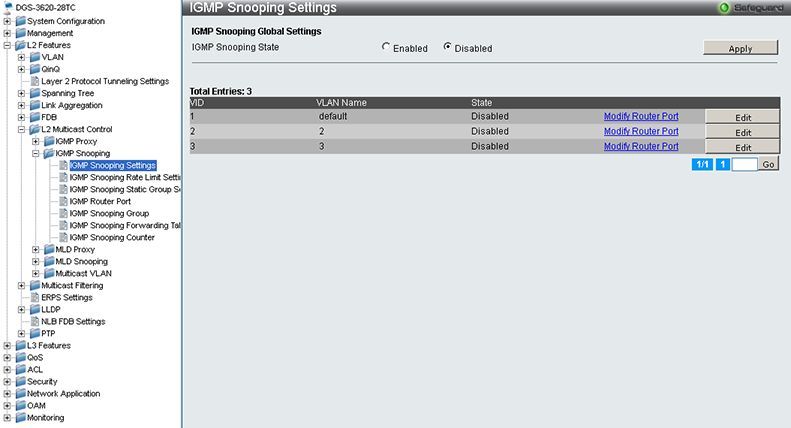

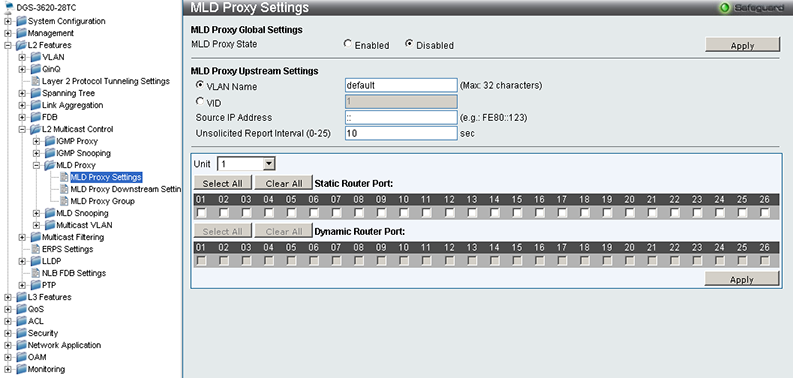

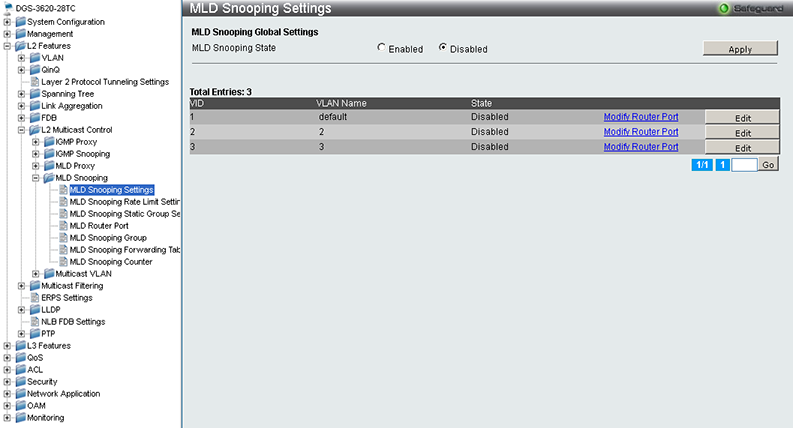

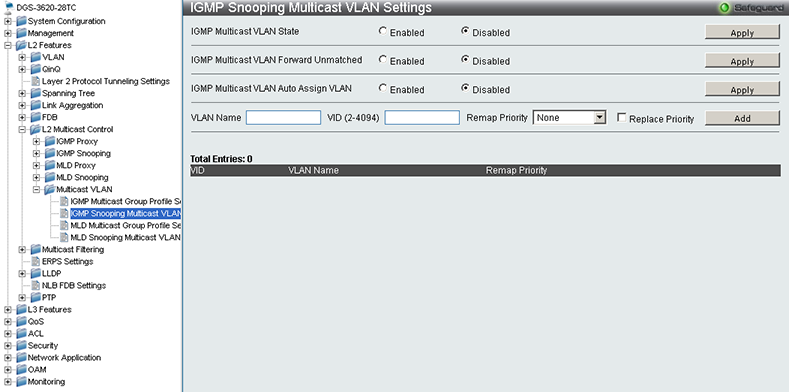

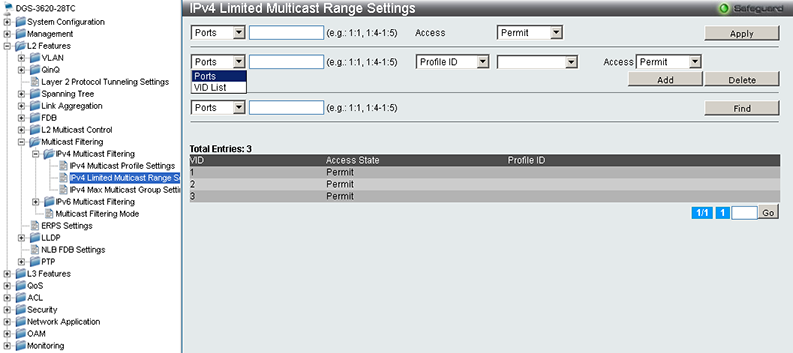

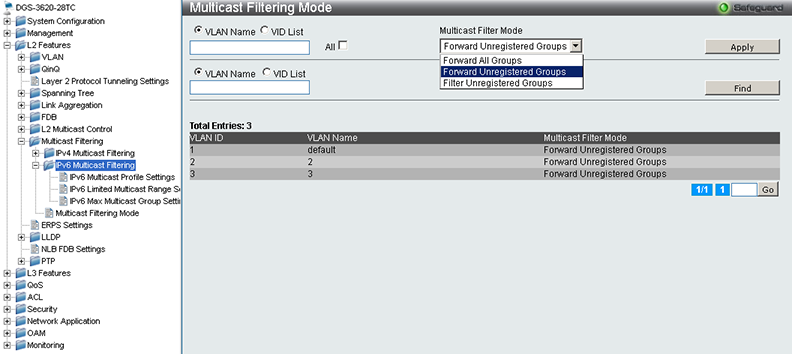

Настроить групповую рассылку можно с помощью подгрупп L2 Multicast Control и Multicast Filtering.

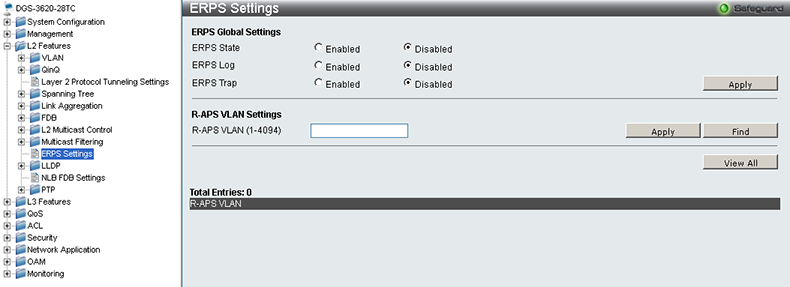

Подпункт ERPS Settings предназначен для организации кольцевых топологий в сети Ethernet без использования протокола STP, но с применением более перспективного решения – ERPS (Ethernet Ring Protection Switching (ITU-T G.8032)), обеспечивающего время восстановления работоспособности сети менее 50мс.

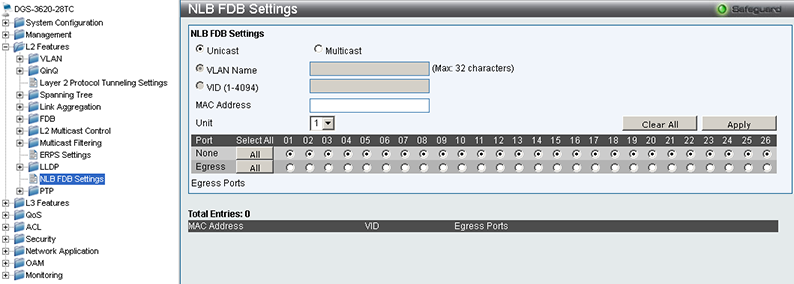

Коммутатор D-Link DGS-3620-28TC позволяет сетевым администраторам подключать к нему сервера, нагрузка между которыми балансируется с использованием технологии NLB (Network Load Balancing). Соответствующая настройка доступна в подпункте NLB FDB Settings.

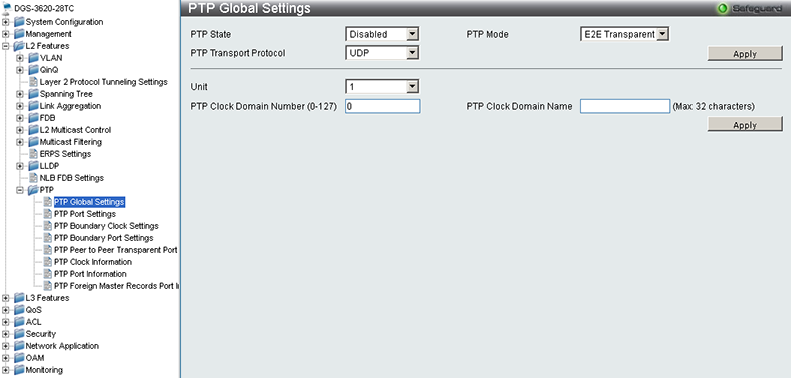

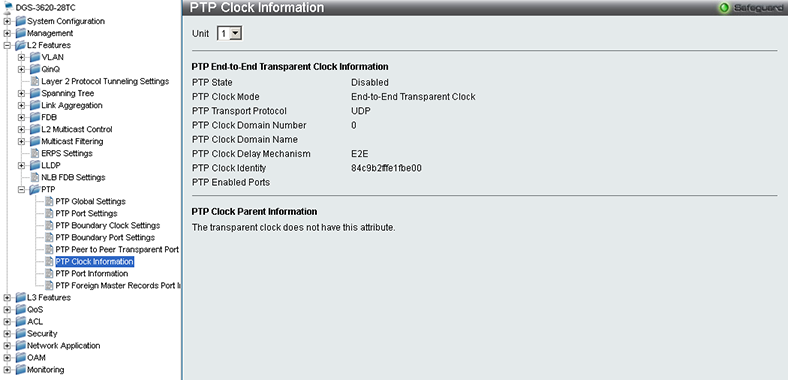

Получение очень точного времени производится с помощью протокола PTP, опции которого собраны в одноимённой подгруппе.

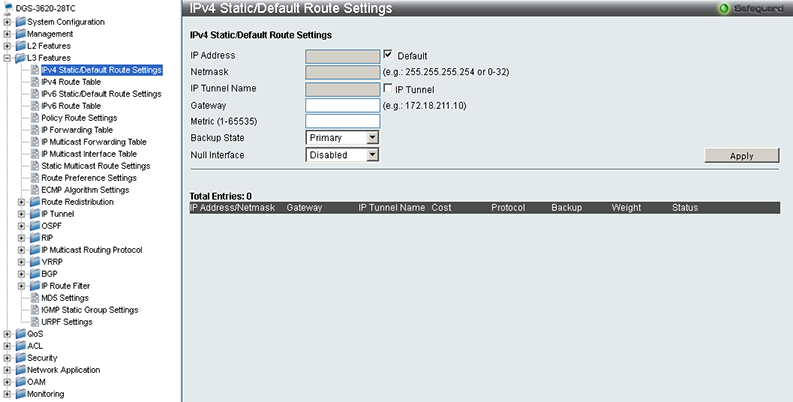

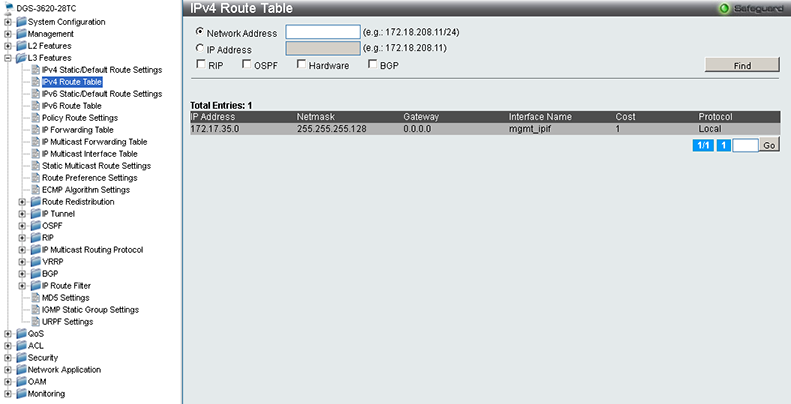

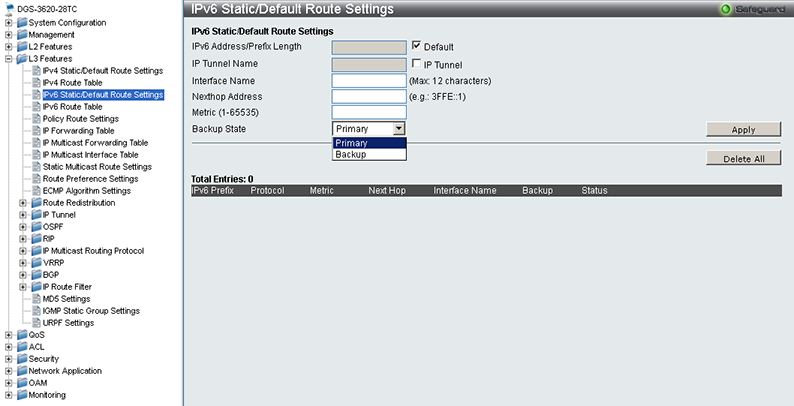

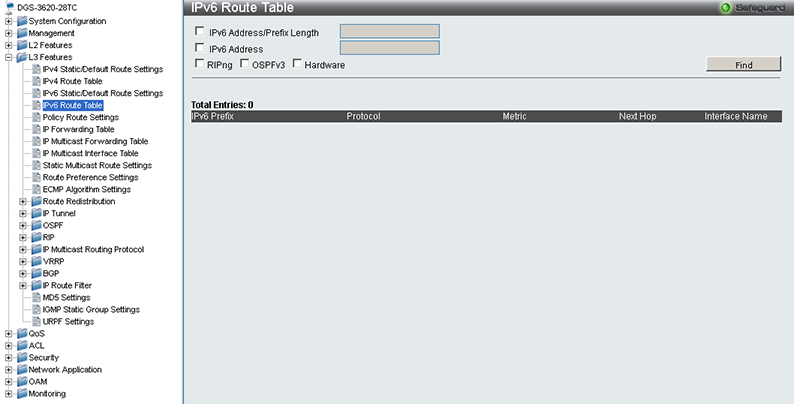

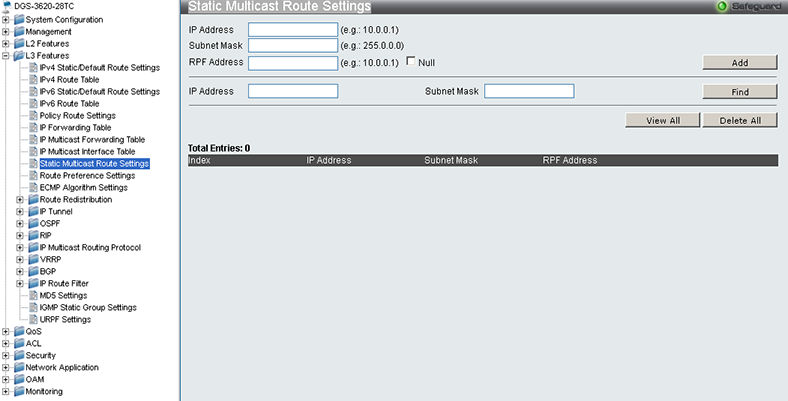

Управление статической маршрутизацией производится с помощью первых четырёх подпунктов группы L3 Features. Статические маршруты для группового вещания могут быть заданы в подпункте Static Multicast Route Settings.

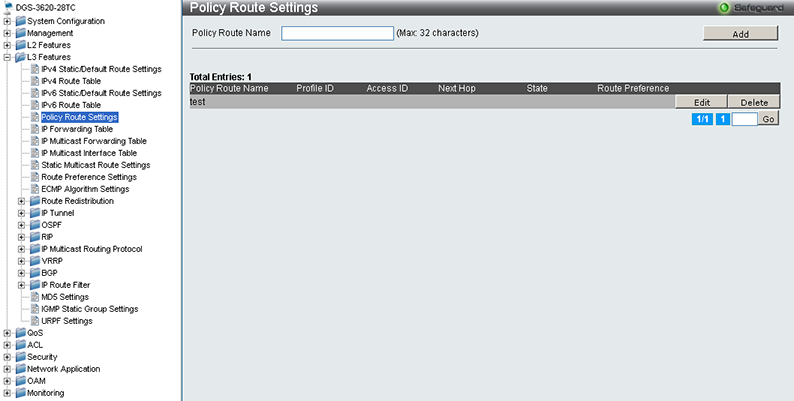

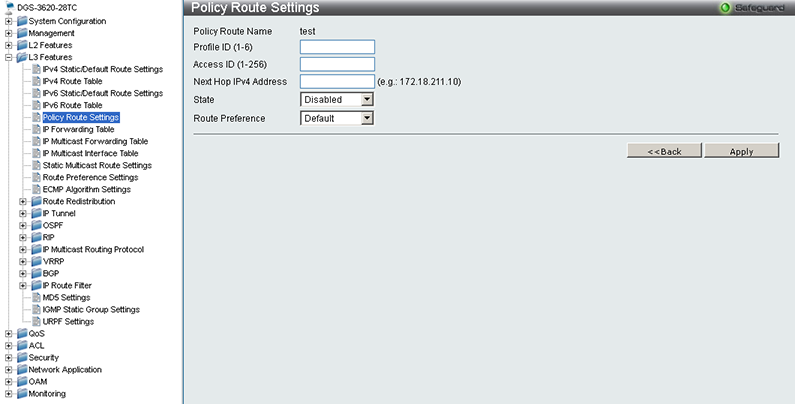

Тестируемый L3-коммутатор поддерживает маршрутизацию по условию, соответствующая настройка доступна в подпункте Policy Route Settings той же группы.

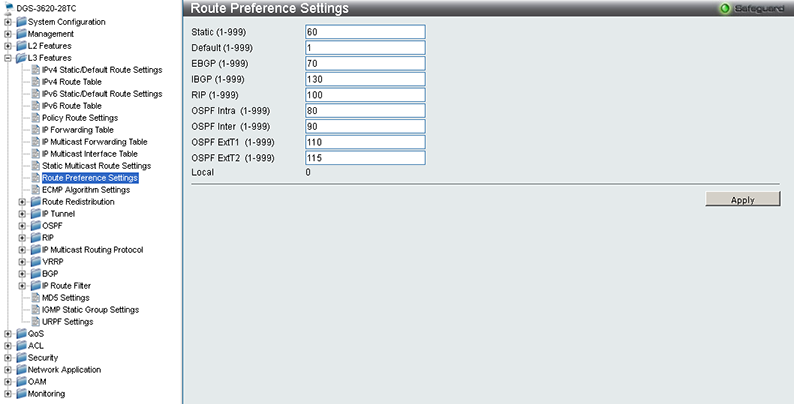

Приоритет маршрута, полученного через разные протоколы динамической маршрутизации, задаётся с помощью административной дистанции, изменить которую можно с помощью подпункта Route Preference Settings группы L3 Features.

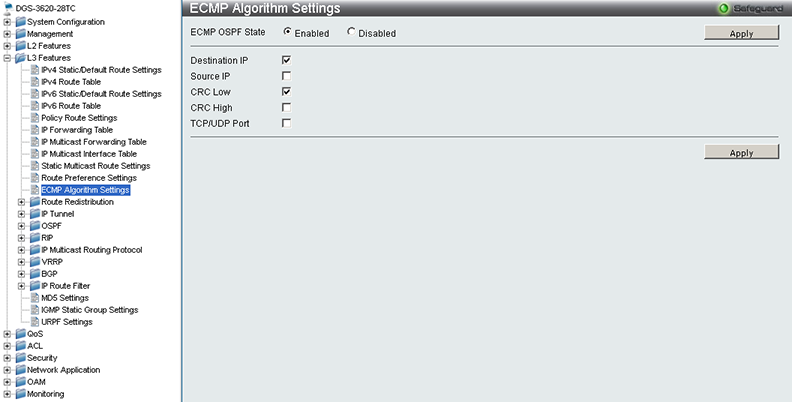

Правила балансировки нагрузки между одинаковыми (с точки зрения OSPF) маршрутами можно изменить в подпункте ECMP Algorithm Settings.

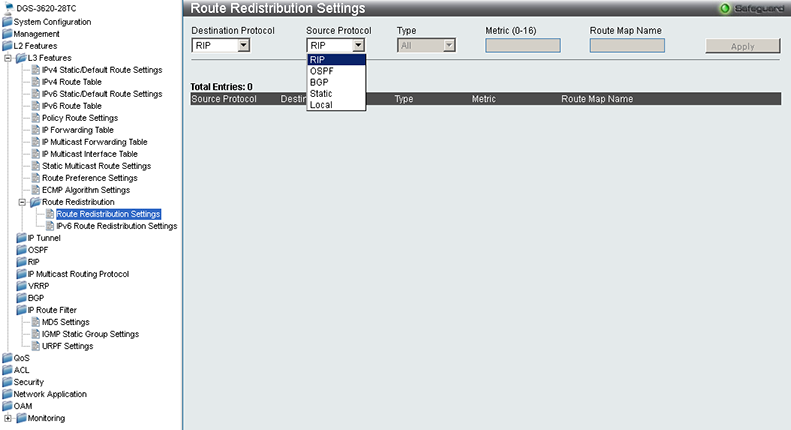

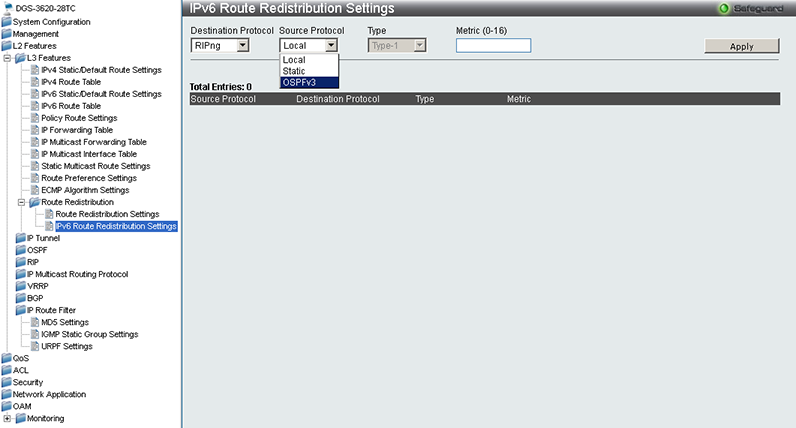

Передача маршрутов между различными протоколами маршрутизации производится с помощью подпунктов подгруппы Route Redistribution.

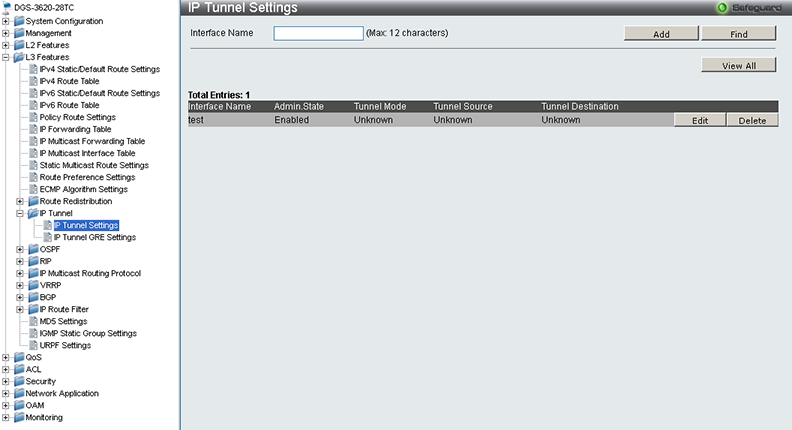

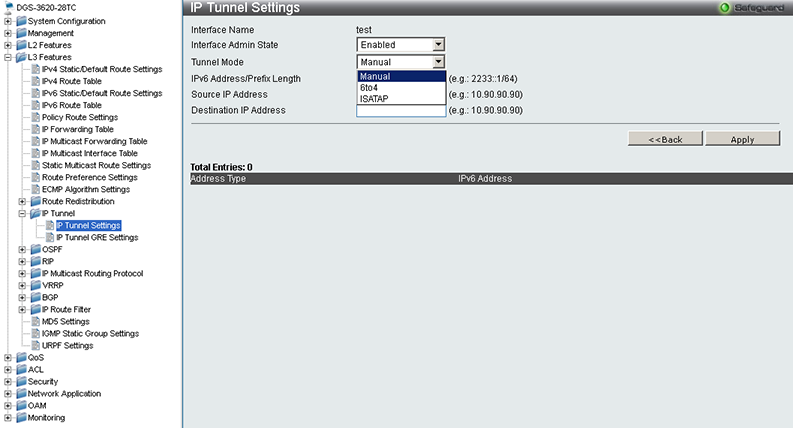

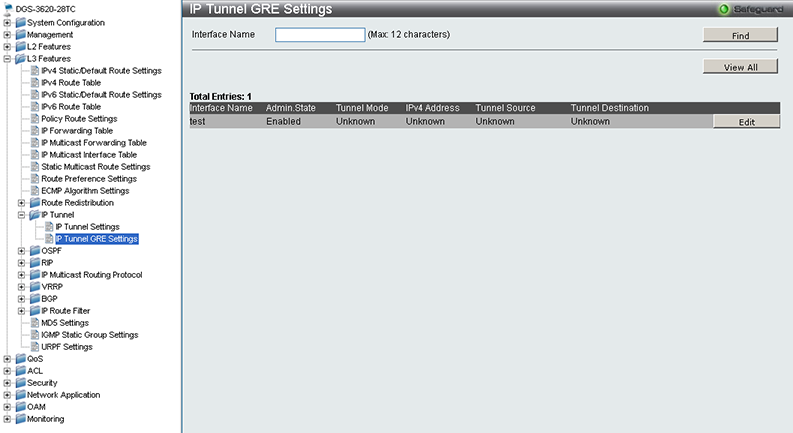

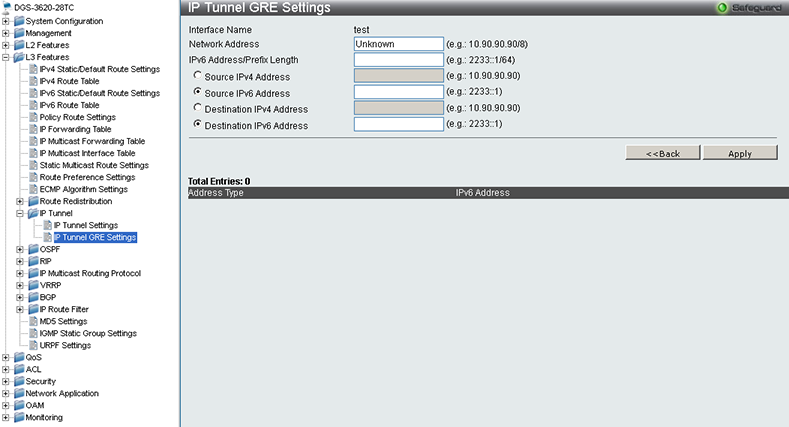

Управление туннелями 6to4, ISATAP и GRE производится с помощью подгруппы IP Tunnel.

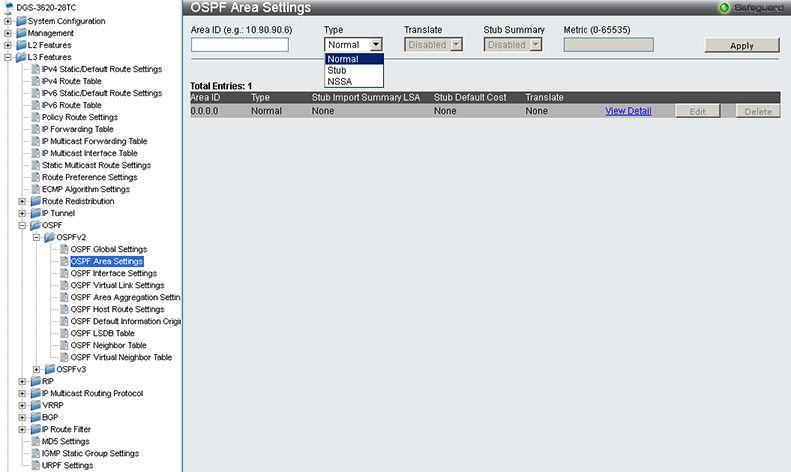

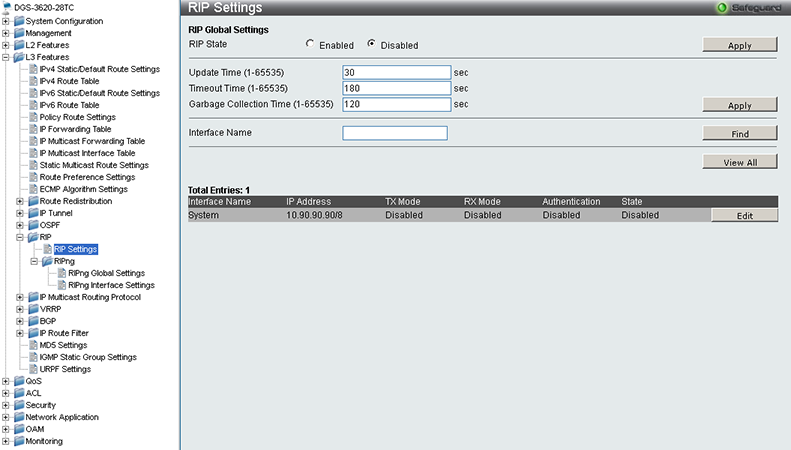

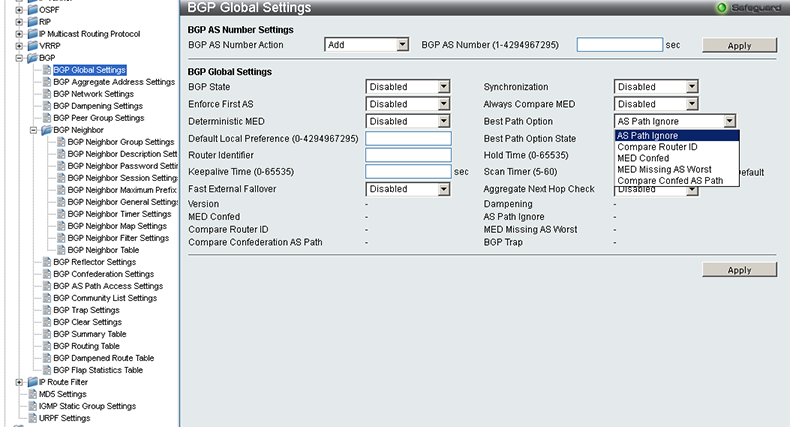

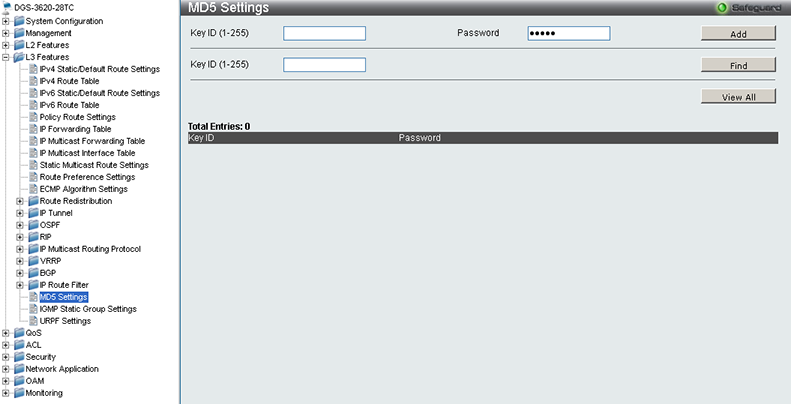

Доступ к параметрам работы протоколов динамической маршрутизации OSPF, RIP и BGP можно получить с помощью одноимённых подгрупп. Настройка аутентификации OSPF производится в подпункте MD5 Settings.

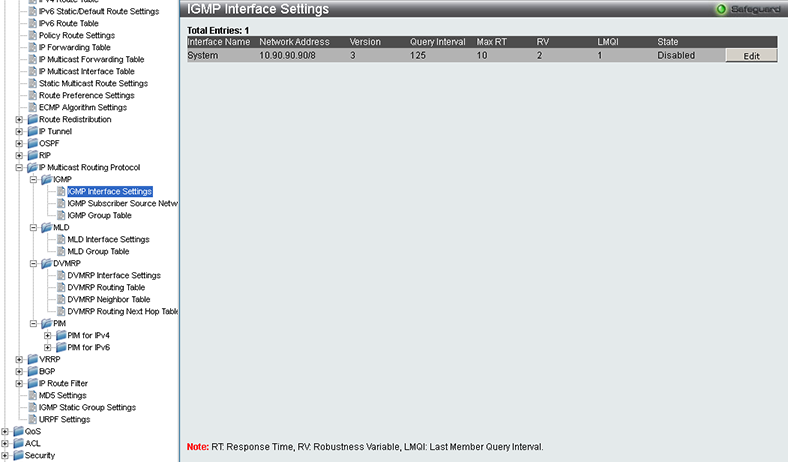

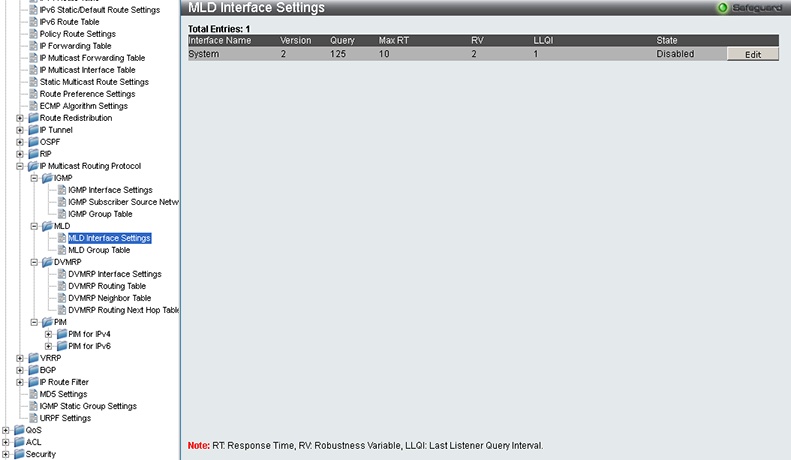

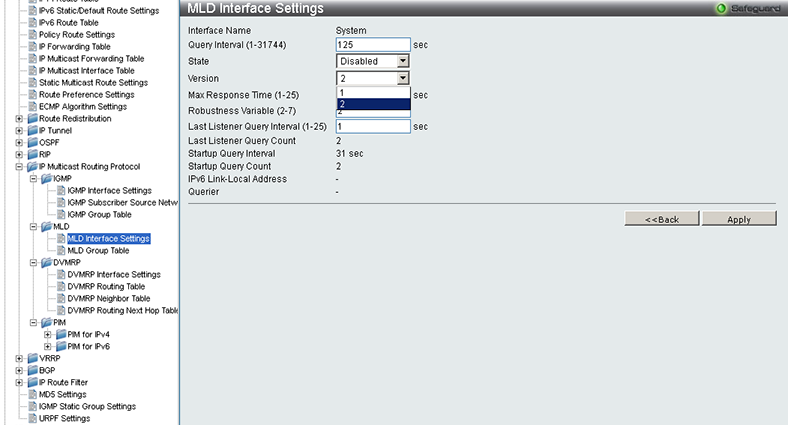

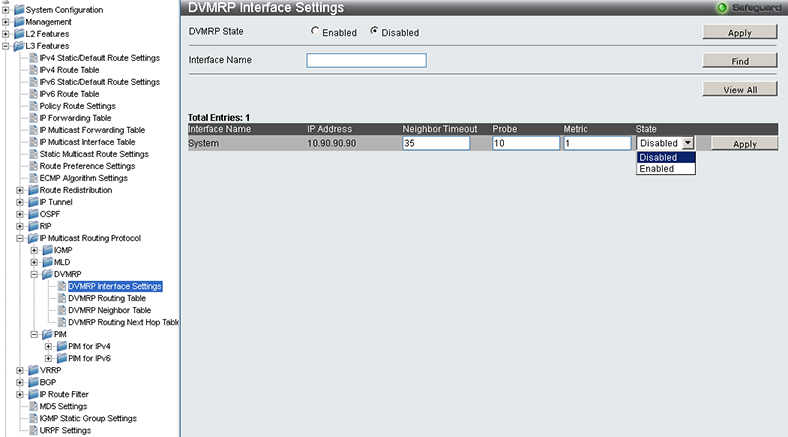

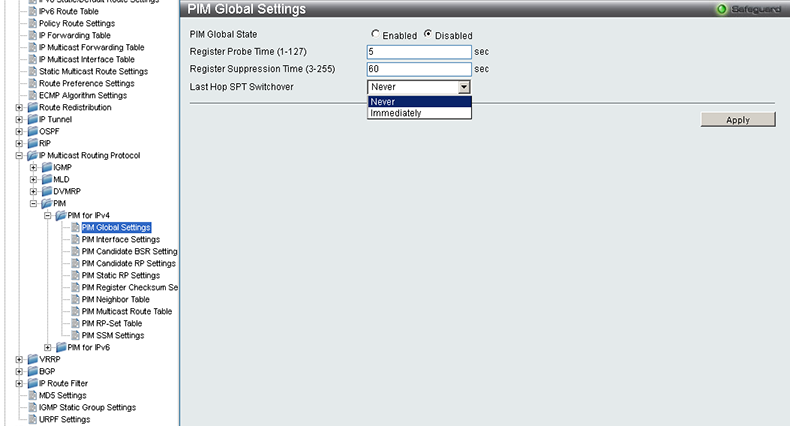

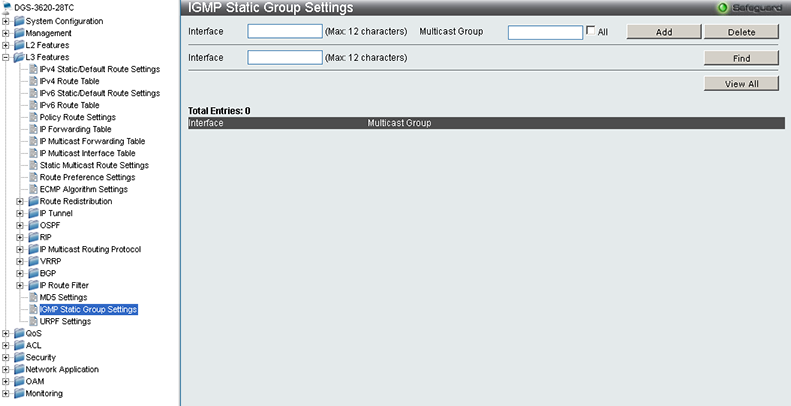

Настройка маршрутизации для группового трафика производится с использованием элементов подгруппы IP Multicast Routing Protocol, а также с помощью подпункта IGMP Static Group Settings.

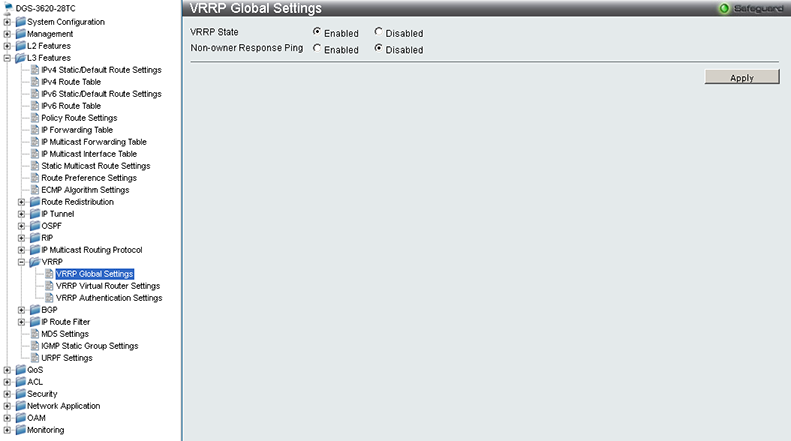

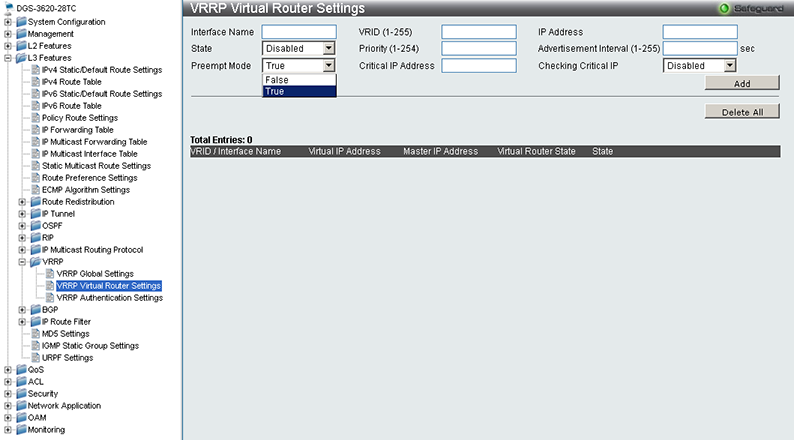

Правильной практикой построения сети является использование такой топологии, в которой все важные элементы продублированы. Такое дублирование можно провести с помощью протокола VRRP, настройка которого представлена в одноимённой подгруппе.

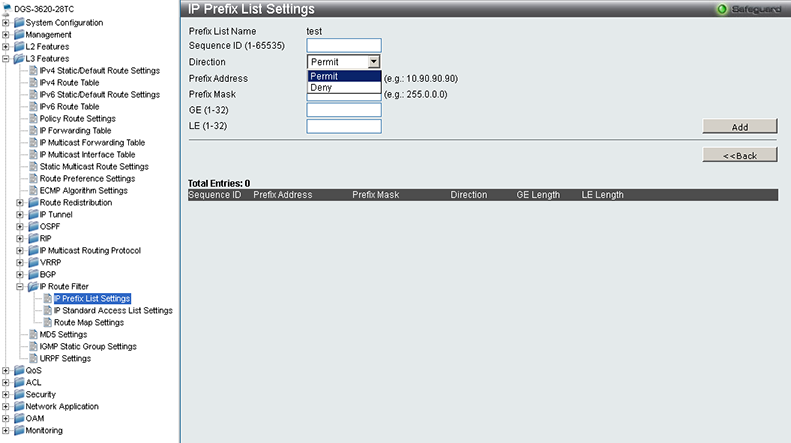

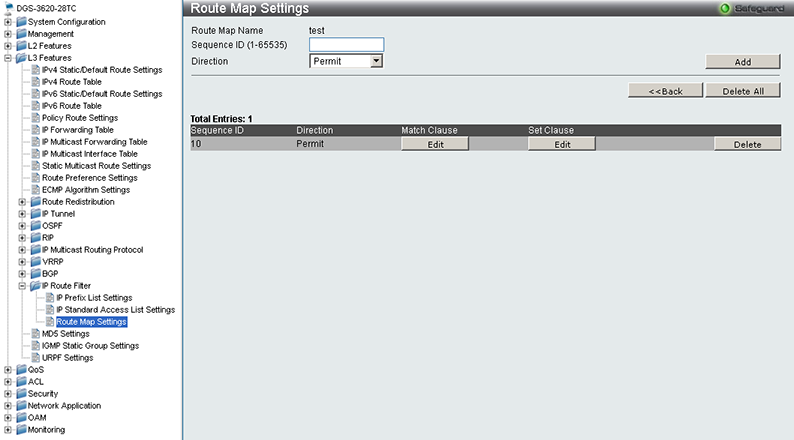

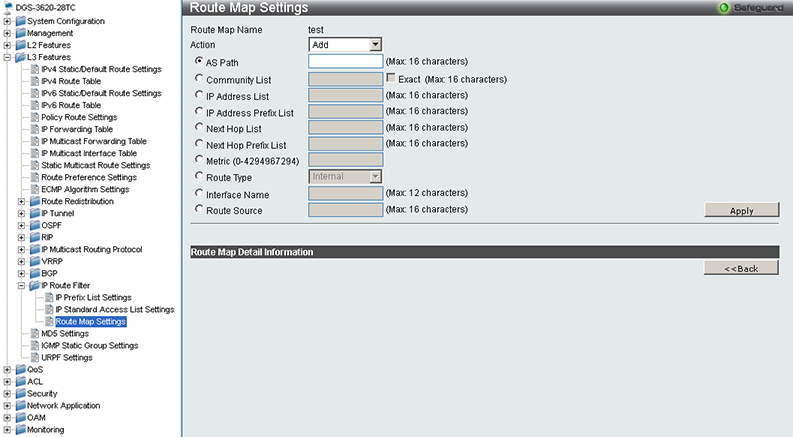

Подгруппа IP Route Filter позволяет администратору указать правила распространения маршрутной информации об определённых подсетях.

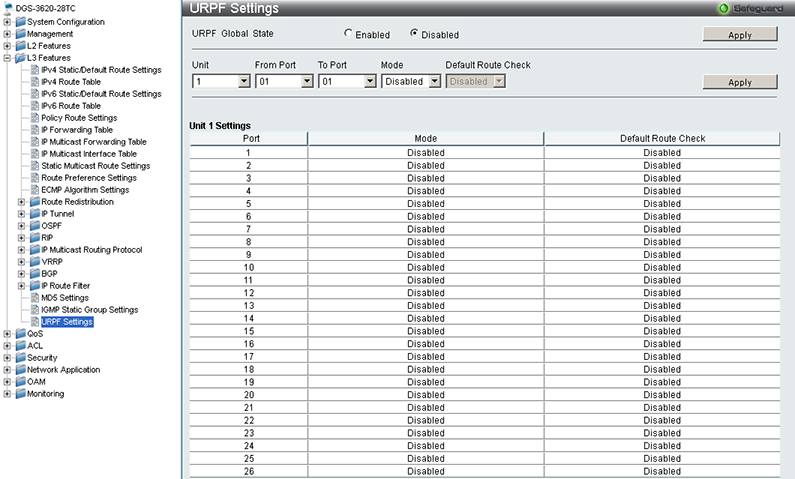

Пункт URPF Settings предназначен для включения на определённых физических портах функции защиты от спуфинга (URPF – Unicast Reverse Path Forwarding).

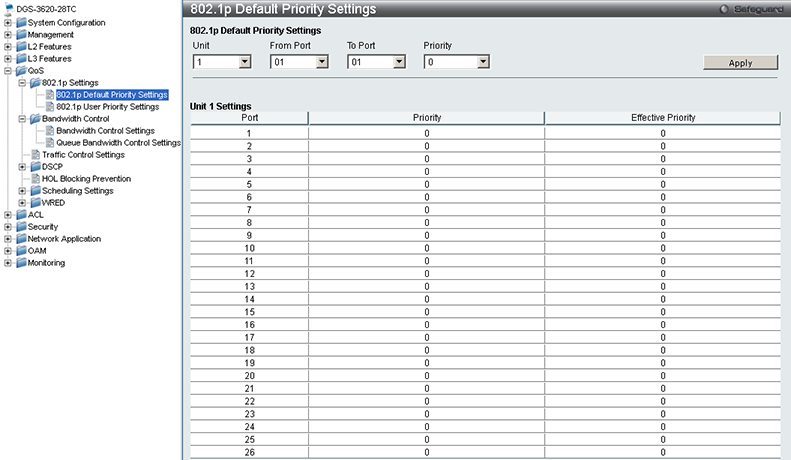

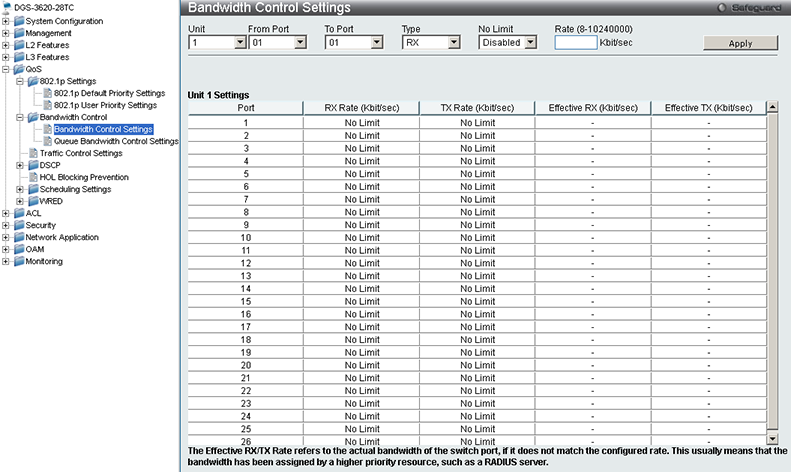

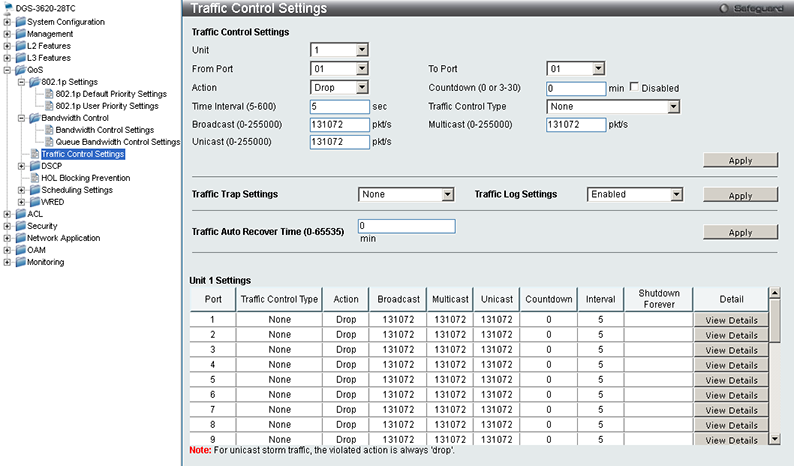

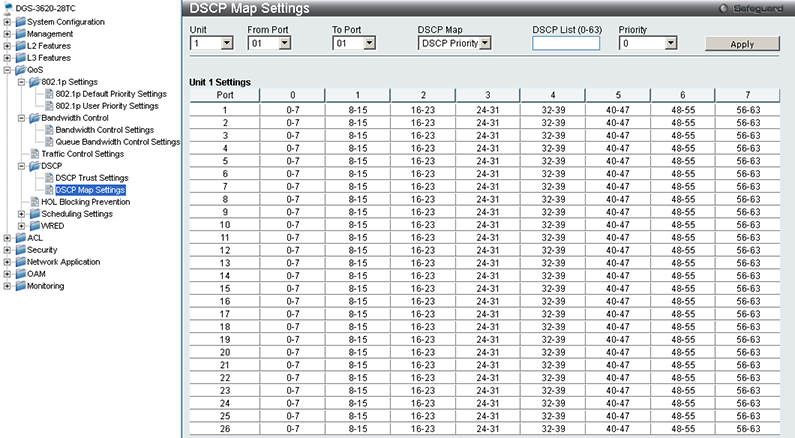

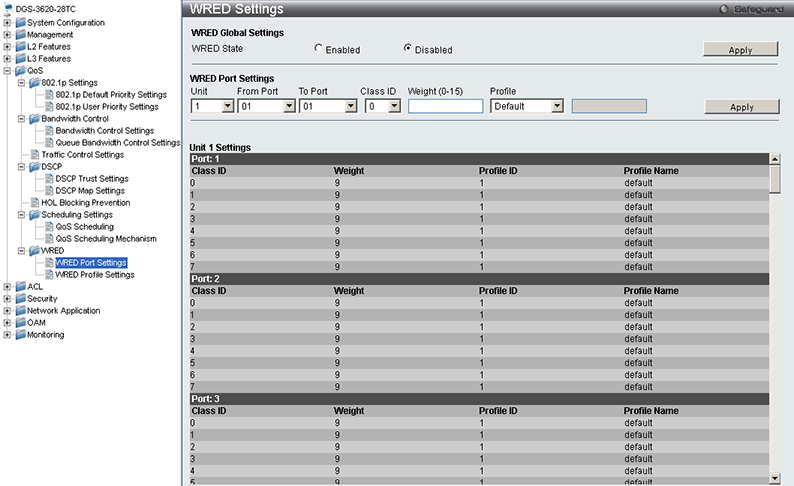

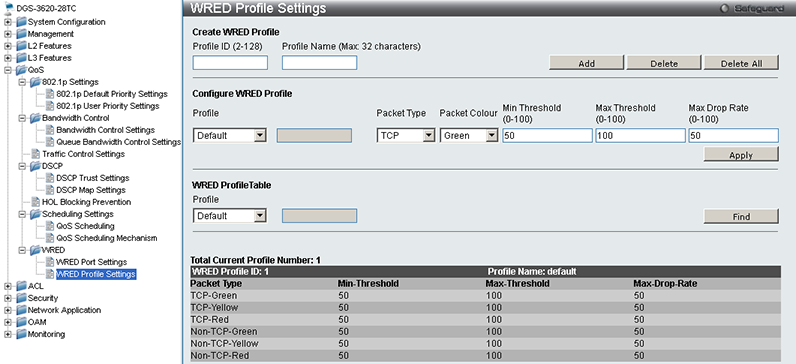

Настройки протокола 802.1p, параметры ограничения трафика и прочие опции, связанные с обеспечением качества обслуживания, собраны в группе QoS.

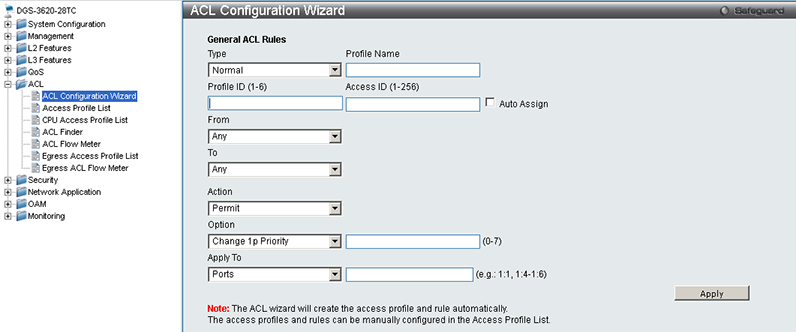

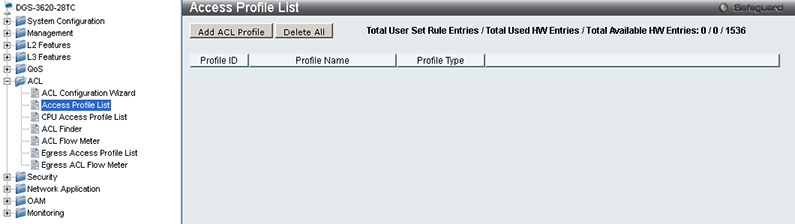

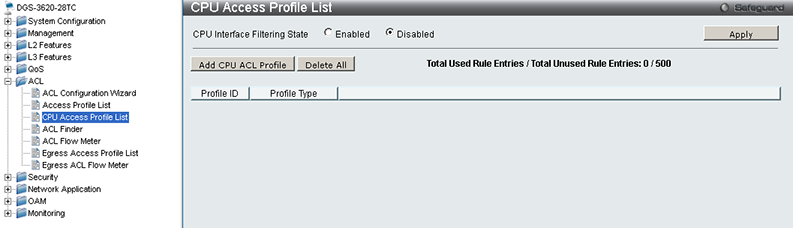

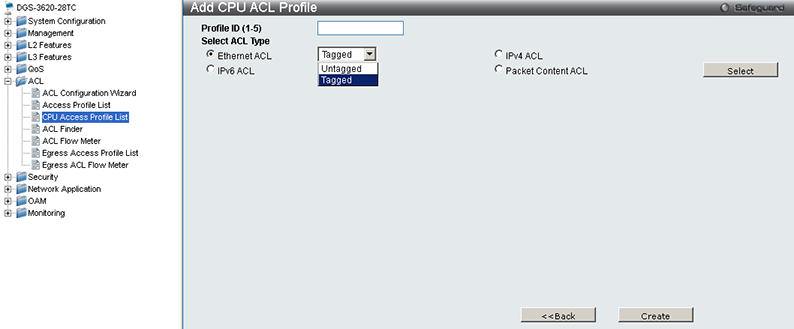

Управление списками доступа производится с помощью подпунктов группы ACL. Приятной опцией является возможность фильтрации трафика, обрабатываемого самим коммутатором.

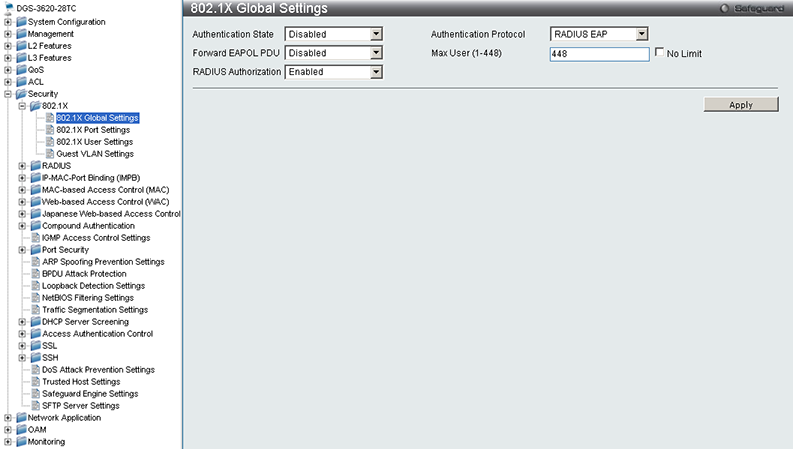

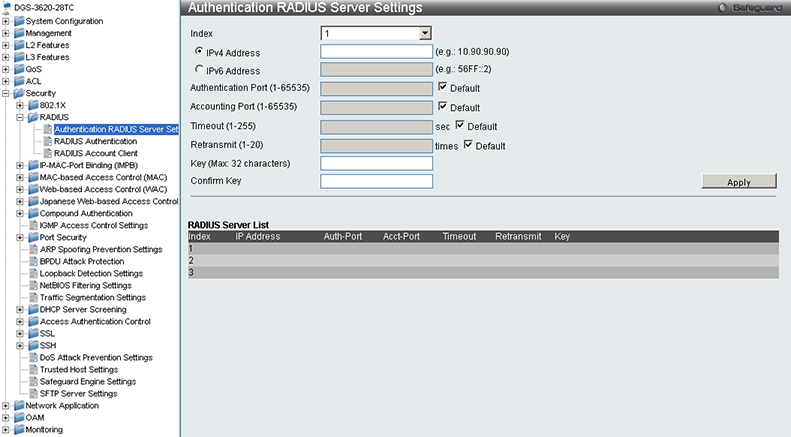

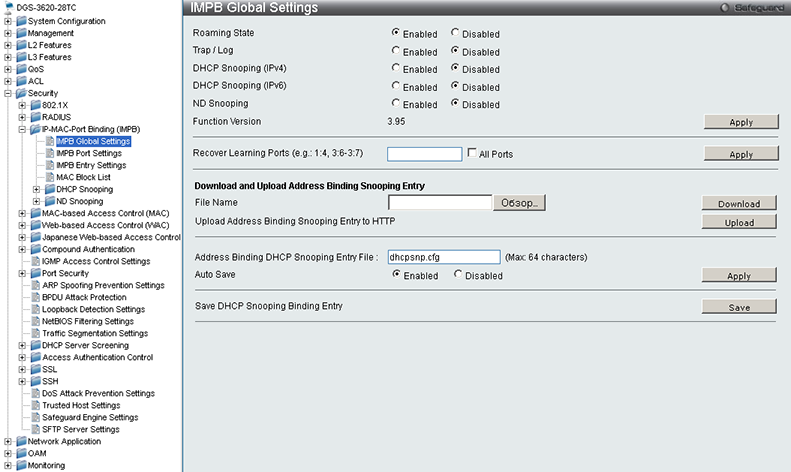

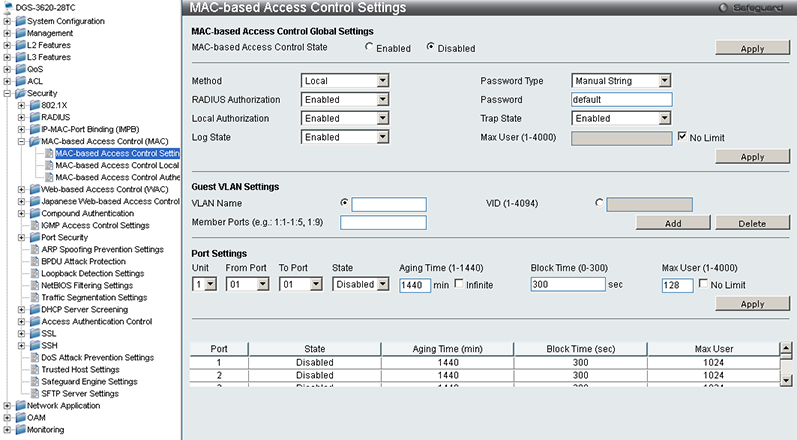

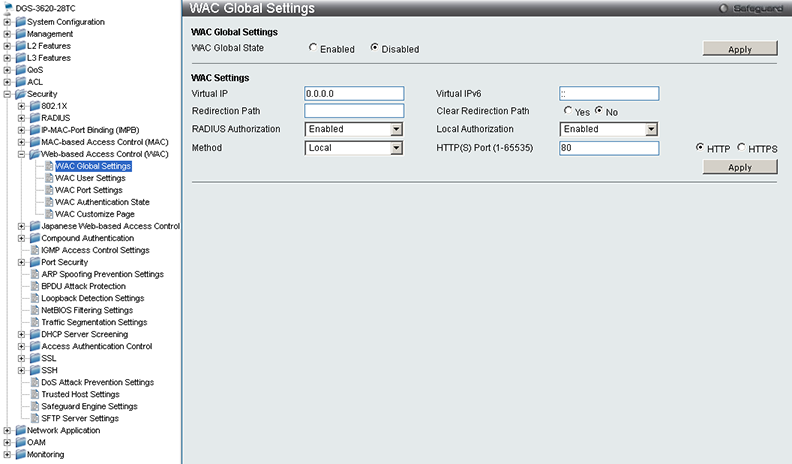

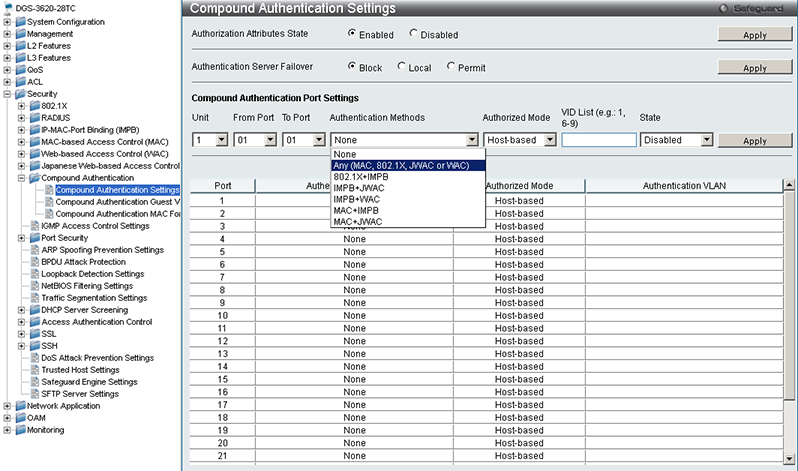

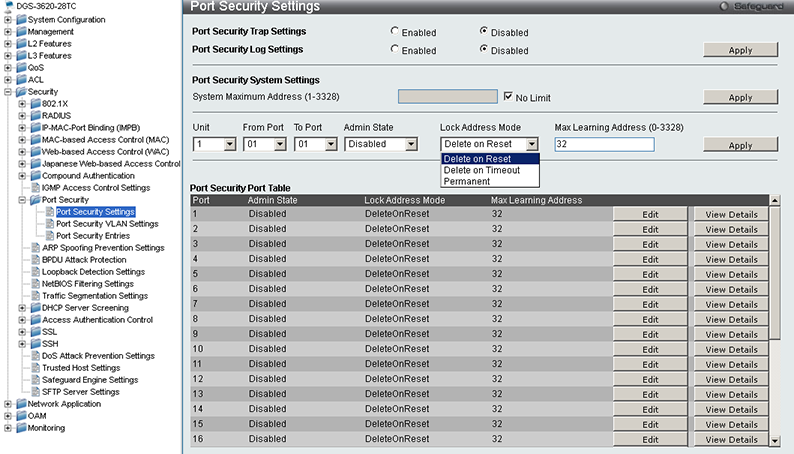

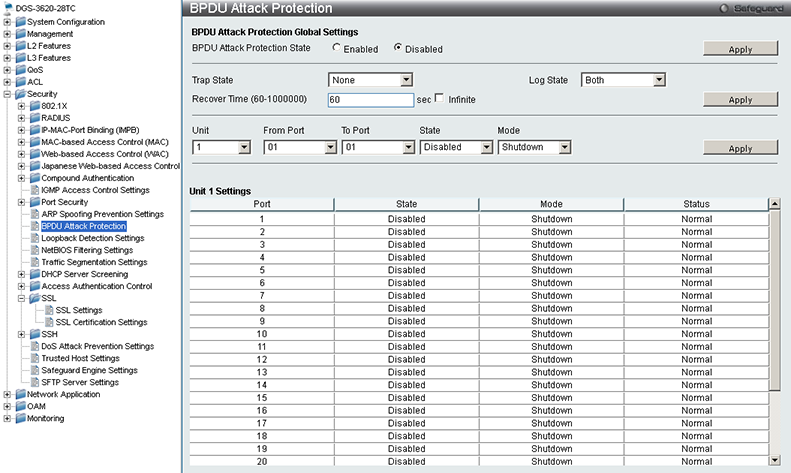

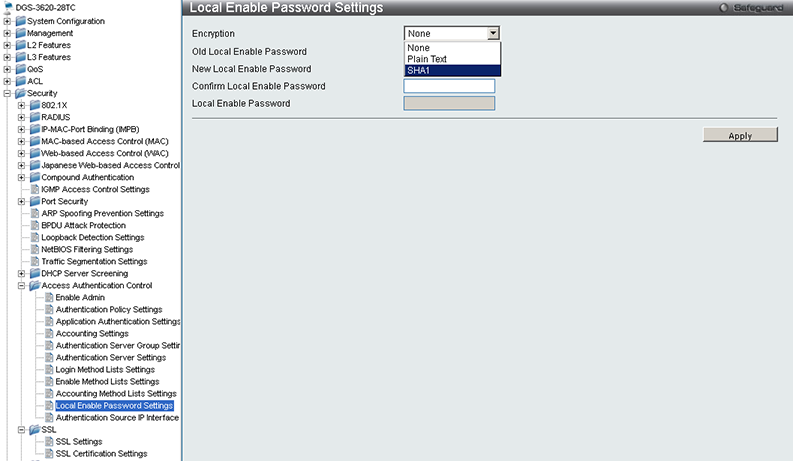

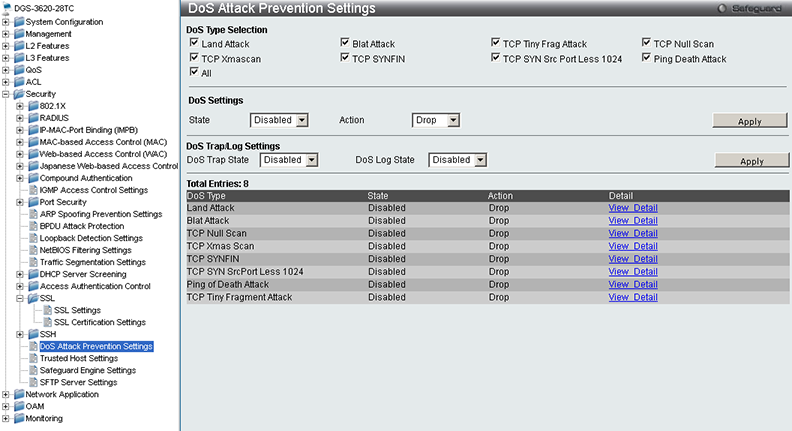

Группа Security отвечает за работу с протоколом 802.1X, RADIUS аутентификацию, привязку IP и MAC адресов к порту, списки доступа MAC-уровня, аутентификацию пользователя по протоколу HTTP, защиту от сетевых атак, обнаружение петель, доступ администратора к коммутатору.

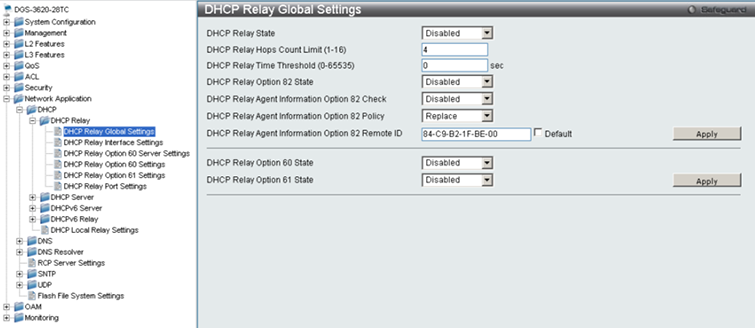

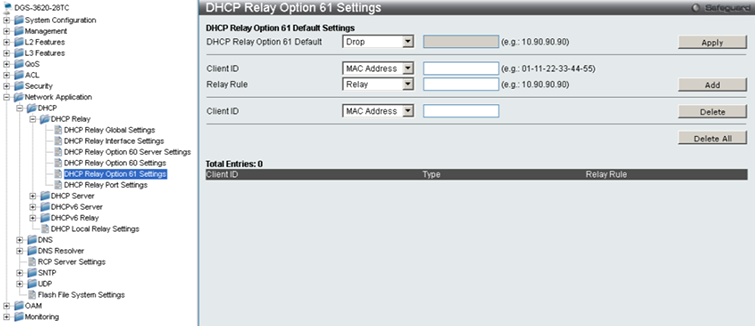

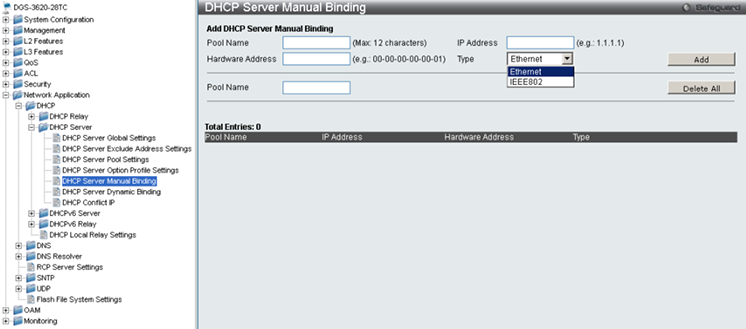

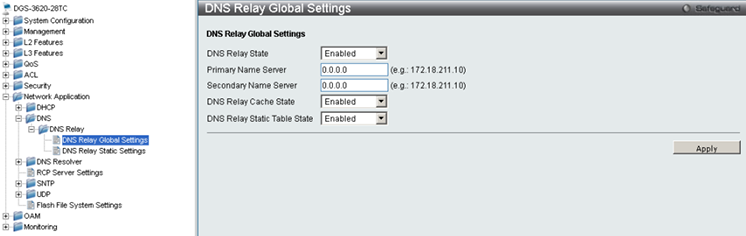

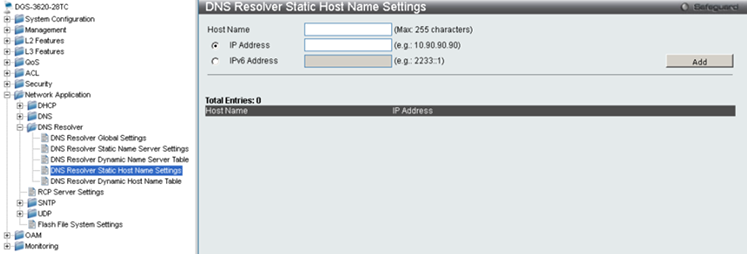

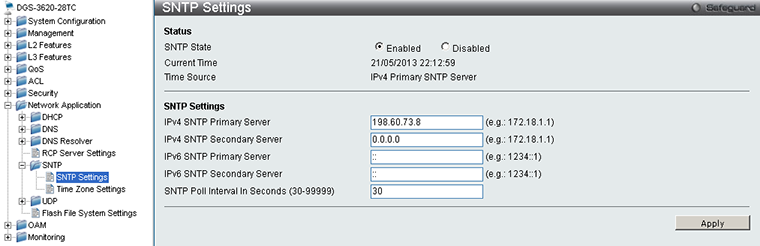

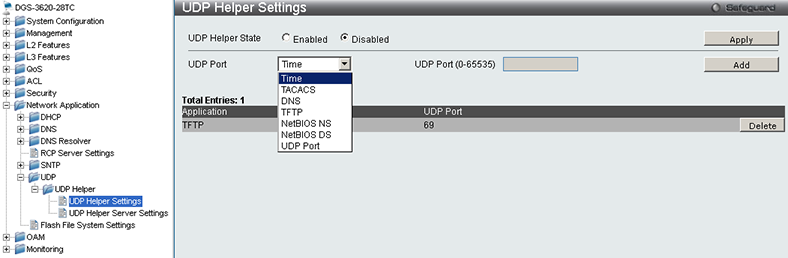

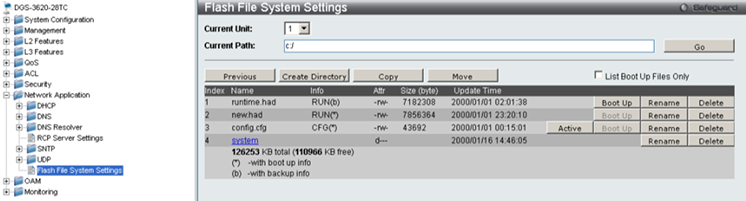

Кроме выполнения основных функций (коммутация и маршрутизация) D-Link DGS-3620-28TC может выполнять также целый ряд вспомогательных, заменяя собой ряд слабонагруженных серверов в сети. К числу таких функций можно отнести возможность работы устройства в качестве DHCP-сервера и ретранслятора для четвёртой и шестой версий протокола IP, DNS посредника, SNTP-сервера. Для доступа к указанным функциям необходимо обратиться к группе Network Application. Также здесь можно просмотреть содержимое встроенной флеш-памяти и выполнить некоторые операции с ней. Стоит также отметить, что подпункт UDP Helper пункта UDP позволяет настроить проброс определённых UDP-дейтаграмм на специализированный сервер.

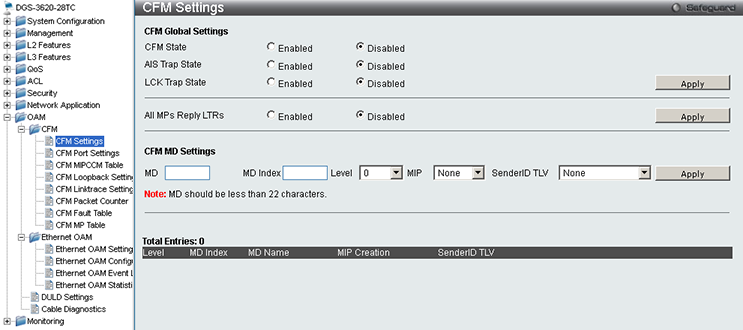

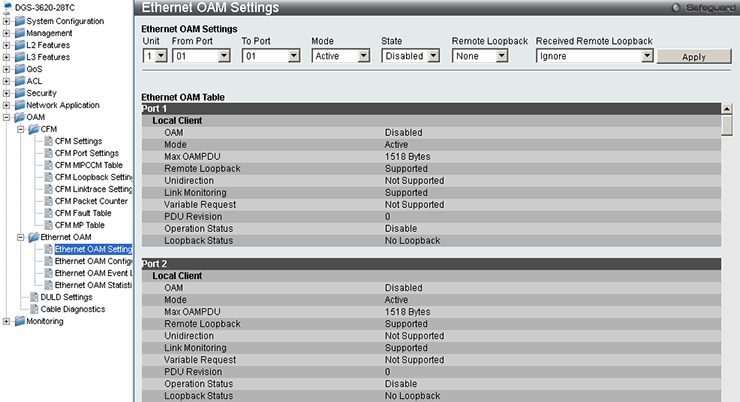

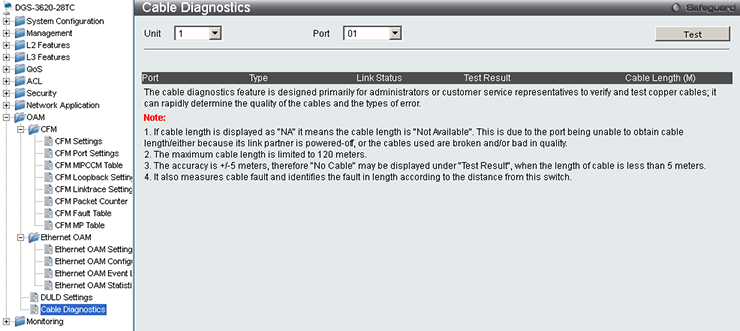

Кабельная диагностика доступна в группе OAM, здесь же можно изменить параметры, относящиеся к поддержке стандарта 802.1ag.

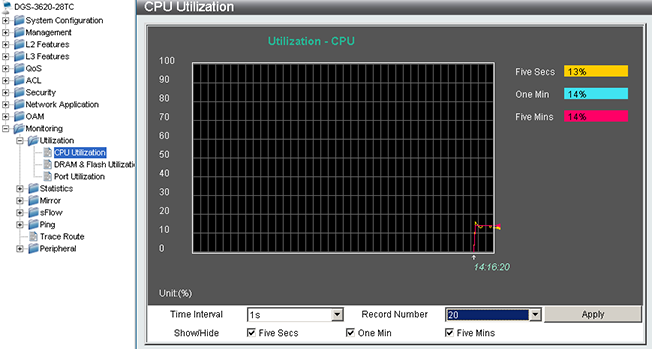

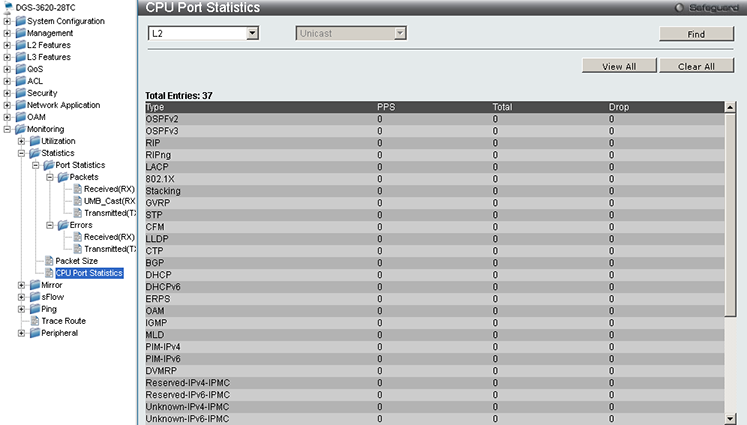

Пункты подгруппы Utilization группы Monitoring отображают загрузку процессора, оперативной и флеш-памяти устройства. Здесь же можно посмотреть использование физических портов. Статистические сведения о работе портов представлены в подгруппе Statistics.

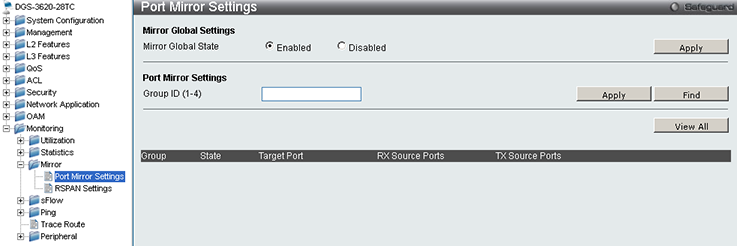

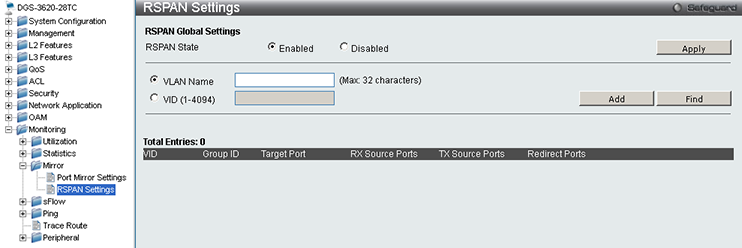

Коммутатор D-Link DGS-3620-28TC поддерживает SPAN и RSPAN сессии, соответствующие настройки доступны в подгруппе Mirror.

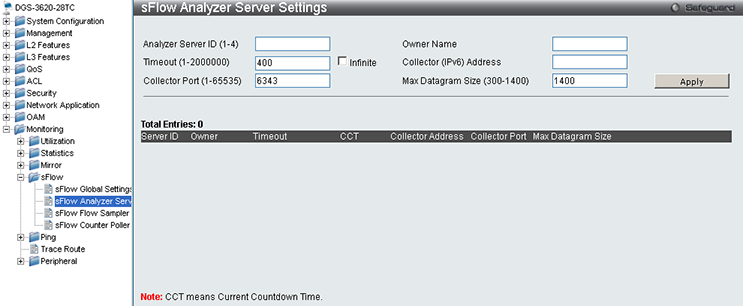

Для настройки sFlow необходимо обратиться к одноимённой подгруппе.

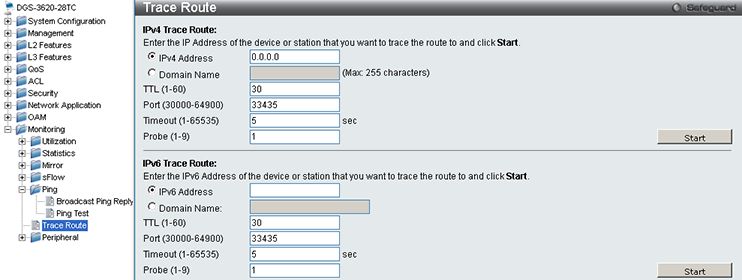

Проверить связность сети можно с помощью подгруппы Ping и пункта Trace Route.

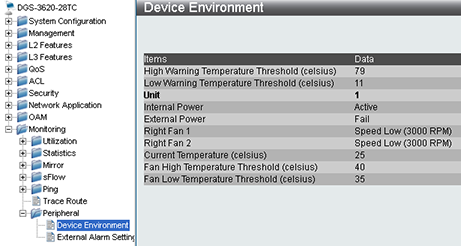

Просмотреть температуры внутри корпуса, проверить скорость вращения вентиляторов, а также установить наличие иных аварийных событий можно с помощью подпункта Peripheral.

На этом мы завершаем рассмотрение веб-интерфейса коммутатора и переходим к изучению возможностей интерфейса командной строки.

Командная строка

Для доступа к командной строке устройства допустимо использование протоколов telnet и SSH, которые должны быть разрешены в соответствующих пунктах веб-интерфейса.

Мы не станем подробно описывать все возможности командной строки коммутатора, отметим лишь, что производитель считает такой инструмент настройки более гибким. Практически все команды можно отнести к нескольким крупным группам: команды очистки или сброса текущего состояния – clear, команды настройки – config, создания и удаления виртуальных объектов – create и delete, отладки – debug, включения и отключения – enable и disable, а также просмотровые – show. Полный список команд мы вынесли в отдельный файл.

Так, например, нас заинтересовала команда show utilization dram, отображающая занятость оперативной памяти. Из её вывода становится ясно, что коммутатор DGS-3620-28TC не может быть использован для получения BGP full-view, насчитывающую на сегодняшний день около полумиллиона записей.

DGS-3620-28TC:admin#show utilization dram

Command: show utilization dram

DRAM utilization :

Total DRAM : 262144 KB

Used DRAM : 253073 KB

Utilization : 96 %

Выяснить, кто управляет коммутатором в данный момент можно с помощью команды show session.

DGS-3620-28TC:admin#show session

Command: show session

ID Live Time From Level User

--- ------------ --------------------------------------- ----- ---------------

8 08:47:34.070 Serial Port login Anonymous

24 00:21:29.120 172.17.35.36 admin Anonymous

Total Entries: 2

Чтобы просмотреть мостовую таблицу, необходимо выполнить команду show fdb. В нашем случае мостовая таблица была пуста.

DGS-3620-28TC:admin#sho fdb

Command: show fdb

Unicast MAC Address Aging Time = 300

VID VLAN Name MAC Address Port Type Status

---- -------------------------------- ----------------- ----- ------- -------

1 default 84-C9-B2-1F-BE-00 CPU Self Forward

Total Entries: 1

Информация о работающих службах представлена в выводе команды show switch.

DGS-3620-28TC:admin#show switch

Command: show switch

Device Type : DGS-3620-28TC Gigabit Ethernet Switch

MAC Address : 84-C9-B2-1F-BE-00

IP Address : 10.90.90.90 (Manual)

VLAN Name : default

Subnet Mask : 255.0.0.0

Default Gateway : 0.0.0.0

Boot PROM Version : Build 1.00.016

Firmware Version : Build 2.50.017

Hardware Version : A1

Firmware Type : EI

Serial Number : PVXF1B8000113

System Name :

System Location :

System Uptime : 5 days, 8 hours, 50 minutes, 28 seconds

System Contact :

Spanning Tree : Enabled

GVRP : Disabled

IGMP Snooping : Disabled

MLD Snooping : Disabled

RIP : Disabled

RIPng : Disabled

DVMRP : Disabled

PIM : Disabled

PIM6 : Disabled

OSPF : Disabled

OSPFv3 : Disabled

BGP : Disabled

VLAN Trunk : Disabled

Telnet : Enabled (TCP 23)

Web : Enabled (TCP 80)

SNMP : Disabled

SSL Status : Disabled

SSH Status : Enabled

802.1X : Disabled

Jumbo Frame : Off

CLI Paging : Enabled

MAC Notification : Disabled

Port Mirror : Disabled

SNTP : Disabled

DHCP Relay : Disabled

DNSR Status : Disabled

VRRP : Disabled

HOL Prevention State : Enabled

Syslog Global State : Disabled

Single IP Management : Disabled

Password Encryption Status : Disabled

DNS Resolver : Disabled

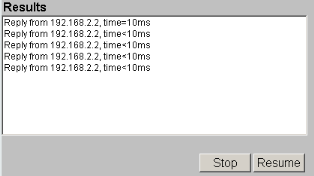

Кроме указанных групп команд существует ещё и ряд других системных вызовов, не относящихся напрямую к той или иной группе. Так, например, с помощью команд ping и traceroute можно проверить связность сети.

DGS-3620-28TC:admin#ping 8.8.8.8

Command: ping 8.8.8.8

Reply from 8.8.8.8, time=10ms

Reply from 8.8.8.8, time=10ms

Reply from 8.8.8.8, time=10ms

Reply from 8.8.8.8, time=10ms

Ping Statistics for 8.8.8.8

Packets: Sent =4, Received =4, Lost =0

В разделе тестирования мы будем собирать схему для проверки работоспособности функции VLAN translation, для чего будем использовать веб-интерфейс устройства. Того же самого можно добиться и с применением командной строки.

DGS-3620-28TC:admin#create vlan_translation ports 8 replace cvid 3 svid 2 priority 0

Command: create vlan_translation ports 8 replace cvid 3 svid 2 priority 0

Success.

DGS-3620-28TC:admin#show vlan_translation

Command: show vlan_translation

Port CVID SPVID Action Priority

----- -------- -------- ------- ---------

8 3 2 Replace 0

14 3 2 Replace -

Total Entries: 2

Сохранение настроек производится с помощью команды save.

DGS-3620-28TC:admin#save

Command: save

Saving all configurations to NV-RAM.......... Done.

На этом мы завершаем беглое рассмотрение возможностей интерфейса командной строки коммутатора D-Link DGS-3620-28TC и переходим к его тестированию.

Тестирование

Данный раздел мы традиционно начинаем с установления времени загрузки устройство, под которым мы понимаем интервал времени, прошедший с момента подачи питания на коммутатор, до получения первого эхо-ответа по протоколу ICMP. D-Link DGS-3620-28TC загружается за 35 секунд, что является неплохим значением.

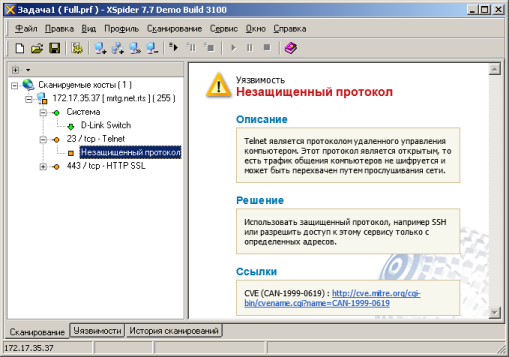

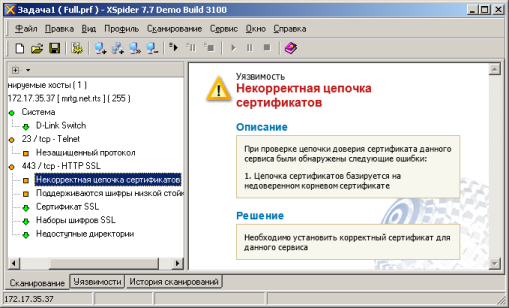

Второй тест – проверка защищённости устройства, выполняемый нами с использованием сканера сетевой безопасности Positive Technologies XSpider 7.7 (Demo build 3100). Сканирование производилось со стороны интерфейса управления. Всего было обнаружено два открытых порта: TCP-23 (Telnet) и TCP-443 (HTTP SSL). Наиболее интересные обнаруженные сведения представлены ниже.

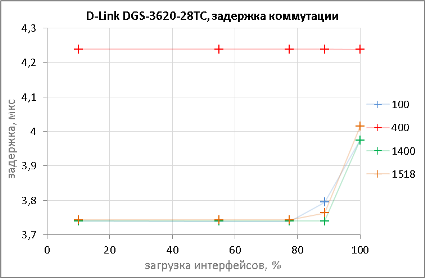

Обычно современные коммутаторы без проблем справляются с задачей передачи фреймов на скорости среды, поэтому мы не стали измерять производительность устройства при выполнении коммутации и маршрутизации. Вместо этого мы провели измерения задержки, вносимой DGS-3620-28TC при коммутации и маршрутизации для фреймов размером 100, 400, 1400 и 1518 байт. Тесты проводились при различной загрузке интерфейсов на скорости подключения в 1 Гбит/с. Основные параметры использованного оборудования представлены ниже.

| Компонент | ПК | Ноутбук |

| Материнская плата | ASUS Maximus V Extreme | ASUS M60J |

| Процессор | Intel Core i7 3770K 3.5 ГГц | Intel Core i7 720QM 1.6 ГГц |

| Оперативная память | DDR3 PC3-10700 SEC 32 Гбайта | DDR3 PC3-10700 SEC 16 Гбайт |

| Сетевая карта | Intel Gigabit CT Desktop Adapter | Atheros AR8131 |

| Операционная система | Windows 7 x64 SP1 Rus | Windows 7 x64 SP1 Rus |

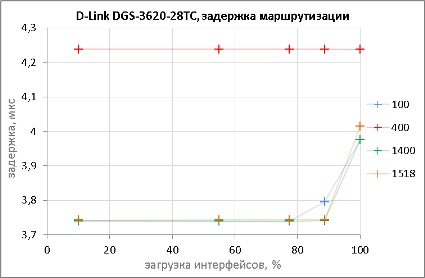

На диаграммах ниже представлены задержки на коммутацию и маршрутизацию, вносимые коммутатором D-Link DGS-3620-28TC.

На обоих графиках задержки при передаче фреймов размером 400 байт ощутимо больше задержек, наблюдаемых для фреймов других размеров. Мы не можем объяснить полученный результат, однако даже задержка для 400-байтных кадров находится в пределах нормы. Средняя задержка, вносимая тестируемым L3-коммутатором, составляет примерно 4 мкс, что, на наш взгляд, является неплохим результатом для устройств подобного класса. При увеличении загрузки сетевых интерфейсов, через которые осуществлялась передача тестовых фреймов, задержка также незначительно увеличивалась, оставаясь в допустимых пределах. Полученные данные лучше тех, что мы наблюдали для коммутаторов Cisco Catalyst 3750G ранее.

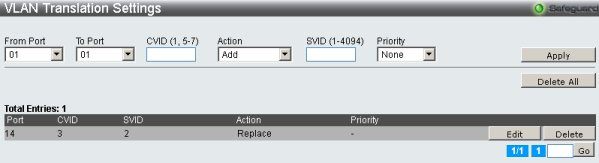

Одной из интересных и новых для нас возможностей стала функция VLAN translation, являющаяся частью механизма QinQ. Суть VLAN translation состоит в том, что с её помощью можно заменять в тегированных кадрах одно значение VID на другое, то есть переопределять принадлежность к VLAN кадра, полученного через транковый порт. Для проверки работы данного функционала была собрана схема, представленная ниже. Хотелось бы сразу отметить, что подобной цели можно было бы добиться путём установки разных значений Native VLAN на противоположных концах транка, но такая схема работала бы лишь для одной единственной виртуальной сети, тогда как VLAN translation позволяет производить замену сразу для нескольких VID.

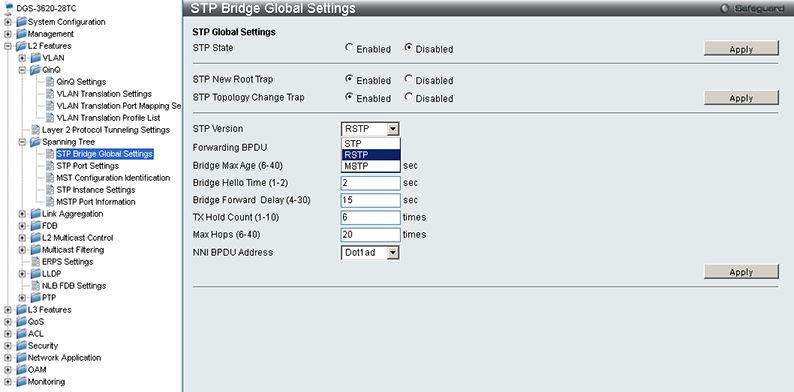

Дополнительным требованием с нашей стороны стало участие всех трёх коммутаторов в STP, что, на наш взгляд, необходимо для полноценной работы сети. Так как STP в его классическом виде безнадёжно устарел, единственным выбором стало использование MST. При пробросе через DGS-3620-28TC BPDU Cisco PVST+ происходило блокирование портов, так как коммутаторы Cisco Catalyst видели BPDU одной виртуальной сети внутри фреймов с тегами другой виртуальной сети. Чтобы не усложнять конструкцию, мы использовали единственный экземпляр STP – MST0. В этот экземпляр были добавлены все существующие на коммутаторах виртуальные сети. Со стороны коммутаторов Cisco Catalyst была произведена нижеследующая настройка.

left(config)#spanning-tree mode mst

left(config)#spanning-tree mst configuration

left(config-mst)#instance 0 vlan 1-4094

На стороне левого коммутатора Cisco Catalyst была создан VLAN 2 и виртуальный интерфейс SVI со следующими параметрами.

interface Vlan2

ip address 192.168.1.1 255.255.255.252

end

На правом коммутаторе – VLAN 3 и соответствующий виртуальный интерфейс.

interface Vlan3

ip address 192.168.1.2 255.255.255.252

end

Между коммутатором C3750G (слева) и DGS-3620-28TC был поднят транк, через который со стороны Cisco Catalyst пропущена виртуальная сеть 2. Для коммутатора C2960 (справа) были выполнены аналогичные настройки, но только с разрешением виртуальной сети 3.

interface GigabitEthernet1/0/1

switchport trunk encapsulation dot1q

switchport trunk allowed vlan 2

switchport mode trunk

load-interval 30

end

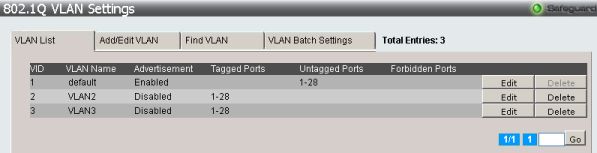

Теперь рассмотрим настройки DGS-3620-28TC. На транковых портах были разрешены VLAN 2 и 3.

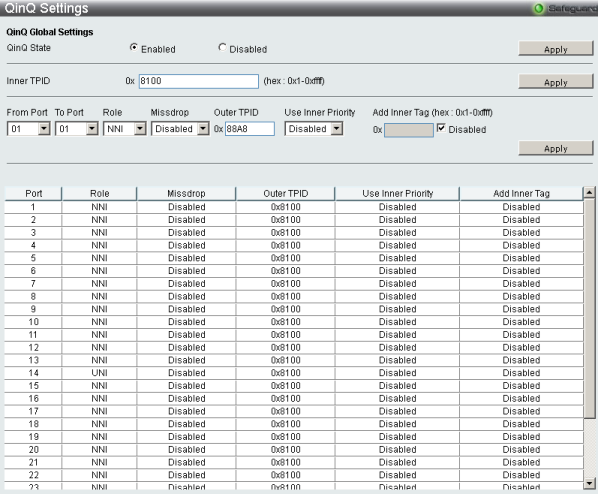

Необходимо также задать роль порта, указать выходной TPID, а также включить QinQ.

Теперь зададим саму трансляцию идентификаторов виртуальных сетей.

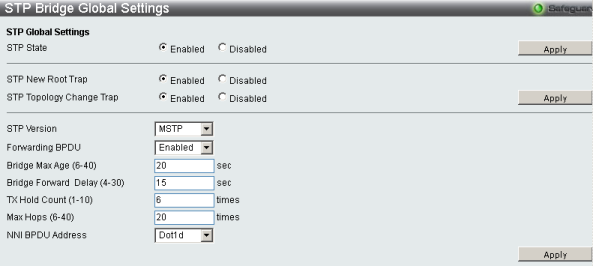

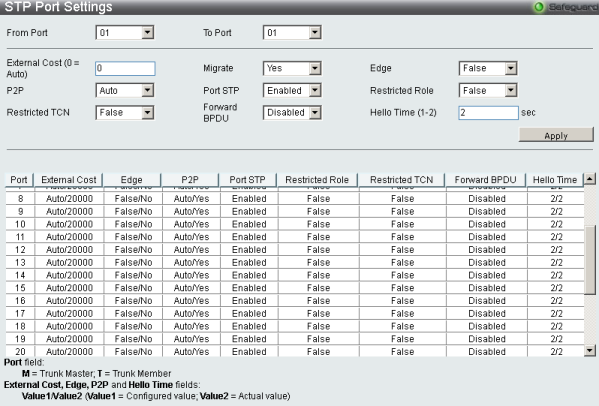

Не стоит также забывать и о настройках Spanning Tree.

Проверкой работоспособности собранной схемы стало успешное хождение ICMP эхо-запросов между SVI-интерфейсами коммутаторов Cisco Catalyst.

right#sho ip int bri | i up

Vlan3 192.168.1.2 YES manual up up

GigabitEthernet0/1 unassigned YES unset up up

right#ping 192.168.1.1

Type escape sequence to abort.

Sending 5, 100-byte ICMP Echos to 192.168.1.1, timeout is 2 seconds:

!!!!!

Success rate is 100 percent (5/5), round-trip min/avg/max = 1/4/9 ms

right#

Совместную работу с протоколом Spanning Tree мы проверили, увеличив значение приоритета для граничных коммутаторов, оставив без изменений настройки DGS-3620-28TC. Увеличение приоритета коммутатора снижает его шансы стать корневым в дереве STP. Таким образом в качестве корневого коммутатора должен был быть выбран D-Link DGS-3620-28TC, в чём можно убедиться просмотреть состояние коммутаторов Catalyst для соответствующих виртуальных сетей.

left#sho spanning-tree vlan 2

MST0

Spanning tree enabled protocol mstp

Root ID Priority 32768

Address 84c9.b21f.be00

Cost 20000

Port 1 (GigabitEthernet1/0/1)

Hello Time 2 sec Max Age 20 sec Forward Delay 15 sec

Bridge ID Priority 61440 (priority 61440 sys-id-ext 0)

Address 04fe.7fc5.9780

Hello Time 2 sec Max Age 20 sec Forward Delay 15 sec

Interface Role Sts Cost Prio.Nbr Type

------------------- ---- --- --------- -------- --------------------------------

Gi1/0/1 Root FWD 20000 128.1 P2p Bound(RSTP)

right#sho spanning-tree vlan 3

MST0

Spanning tree enabled protocol mstp

Root ID Priority 32768

Address 84c9.b21f.be00

Cost 20000

Port 25 (GigabitEthernet0/1)

Hello Time 2 sec Max Age 20 sec Forward Delay 15 sec

Bridge ID Priority 61440 (priority 61440 sys-id-ext 0)

Address 88f0.77dc.1880

Hello Time 2 sec Max Age 20 sec Forward Delay 15 sec

Interface Role Sts Cost Prio.Nbr Type

------------------- ---- --- --------- -------- --------------------------------

Gi0/1 Root FWD 20000 128.25 P2p Bound(RSTP)

Так как настройка оборудования и проверка обсуждаемого функционала заняло у нас много времени, мы решили представить нашим читателям полные конфигурационные файлы для левого и правого коммутаторов, а также для D-Link DGS-3620-28TC.

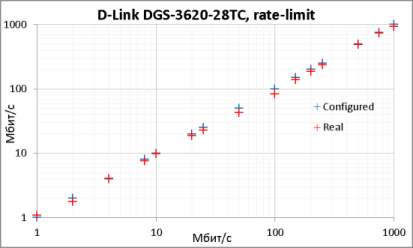

Коммутатор D-Link DGS-3620-28TC позволяет ограничить скорость пользовательского трафика, передаваемого через определённый порт (QoS-Bandwidth Control-Bandwidth Control Settings), мы решили проверить, насколько заданные значения скорости соответствуют реальным скоростям передачи пользовательских данных. На диаграмме ниже обе оси имеют логарифмический масштаб.

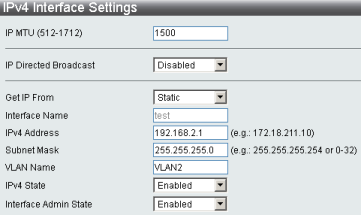

Также мы решили проверить работу функции агрегации физических каналов в логический. Для этого в качестве второго коммутатора мы использовали модель Cisco Catalyst 2960. Проверка производилась с использованием виртуальной сети 2, которая была создана на обоих коммутаторах. На коммутаторе DGS-3620-28TC мы создали интерфейс в VLAN2 с IP-адресом 192.168.2.1/24 (Management-IP Interface-Interface Settings), на Catalyst 2960 создали SVI-интерфейс также во второй виртуальной сети и назначили IP-адрес 192.168.2.2/24.

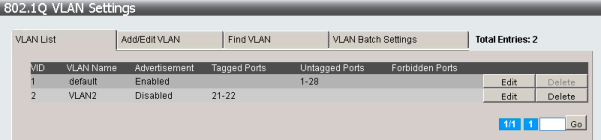

Порты 21 и 22 коммутатора DGS-3620-28TC были добавлены в транки с разрешённым VLAN2 (L2 Features-VLAN-802.1Q VLAN Settings). Аналогичные действия были проведены на коммутаторе Catalyst 2960 для портов Fa0/21 и Fa0/22.

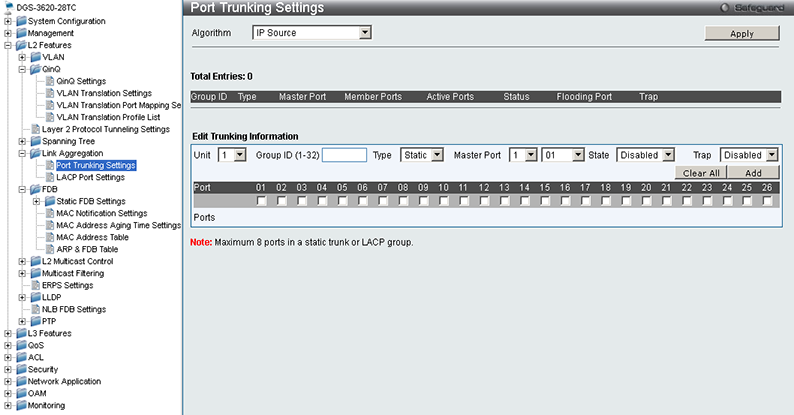

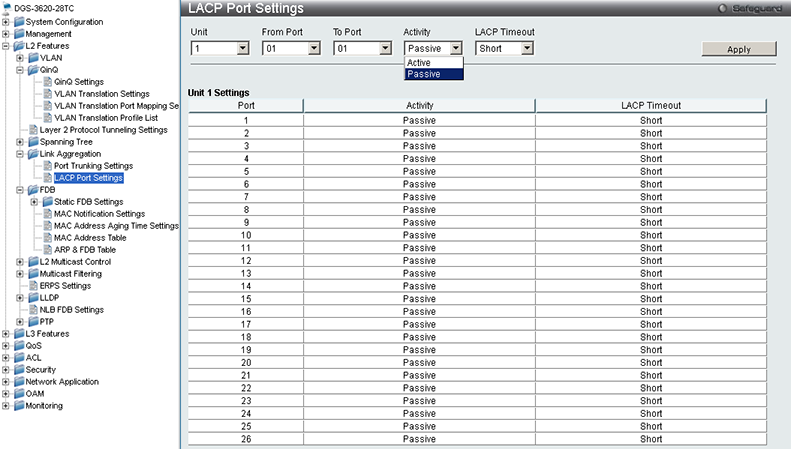

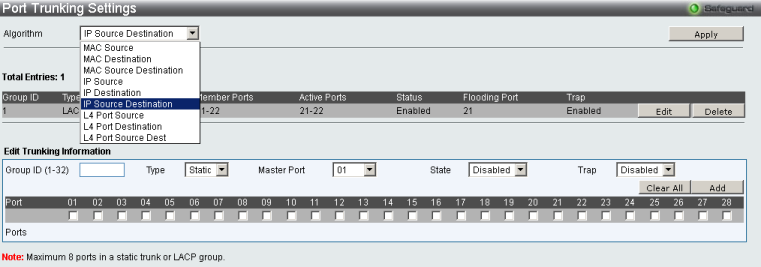

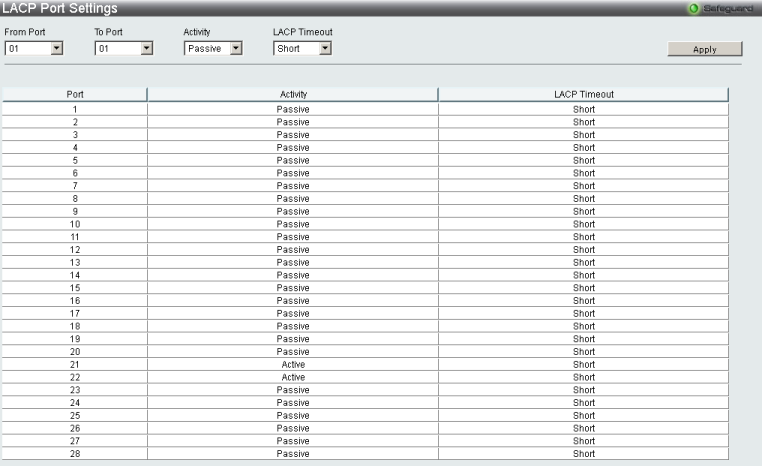

С помощью подпунктов Port Trunking Settings и LACP Port Settings группы L2 Features-Link Aggregation мы создали Port-Channel 1, в который входят порты 21 и 22. Балансировка осуществляется по IP-адресам отправителя и получателя.

На стороне Catalyst 2960 были выполнены аналогичные настройки. В представленном ниже листинге находятся только команды, непосредственно относящиеся к текущему тесту.

port-channel load-balance src-dst-ip

vlan 2

name up_vlan

interface Port-channel1

switchport trunk allowed vlan 2

switchport mode trunk

interface FastEthernet0/21

switchport trunk allowed vlan 2

switchport mode trunk

load-interval 30

channel-protocol lacp

channel-group 1 mode active

spanning-tree portfast trunk

interface FastEthernet0/22

switchport trunk allowed vlan 2

switchport mode trunk

load-interval 30

channel-protocol lacp

channel-group 1 mode active

spanning-tree portfast trunk

interface Vlan2

ip address 192.168.2.2 255.255.255.0

load-interval 30

Успешное создание логического канала отображается в выводе команды show etherchannel summary, введённой на коммутаторе Cisco Catalyst 2960.

2960#sho etherchannel summary

Flags: D - down P - bundled in port-channel

I - stand-alone s - suspended

H - Hot-standby (LACP only)

R - Layer3 S - Layer2

U - in use f - failed to allocate aggregator

M - not in use, minimum links not met

u - unsuitable for bundling

w - waiting to be aggregated

d - default port

Number of channel-groups in use: 1

Number of aggregators: 1

Group Port-channel Protocol Ports

------+-------------+-----------+-----------------------------------------------

1 Po1(SU) LACP Fa0/21(P) Fa0/22(P)

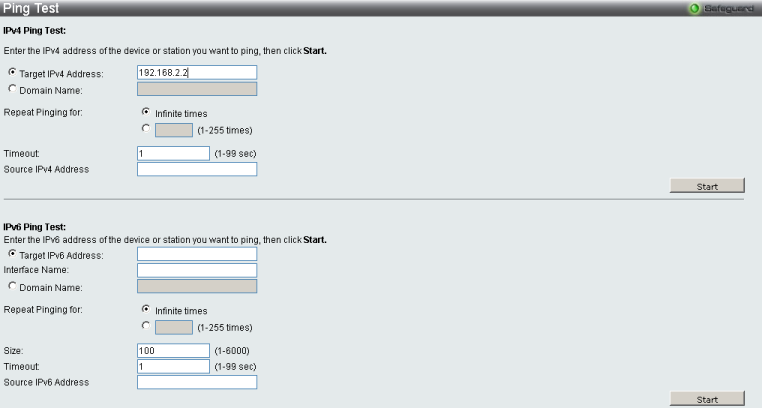

Также убедиться в работоспособности построенного канала можно с помощью ICMP эхо-запросов, отправляемых с любого из коммутаторов. Пример такой отправки с коммутатора DGS-3620-28TC представлен ниже (Monitoring-Ping-Ping Test).

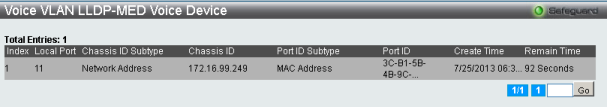

В качестве финального теста для коммутатора D-Link DGS-3620-28TC мы выбрали проверку работоспособности функционала LLDP MED, позволяющего подключать к порту коммутатора IP-телефон так, чтобы сам телефон был в одной виртуальной сети, а ПК, подключенный через телефон, - в другой. В этом случае IP-телефон выполняет функции моста. Для проверки мы использовали телефоны Avaya one-X Deskphone 9620L и 9650. Порт коммутатора, к которому подключается телефон, настраивается в качестве обычного порта доступа виртуальной сети для ПК. Дополнительно к этому должны быть введены следующие команды.

enable lldp

config lldp_med ports 11 med_transmit_capabilities all state enable

enable voice_vlan vlanid 3

config voice_vlan ports 11 state enable

Хотелось бы обратить внимание читателей на то, что мы подключали телефон к порту №11, а VLAN 3 использовался в качестве голосовой виртуальной сети, то есть при повторении указанных команд потребуется заменить номер порта и виртуальной сети на те, что используются в реальной сети.

Проверить успешность подключения телефона можно с помощью команды show voice_vlan lldp_med voice_device, вывод которой представлен ниже.

DGS-3620-28TC:admin#show voice_vlan lldp_med voice_device

Command: show voice_vlan lldp_med voice_device

Index : 1

Local Port : 11

Chassis ID : 172.16.99.249

Port ID Subtype : MAC Address

Port ID : 3C-B1-5B-4B-9C-C7

Create Time : 7/25/2013 06:38:37

Remain Time : 98 Seconds

Total Entries : 1

Аналогичные сведения можно получить и с помощью пункта L2 Features-VLAN-Voice VLAN-Voice VLAN LLDP-MED Voice Device веб-интерфейса.

Полностью убедиться в правильной настройке оборудования можно совершив тестовый звонок с телефона и установив наличие доступа к остальной части сети у ПК, подключенного к телефону.

На этом мы завершаем тестирование коммутатора D-Link DGS-3620-28TC и переходим к подведению итогов.

Заключение

В целом мы остались довольны протестированным гигабитным L3 коммутатором D-Link DGS-3620-28TC, возможностей которого вполне хватит для успешной работы на уровнях доступа и агрегации крупных сетей, а также и в ядрах сетей небольших и средних компаний. Более богатыми возможностями, по сравнению с веб-интерфейсом, обладает интерфейс командной строки, не являющийся cisco-like, что поначалу у нас вызывало незначительные затруднения, однако в процессе работы мы смогли легко адаптироваться к представленному синтаксису.

Сильные стороны DGS-3620-28TC перечислены ниже.

- Богатый функционал.

- Поддержка IPv6.

- Возможность выполнения функций DHCP-сервера с поддержкой нескольких дополнительных опций.

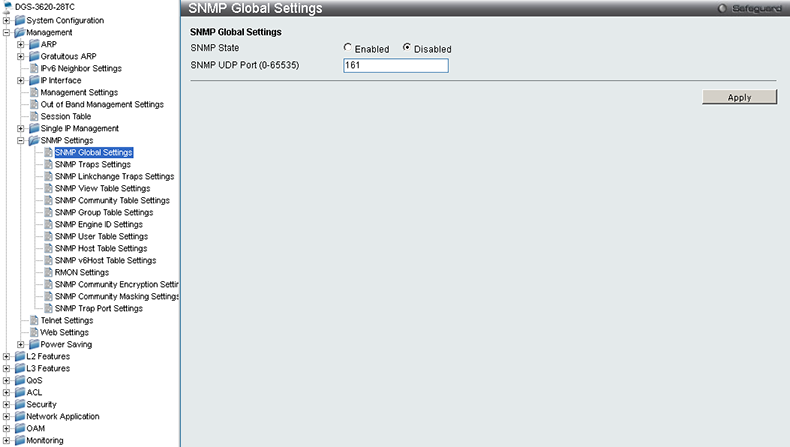

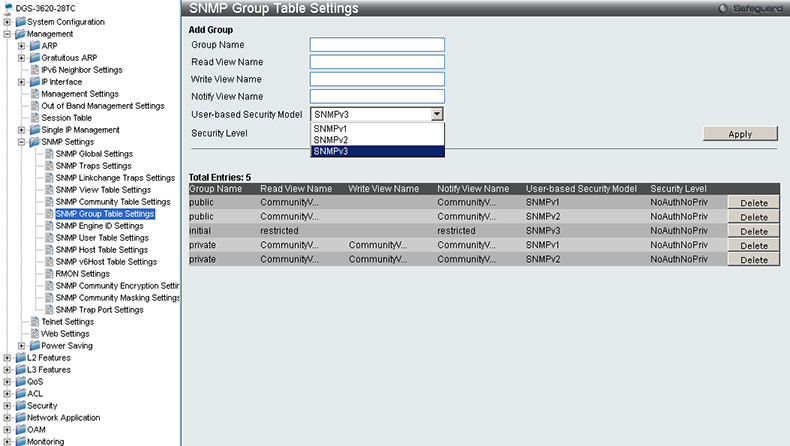

- Поддержка SNMPv3.

- Возможность как внутриполосного, так и внеполосного управления.

- Поддержка функции VLAN translation.

- Наличие LLDP MED.

- Возможность виртуального стекирования.

К сожалению, мы не можем не указать и на обнаруженные недостатки.

- Немного заторможенный веб-интерфейс.

- Не самый простой интерфейс командной строки.

На момент написания статьи средняя цена на коммутатор D-Link DGS-3620-28TC в интернет-магазинах Москвы составляла 75000 рублей.

Автор и редакция благодарят проект Anticisco за помощь в проведении тестирования.

NComputing N400 – тонкий клиент для Citrix

Введение

На наших страницах однажды уже появлялся обзор тонкого клиента NComputing L300, обеспечивающего подключения к серверу со специализированным программным обеспечением vSpace. Сегодня к нам в редакцию попала другая модель от того же производителя – N400, позволяющая производить подключения к существующим корпоративным серверам Citrix и не требующая установки никакого дополнительного программного обеспечения на них. Сегодня мы попытаемся разобраться со всеми возможностями устройства и предоставить нашим читателям подробный обзор терминального клиента NComputing N400.

Внешний вид и аппаратная платформа

Терминальный клиент NComputing N400 поставляется в чёрном пластиковом корпусе, габариты которого составляют 181х115х31 мм. Для своей работы устройство требует наличие внешнего источника постоянного напряжения со следующими характеристиками: 12В и 1.5А.

На передней панели клиента расположена кнопка включения/выключения устройства, два порта USB 2.0, аудио вход и выход, а также название компании-производителя.

Боковые поверхности несут на себе вентиляционную решётку.

Верхняя панель зеркальная и ничем особенным не примечательна кроме объёмного логотипа производителя и световых индикаторов работы устройства и подключения к локальной сети.

На задней панели расположены два порта USB 2.0 для подключения мышки и клавиатуры, порт Ethernet, DVI-разъём для подключения монитора, гнездо для подключения питания, а также Кенсингтонский замок. Стоит отметить, что здесь предусмотрено место для подключения внешней антенны, однако беспроводного модуля в модели N400 нет, подключение к беспроводным сетям можно осуществить только с моделью N500w.

На днище находятся четыре резиновых ножки для размещения N400 на столе, а также Г-образные технологические отверстия для крепления устройства к стене или монитору, а также наклейка с краткой информацией о клиенте.

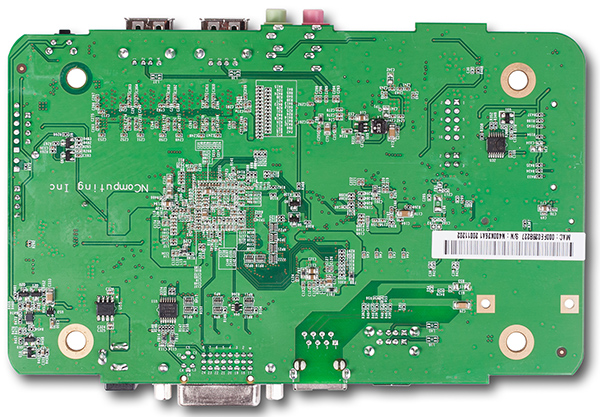

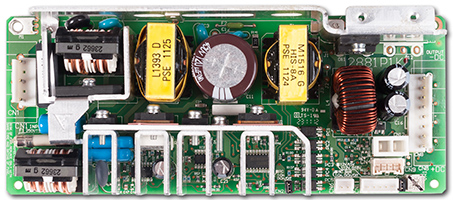

Аппаратная платформа N400 представлена единственной зелёной текстолитовой платой, основные элементы на которой расположены с одной стороны.

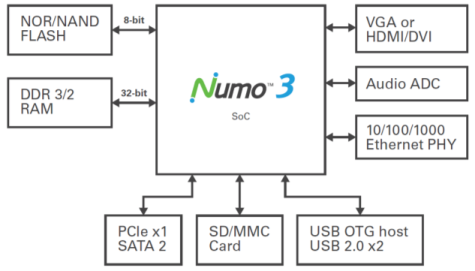

Терминальный клиент N400 построен на базе SoC-чипа NComputing NUMO3, блок-схема использования которого представлена ниже. Основу NUMO3 составляет двухядерный ARM-процессор Cortex A9, работающий на частоте 2 ГГц.

Флеш-память имеет объём 512 Мбайт и представлена чипом Samsung K9F4G08U0D. Для оперативной памяти использовано четыре DDR3-чипа K4B2G08460 по 256 Мбайт каждый, таким образом суммарный объём оперативной памяти составляет 1 Гбайт. Поддержку сети обеспечивает модуль Realtek RTL8211DG. Silicon Image SIL164CTG64 предназначен для работу с графическими данными.

Перейдём теперь к программной составляющей устройства.

Обновление прошивки и vSpace Management Center

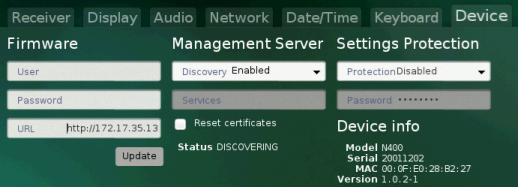

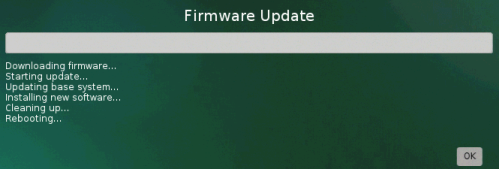

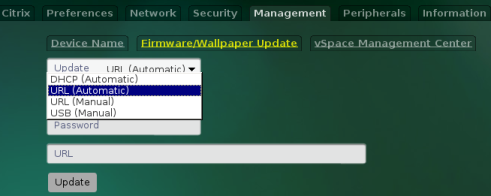

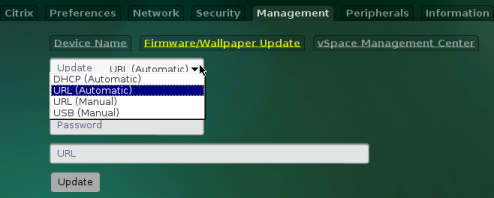

Обновление прошивки производится с помощью пункта Device меню графического интерфейса устройства. Здесь необходимо указать ссылку на файл, содержащий новую прошивку, а также при необходимости задать имя и пароль доступа к этому сервису. Стоит отметить, что в новых прошивках внешний вид и количество вкладок изменились, поэтому для смены версии микропрограммного обеспечения в последних прошивках необходимо использовать пункт General или же подпункт Firmware/Wallpaper Update вкладки Management.

Микропрограммное обеспечение начиная с версии 1.4.1.1 можно обновлять не только с удалённых серверов по сети, но также и с локальных носителей, подключённых к USB-портам тонкого клиента.

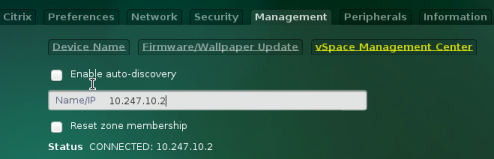

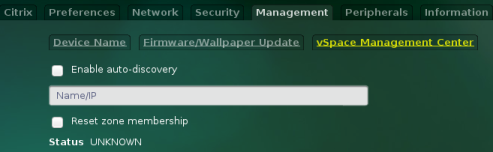

Кроме описанных выше способов обновления прошивки существует ещё один – с помощью утилиты vSpace Management Center, предназначенной для централизованного управления несколькими тонкими клиентами. Для того чтобы привязать конкретное устройству к vSpace Management Center, необходимо обратиться к одноимённому подпункту вкладки Management, где указать имя или IP-адрес сервера, на котором установлено соответствующее программное обеспечение.

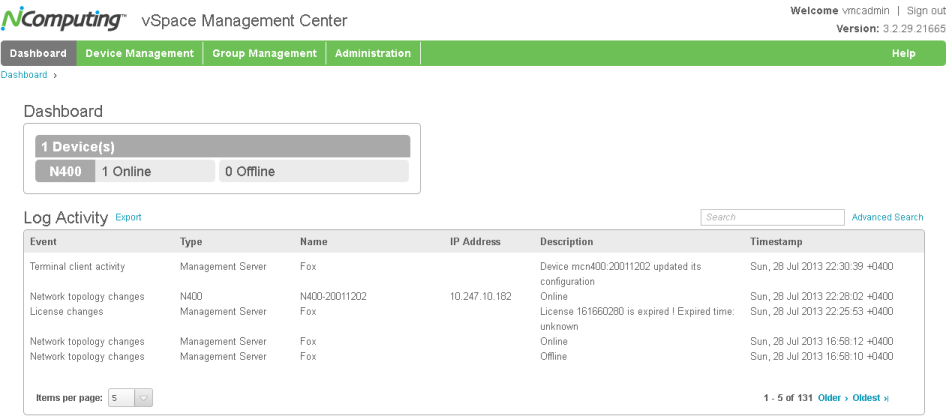

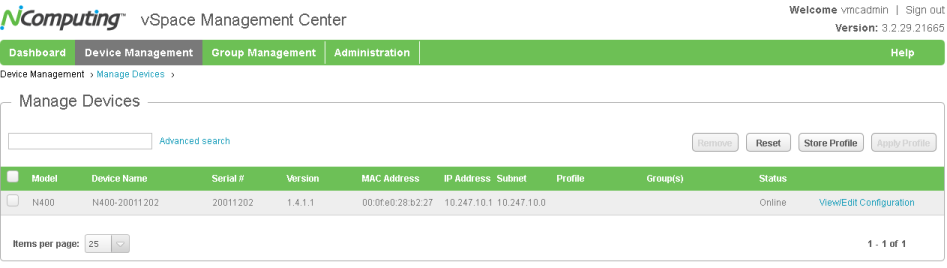

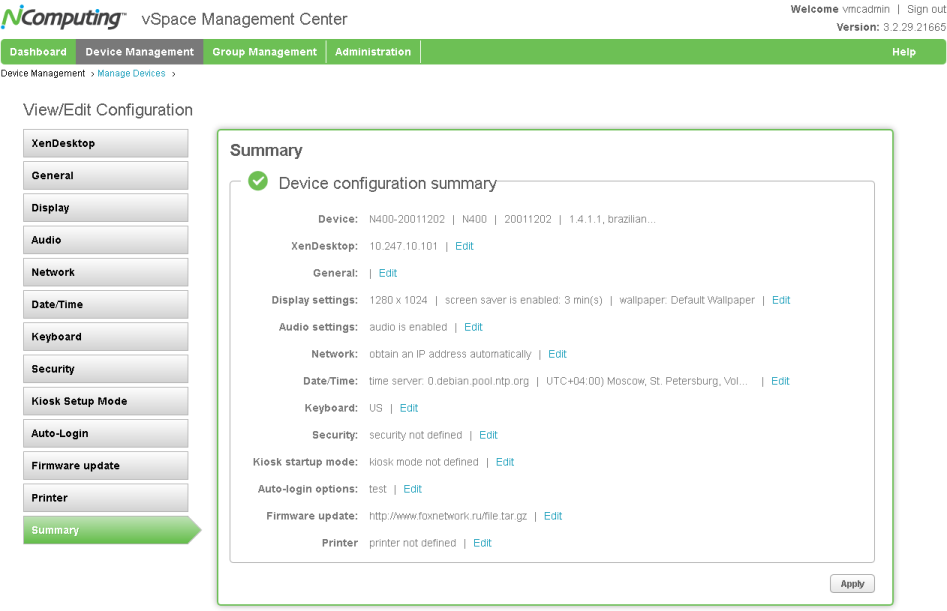

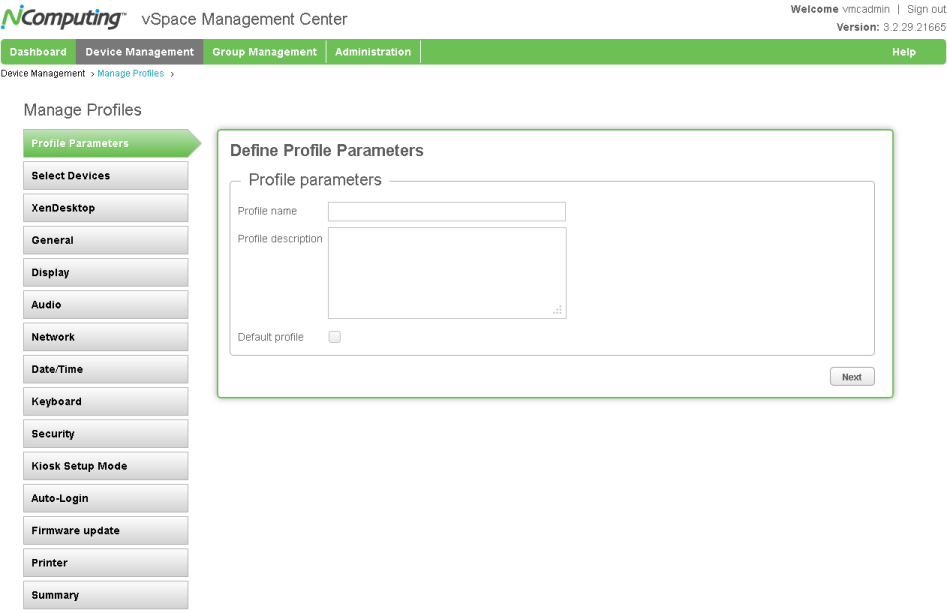

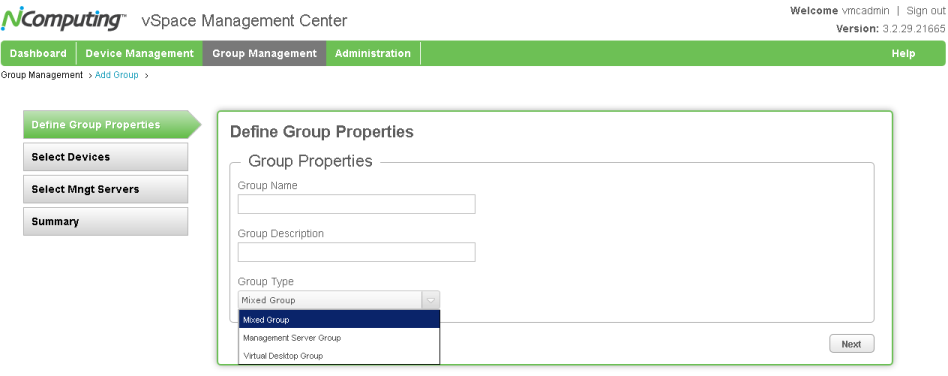

Доступ к обсуждаемому программному обеспечению производится с помощью любого современного браузера. С помощью vSpace Management Center администратор может контролировать количество тонких клиентов в сети, изменять их конфигурацию и настраивать профили, создавать группы устройств и управлять ими, а также централизованно выполнять любые другие процедуры по конфигурированию тонких клиентов.

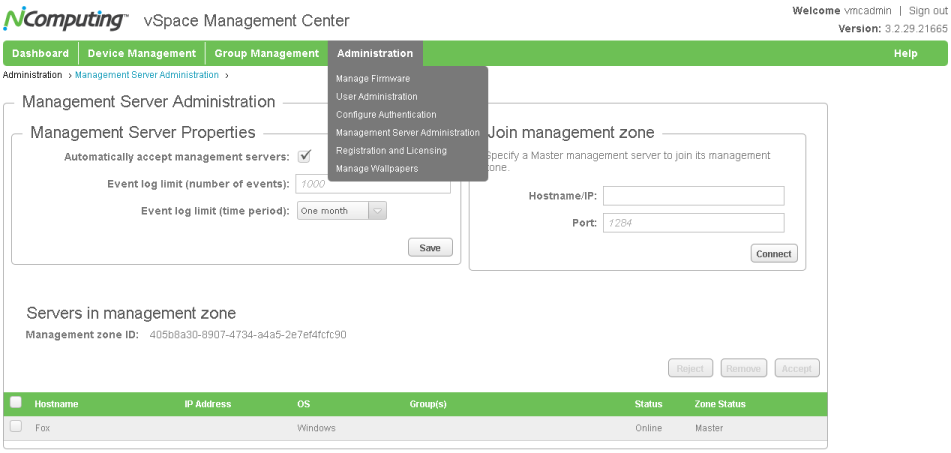

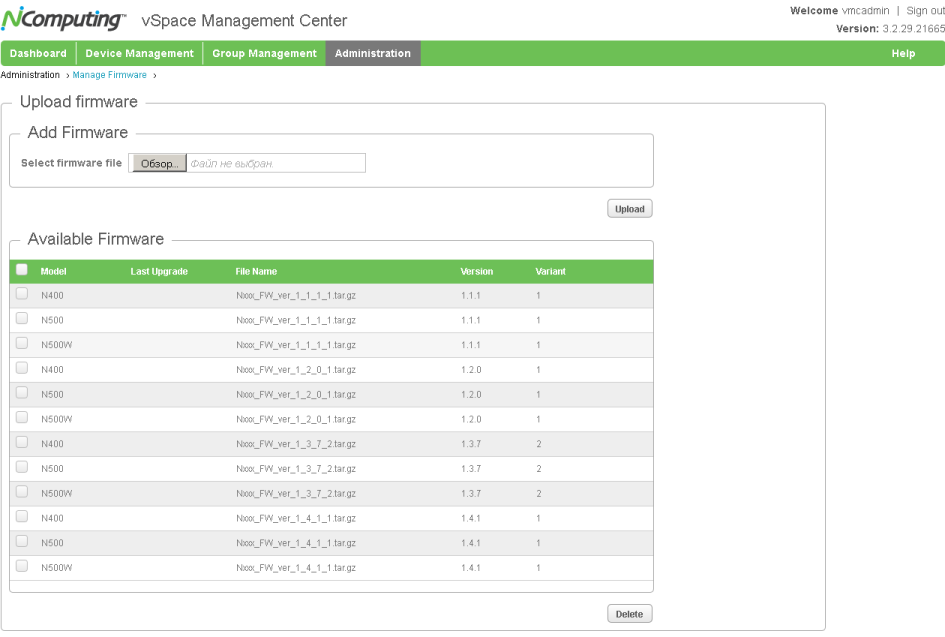

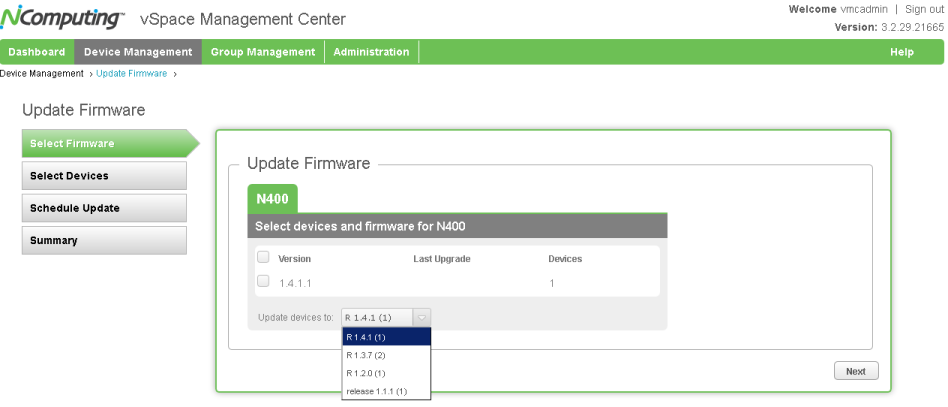

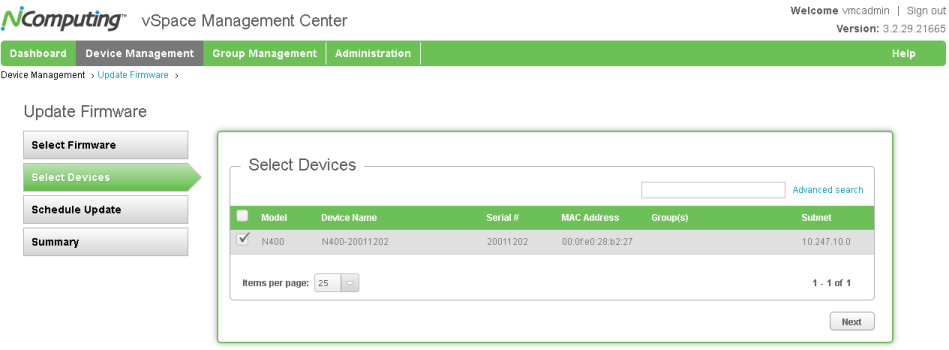

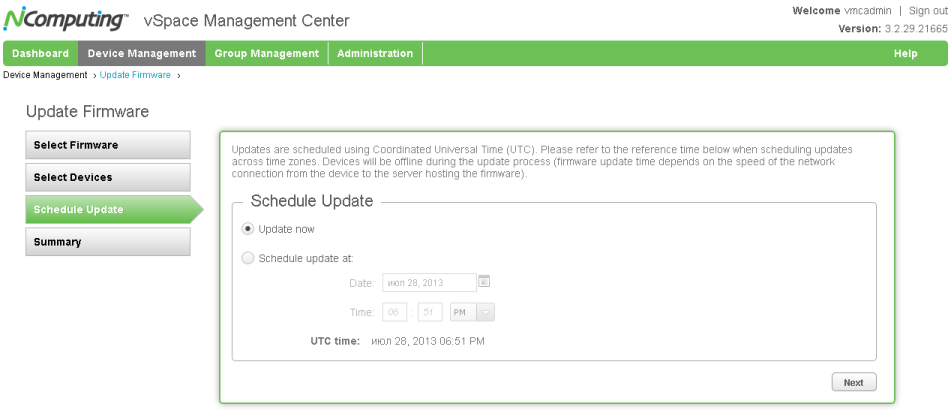

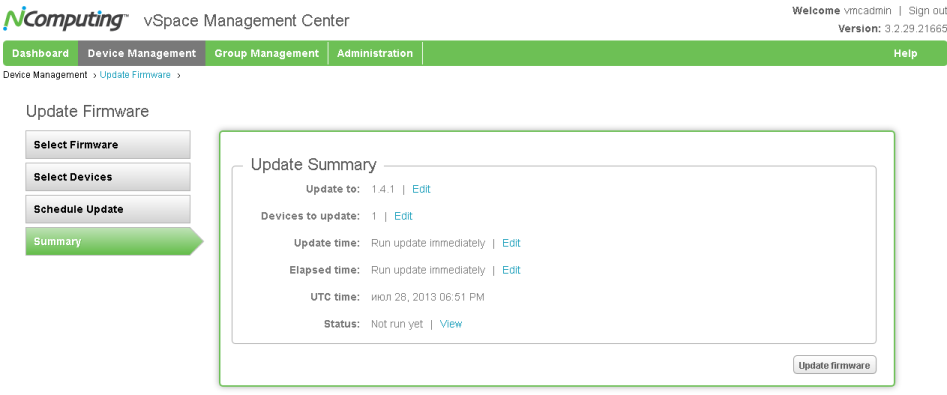

Для замены прошивки с помощью vSpace Management Center нужно сначала обратиться к пункту Manage Firmware меню Administration, с помощью которого производится загрузка файлов с прошивками в систему, после чего с помощью пункта Update Firmware меню Device Management выбрать прошивку и устройство, а также запланировать процедуру обновления.

Перейдём теперь к рассмотрению возможностей графического пользовательского интерфейса.

Обзор интерфейса

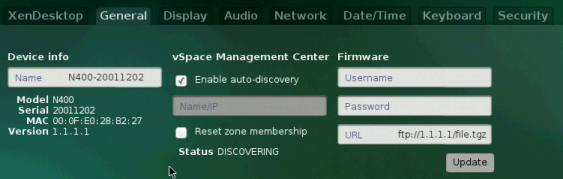

После подключения монитора, клавиатуры и мыши пользователь попадает в графический интерфейс тонкого клиента N400, внешний вид которого сильно зависит от версии микропрограммного обеспечения, установленного в устройстве.

На домашнем экране графического интерфейса пользователь может указать логин, пароль и имя домена, которые необходимо указать при подключении к Citrix-серверу. Нажатие на кнопку с изображением шестерёнки предоставляет возможность изменять настройки N400, тогда как круглая кнопка с изображением месяца и звёздочек активирует ждущий режим.

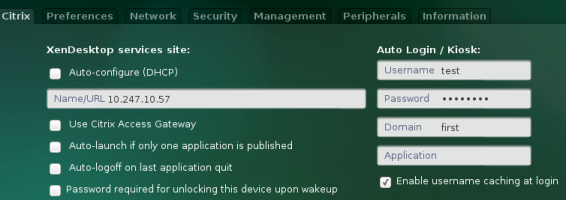

Для настройки тонкого клиента администратору доступны семь вкладок: Citrix, Preferences, Network, Security, Management, Peripherals и Information. Вкладка Citrix позволяет изменить параметры доступа к Citrix-инфраструктуре.

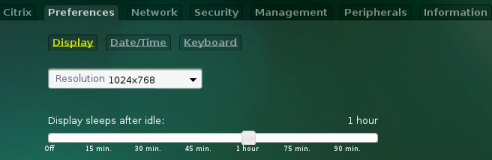

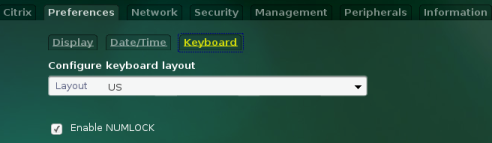

Изменить разрешение экрана и задержку его перевода в спящий режим, а также выбрать раскладку клавиатуры и задать параметры синхронизации времени можно с помощью подпунктов вкладки Preferences.

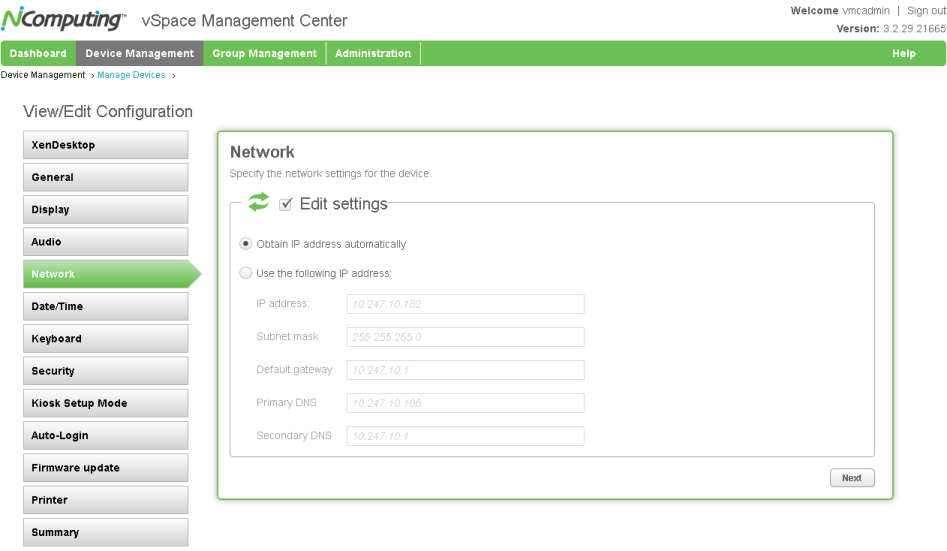

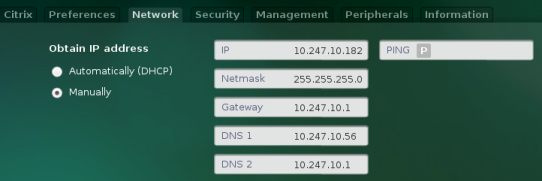

Вкладка Network управляет сетевыми параметрами тонкого клиента NComputing N400.

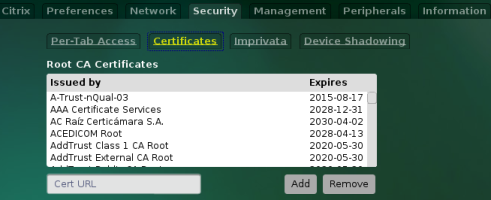

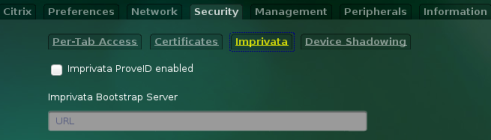

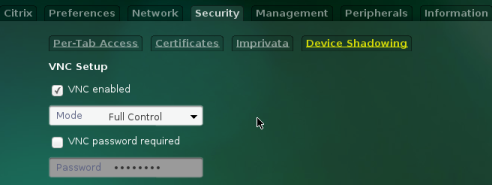

Изменять параметры доступа к различным вкладкам, управлять установленными сертификатами, разрешать или запрещать управление тонким клиентом с помощью VNC можно с использованием подпунктов вкладки Security. Также здесь пользователю доступны параметры настройки сквозной аутентификации с помощью Imprivata.

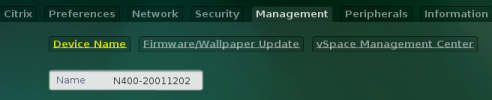

Изменить имя устройство, обновить прошивку, либо обеспечить подключение к центру управления vSpace можно во вкладке Management.

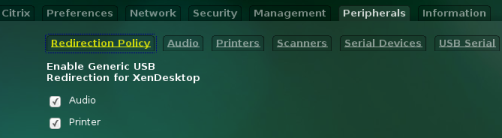

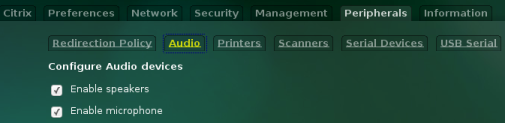

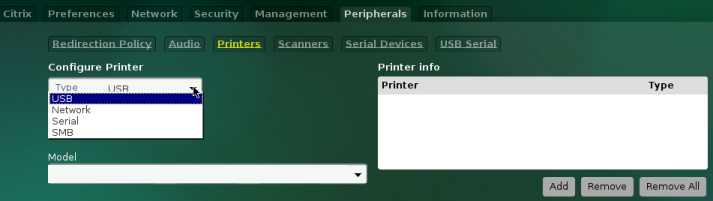

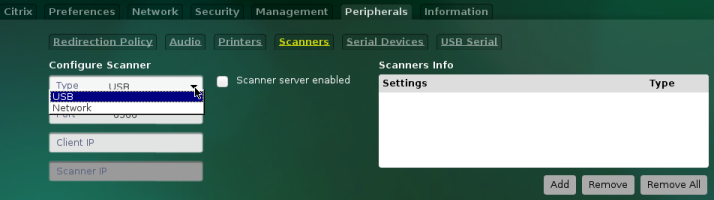

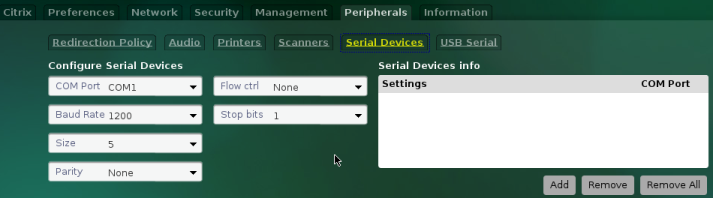

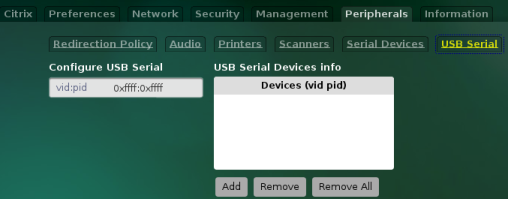

Параметры подключения периферийных устройств собраны в подпунктах вкладки Peripherals. Здесь пользователь может управлять подключением наушников и микрофона, принтера и сканера, а также другими COM и USB устройствами.

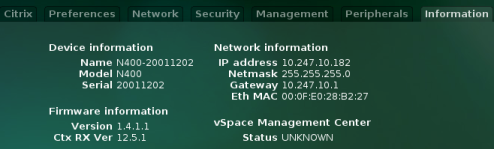

Краткая информация об устройстве представлена во вкладке Information.

На этом мы завершаем беглое рассмотрение возможностей графического интерфейса и переходим к тестированию тонкого клиента NComputing N400.

Тестирование

Первым тестом, с которого мы традиционно начинаем данный раздел, является установление времени загрузки устройства, под которым мы понимаем интервал времени, прошедший с момента подачи питания до получения первого эхо-ответа по протоколу ICMP. NComputing N400 загружается за 44 секунды. Мы считаем это приемлемым результатом.

Вторым тестом стала проверка защищённости тонкого клиента с помощью утилиты Positive Technologies XSpider 7.7 (Demo build 3100). Всего было обнаружено три открытых порта: TCP-22 (SSH), UDP-123 (NTP) и TCP-5900 (VNC remote desktop). Интересные обнаруженные сведения представлены ниже.

Нельзя не упомянуть об основных параметрах нашего тестового стенда.

| Компонент | ПК | Ноутбук |

| Материнская плата | ASUS Maximus V Extreme | ASUS M60J |

| Процессор | Intel Core i7 3770K 3.5 ГГц | Intel Core i7 720QM 1.6 ГГц |

| Оперативная память | DDR3 PC3-10700 SEC 32 Гбайта | DDR3 PC3-10700 SEC 16 Гбайт |

| Сетевая карта | Intel Gigabit CT Desktop Adapter | Atheros AR8131 |

| Операционная система | Windows 2008 R2 x64 Rus | Windows 7 x64 SP1 Rus |

На тестовом ПК нами была развёрнута Citrix инфраструктура. Для виртуализации использовалась технология Microsoft Hyper-V. В виртуальной инфраструктуре мы пробовали работать с различными офисными приложениями, общаться в Skype, а также смотреть фильмы в HD-качестве. Ни в одном из сценариев использования N400 мы не испытывали проблем, кроме разве что просмотра высококачественных фильмов, где наблюдались редкие кратковременные замирания звуковой дорожки.

Тонкий клиент NComputing N400 позволяет подключать к себе не только наушники и микрофон, но также и разнообразные USB-устройства: принтеры, сканеры, флеш-карты. Мы решили подключить наш внешний жёсткий диск Transcend StoreJet 25M3 объёмом 750 Гбайт с разделом, отформатированным в файловую систему NTFS, и проверить скорости доступа к нему с гостевой операционной системы, для чего использовали утилиту Intel NASPT версии 1.7.1. К сожалению, тесты Office Productivity и Photo Album завершались ошибкой (на диаграмме для этих тестов стоит значение 0), однако мы не склонны считать это серьёзной проблемой. Так как полученные скорости нельзя назвать высокими, мы решили заменить N400 на тестовый ноутбук с установленным на нём приложением Citrix Receiver. Результаты этих измерений также представлены на диаграмме.

На этом мы завершаем раздел тестирования и переходим к подведению итогов.

Заключение

После тестирования тонкий клиент NComputing N400 оставил у нас смешанные чувства: с одной стороны, это небольшое элегантное устройство с лёгкой настройкой, с другой же стороны, настройка самой Citrix-инфраструктуры к числу лёгких не относится совершенно. Использовать Citrix-модели тонких клиентов мы бы могли рекомендовать тем организациям, в штате которых имеется высококлассный специалист по Citrix системам, либо уже развёрнута и успешно эксплуатируется соответствующая инфраструктура, потому что начальная подготовка среды для подключения N400 может оказаться весьма трудоёмким занятием. Пример подготовки соответствующих сервисов описан в инструкции, размещённой на сайте производителя.

К сильным сторонам тонкого клиента NComputing N400 можно отнести следующие.

- Низкая стоимость владения.

- Поддержка мультимедийных приложений.

- Элегантный дизайн и небольшие размеры.

- Поддержка высоких разрешений экрана (до 1920х1080).

- Возможность централизованного управления.

- Опция дистанционного обновления прошивки.

- Низкое энергопотребление.

- Возможность подключения периферийных устройств.

К сожалению, мы не можем не указать на недостатки устройства.

- Сложность организации Citrix-инфраструктуры.

- Не высокие скорости доступа к USB-устройствам.

- Интерфейс устройства доступен только на английском языке.

На момент написания средняя цена тонкого клиента NComputing N400 в интернет магазинах Москвы составляла 5200 рублей.

Автор и редакция благодарят компанию Тайле и её технических специалистов за предоставленное оборудование и неоценимую помощь в процессе подготовки обзора.

Buffalo TeraStation 5600

Введение

По мере развития нашей тестовой лаборатории мы начинаем сотрудничество со всё большим количеством производителей сетевого оборудования. Совсем недавно к нам обратились представители японской компании Buffalo с предложением провести тестирование их продукции. По нашему мнению, компания Buffalo пока не очень известна российскому потребителю, поэтому мы решили восполнить этот пробел и представить нашим читателям обзор сетевого хранилища с шестью дисками Buffalo TeraStation 5600. Мы надеемся, что это не последнее тестирование оборудования данного производителя в нашей сетевой лаборатории, но пока мы приступаем к детальному рассмотрению модели TeraStation 5600.

Внешний вид

Сетевое хранилище Buffalo TeraStation 5600 выполнено в традиционном для подобных устройств чёрном металлическом корпусе, предназначенном для размещения на столе.

Большую часть лицевой стороны занимает пластиковая дверца с воздушным фильтром, за которой скрываются шесть корзин с дисками. Сама дверца может быть закрыта на ключ, для чего в неё вмонтирован замок. Кроме дисковых корзин за дверцей скрывается некий порт для инженеров производителя, он не предназначен для подключения пользовательских устройств.

Пожалуй, стоит подробнее остановиться на самих дисках. Производитель запрещает менять диски местами в хранилище, а также заменять их на произвольные накопители. Замена диска производится только в случае выхода его из строя, о чём свидетельствует красный световой индикатор справа от дисковой корзины, причём диски для замены должны быть приобретены непосредственно у компании Buffalo. Замена диска на произвольный накопитель является не гарантийным случаем и может приводить к тому, что хранилище попросту не загрузится. Однако даже в этом случае техническая поддержка производителя бесплатно произведёт все необходимые восстановительные работы.

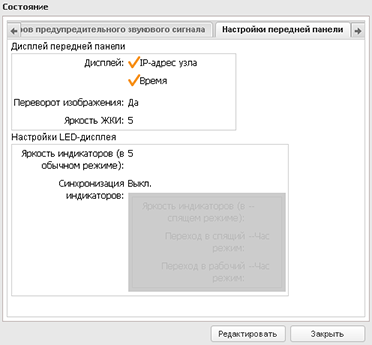

Над дверцей на лицевой панели расположена панель управления, на которой присутствует ЖК-дисплей с клавишей переключения отображаемой информацией, кнопка включения/выключения устройства, световые индикаторы сетевых портов и состояния хранилища, порт USB 3.0. Также здесь расположена кнопка FUNCTION, используемая для копирования данных, отключения USB-накопителей, пересоздания RAID-массивов и настройки отказоустойчивости.

Верхняя и боковые поверхности хранилища ничем особенным не примечательны. Здесь лишь расположены небольшие вентиляционные отверстия.

На днище TeraStation 5600 размещены четыре круглые резиновые ножки для настольного размещения аппарата.

На задней стороне хранилища расположены два вентилятора диаметров 92 мм. Кроме них здесь присутствует разъём для подключения питания и наклейки с краткой информацией об устройстве. Также на задней стороне корпуса размещён переключатель для выбора загрузочного устройства, два интерфейса GigabitEthernet, два порта USB 3.0 и два порта USB 2.0.

Заглянем теперь внутрь Buffalo TeraStation 5600.

Аппаратная платформа

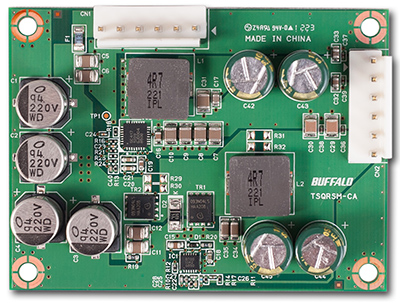

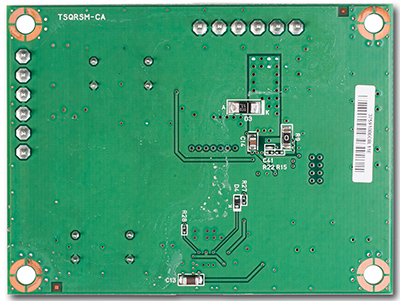

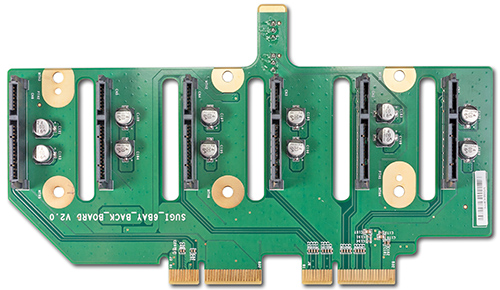

Электронная начинка сетевого хранилища Buffalo TeraStation 5600 состоит из пяти плат: одной материнской, одной платы блока питания и трёх плат, выполняющих вспомогательные функции. К таким функциям можно отнести вывод информации на ЖК дисплей на передней панели устройства, либо обеспечение подключения жёстких дисков к материнской плате.

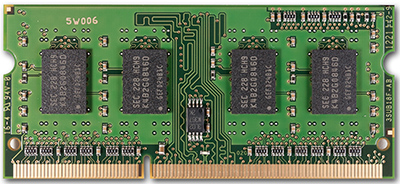

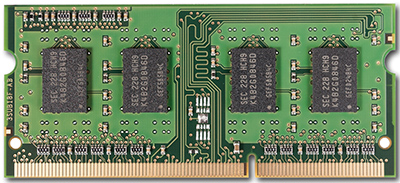

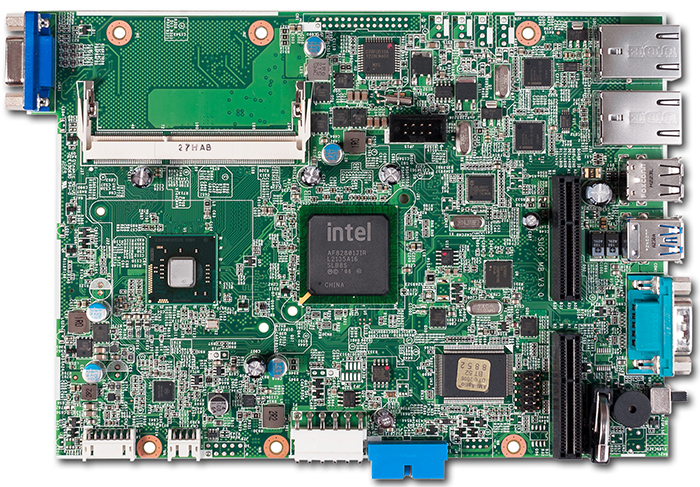

На материнской плате расположен слот с установленной планкой оперативной памяти. Сама оперативная память построена на восьми чипах Samsung K4b2G0846D с объёмом 256 Мбайт, таким образом, вся планка обеспечивает TeraStation 5600 оперативной памятью объёмом 2 Гбайта.

Основные элементы расположены на материнской плате с одной стороны. Исключение, разве что, составляет контроллер RS-232 Texas Instruments MB3243I.

Значительная часть лицевой стороны материнской платы скрыта под большим чёрным радиатором, обеспечивающим охлаждение для процессора Intel Atom D2700 и южного моста Intel AF82801JIR. Функции более медленного ввода/вывода возложены на микросхему iTE IT8721F.

Поддержка портов USB 3.0 обеспечивается чипом Renesas D720201. Два контроллера Intel WG82574L отвечают за работу двух сетевых интерфейсов Gigabit Ethernet. Мы не обнаружили на плате специализированного RAID-контроллера, что означает, что все функции по поддержке массивов ложатся на южный мост.

На этом мы завершаем изучение аппаратной части сетевого хранилища Buffalo TeraStation 5600 и переходим к рассмотрению его программных возможностей.

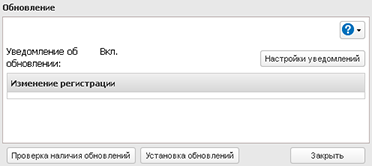

Обновление прошивки и утилиты

Смену версий микропрограммного обеспечения можно провести с помощью веб-интерфейса (Управление-Обновление) или специализированного программного обеспечения. Для обновления через веб-интерфейс необходимо наличие у хранилища доступа к глобальной сети.

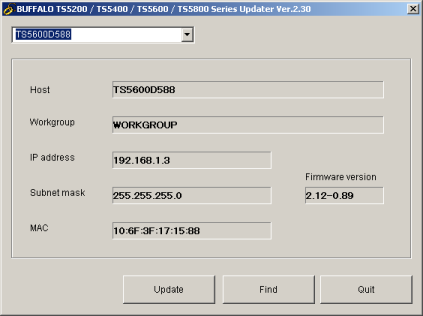

В случае использования утилиты TSUpdater пользователю необходимо подключиться в тот же L2-сегмент сети, где находится хранилище, выполнить поиск устройств со старой версией прошивки и приступить непосредственно к обновлению. Весь процесс смены версии микропрограммного обеспечения полностью автоматизирован и не требует от пользователя специальной квалификации.

Весь процесс обновления занимает приблизительно 17 минут, в течение которых устройство недоступно пользователям.

При выполнении перезагрузки TeraStation 5600 без созданного RAID-массива, устройство переходит в EM Mode, восстановление из которого может быть произведено с помощью утилиты TSUpdater.

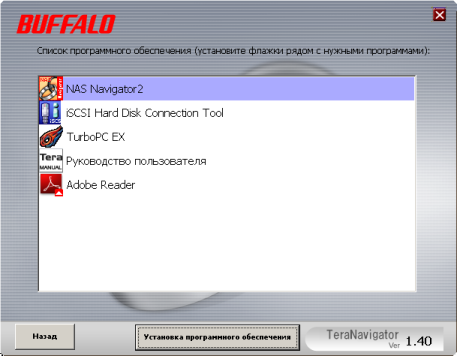

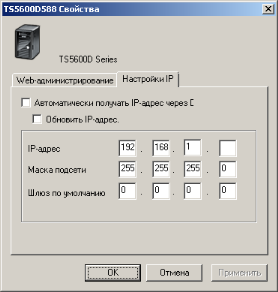

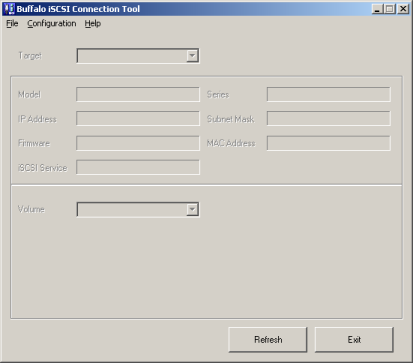

Кроме утилиты TSUpdater в состав набора утилит входят следующие программы: NAS Navigator 2 (для обнаружения сетевых хранилищ TeraStation в локальной сети и изменения их сетевых настроек), iSCSI Hard Disk Connection Tool (для подключения удалённого iSCSI-ресурса) и TurboPC EX (для увеличения скорости доступа к данным, размещённым на хранилище).

Перейдём теперь к рассмотрению возможностей веб-интерфейса сетевого хранилища Buffalo TeraStation 5600.

Обзор веб-интерфейса

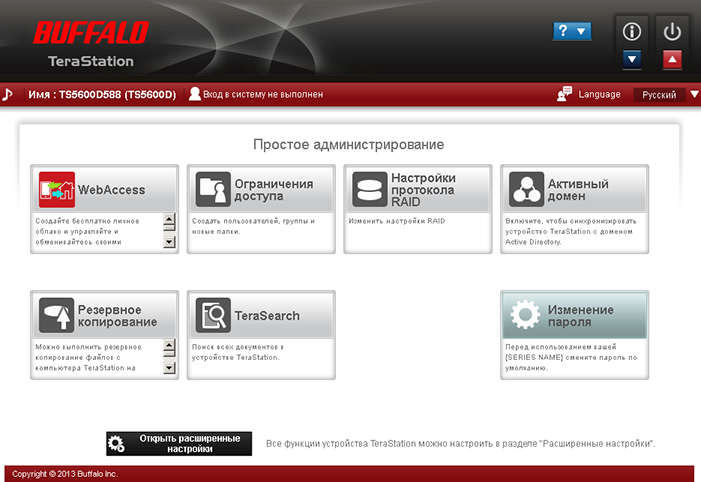

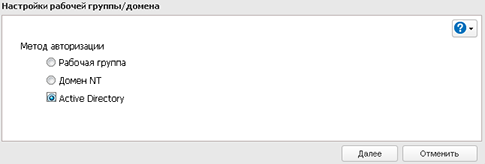

Для доступа к веб-интерфейсу устройства можно использовать любой современный браузер. При входе требуется ввести логин и пароль. Управление хранилищем с помощью веб-интерфейса может производиться в простом и расширенном режимах. Для доступа к режиму простого администрирования необходимо во всплывающем окне для ввода пароля нажать кнопку «Простое админис». Здесь пользователь может управлять личными облаками, задавать права доступа к ресурсам, изменять параметры работы RAID-массива, осуществлять подключение к Active Directory, выполнять резервное копирование, выполнять поиск документов на хранилище, а также изменять пароль администратора.

Стоит отметить, что веб-интерфейс доступен пользователям на семнадцати языках.

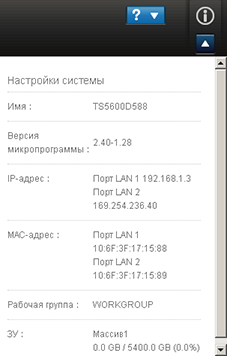

Из любого режима администрирования пользователь может посмотреть справку и краткую информацию о хранилище, а также выключить его или перезагрузить.

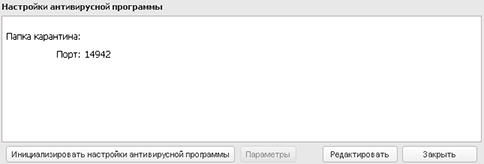

В режиме расширенного администрирования пользователь попадает в меню «Совместный доступ к файлу», где можно управлять папками, пользователями и их группами, а также файловыми протоколами доступа к данным, хранящимся на устройстве. Приятной функцией явилась возможность антивирусного сканирования пользовательских данных.

Стоит отметить, что TeraStation 5600 запрашивает подтверждение на выполнение практически любого действия, связанного с изменением настроек.

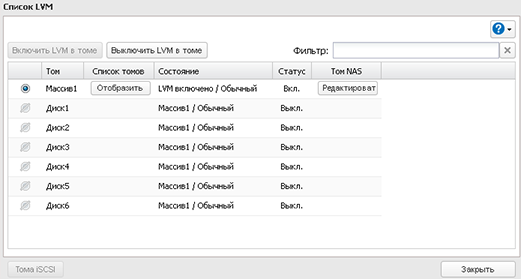

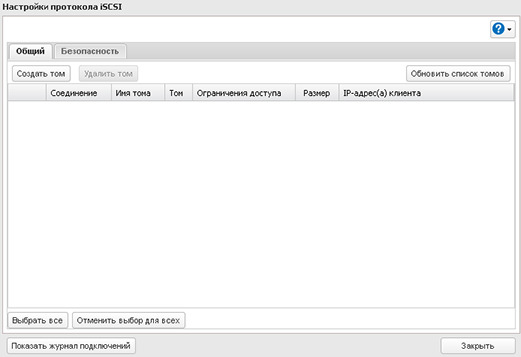

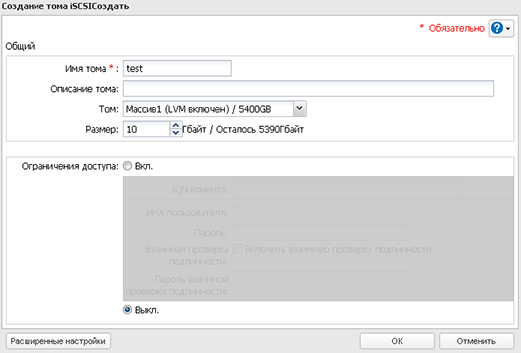

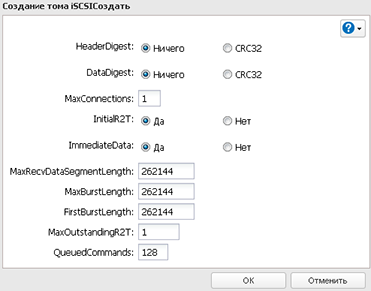

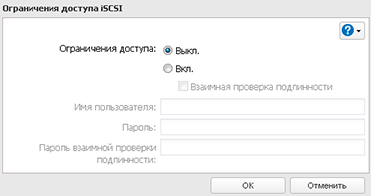

Меню «Диски» предоставляет администратору возможность проверки и форматирования отдельных дисков или дискового массива, создания RAID-массива. Здесь же представлены настройки доступа к хранилищу по протоколу iSCSI.

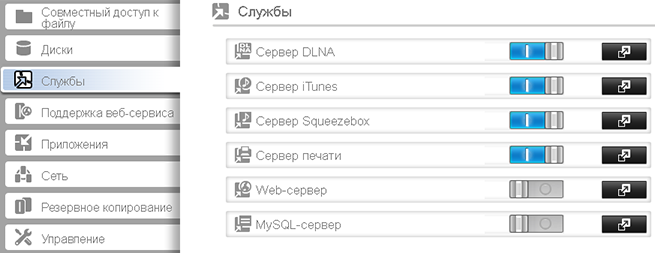

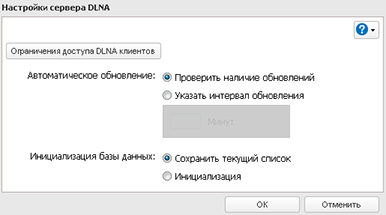

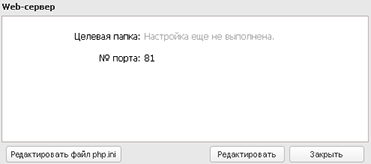

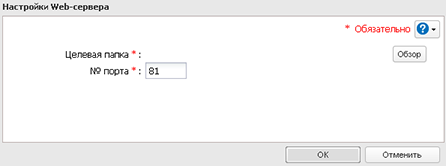

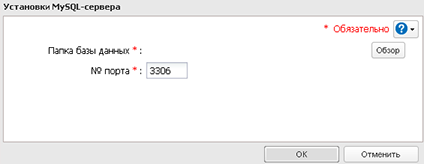

Включение, отключение и настройка вспомогательных служб доступа к данным производится с помощью меню «Службы». К числу таких служб относятся следующие: DLNA, iTunes, Squeezebox, веб-сервер и сервер печати, MySQL-сервер.

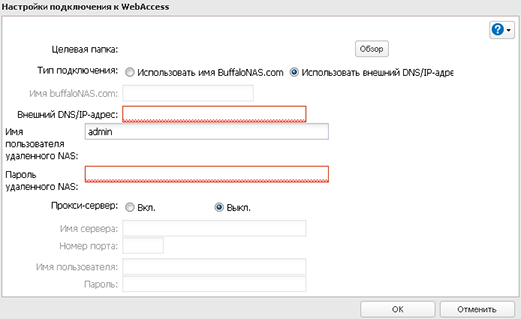

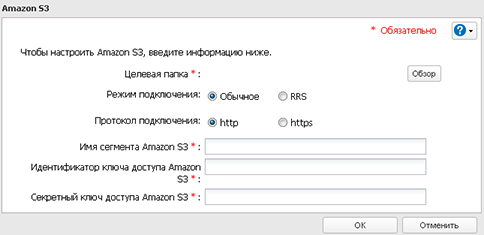

Доступ к хранилищу из удалённой сети можно настроить с помощью меню «Поддержка веб-сервиса».

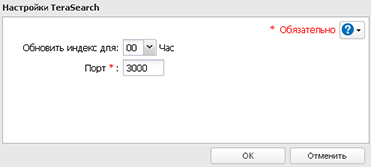

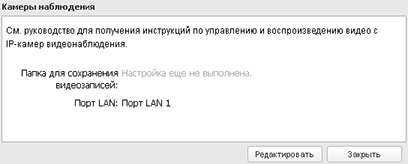

Управление дополнительными приложениями (BitTorrent, TeraSearch) и антивирусным модулем производится в меню «Приложения». Также здесь производится настройка камер видеонаблюдения, которые могут сохранять свои данные в определённом локальном каталоге.

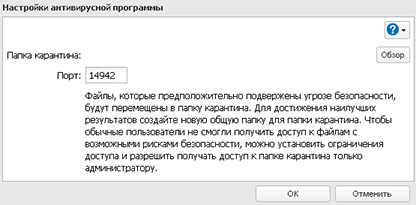

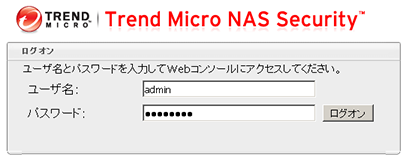

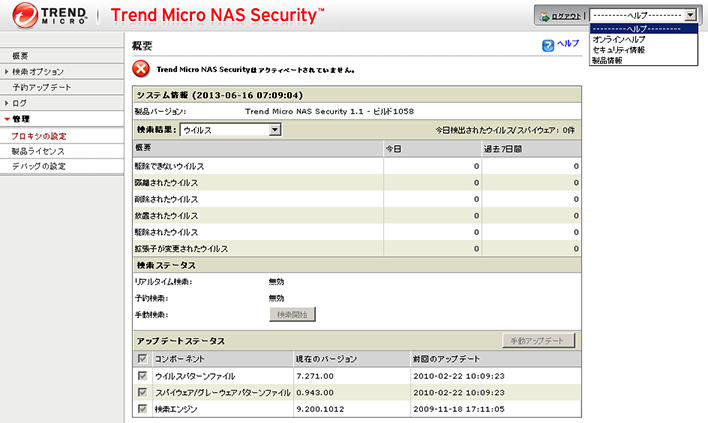

Нам бы хотелось чуть подробнее остановиться на функции антивирусной проверки. Нас очень заинтересовала данная возможность, однако мы так и не смогли её правильно настроить и использовать из-за того, что программное обеспечение TrendMicro NAS Security не имело ни русского, ни даже английского интерфейса. По умолчанию сетевые хранилища TeraStation поставляются с ознакомительной версией антивирусного программного обеспечения, работающего в течение ограниченного периода и не имеющего ни русского, ни английского интерфейсов. При необходимости пользователь TeraStation 5600 может приобрести соответствующую лицензию для полноценного использования дополнительного функционала антивирусного модуля.

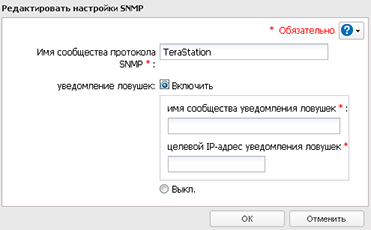

Меню «Сеть» предоставляет администратору возможность изменять IP-адреса интерфейсов, добавлять хранилище в Windows-домен, изменять параметры работы протокола SNMP, выполнять объединение физических интерфейсов, а также устанавливать ограничения для доступа с помощью определённых протоколов через тот или иной сетевой интерфейс.

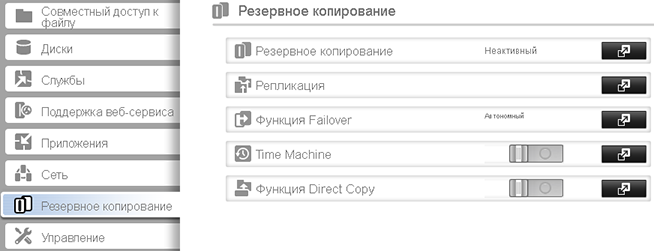

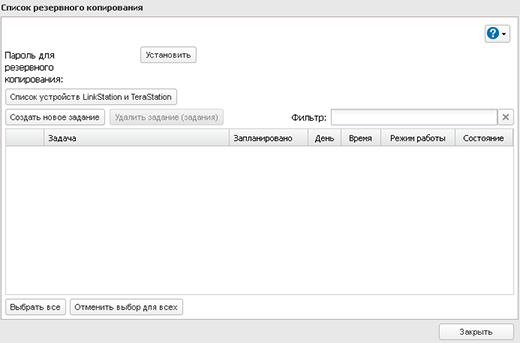

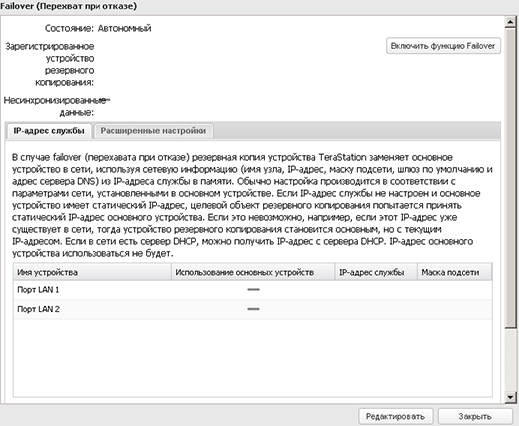

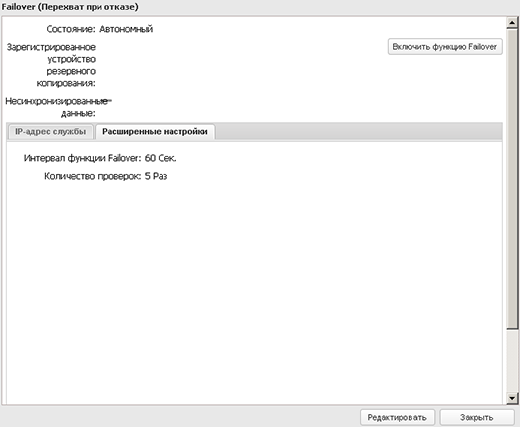

Все настройки, связанные с резервированием пользовательских данных собраны в меню «Резервное копирование». Также здесь можно настроить функцию Failover, позволяющую при наличии двух устройств TeraStation защититься от сбоя одного из них.

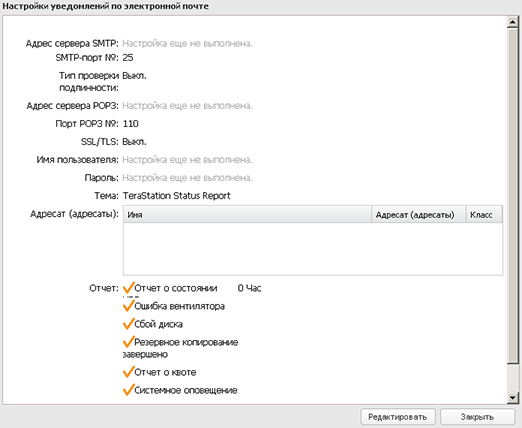

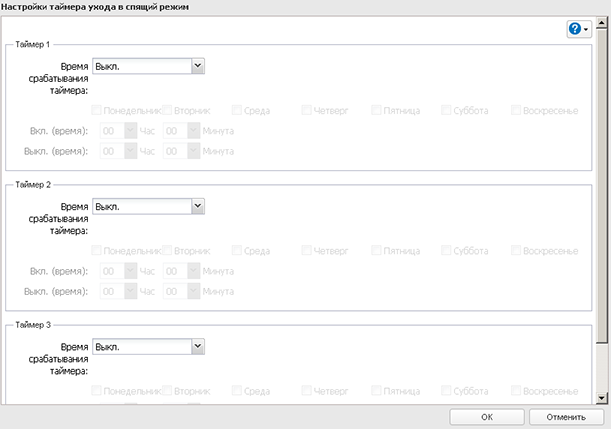

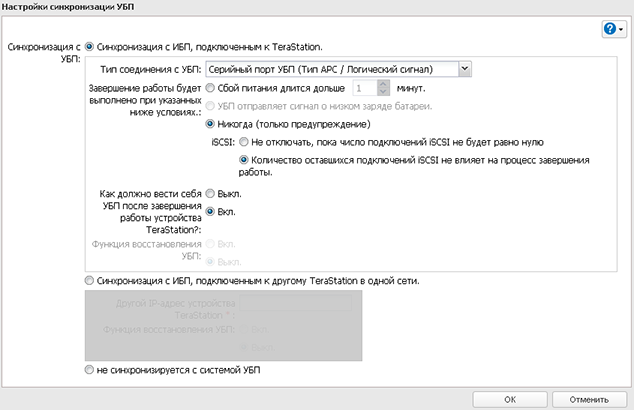

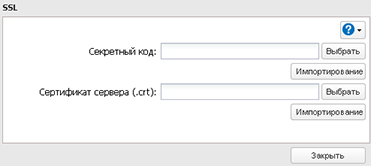

С помощью меню «Управление» администратор может изменять параметры времени и включать синхронизацию с внешними серверами NTP, настраивать рассылку уведомлений по электронной почте, получать доступ к журнальной информации, изменять параметры перехода устройства в спящий режим, следить за состояние ИБП, управлять пользовательскими настройками, выполнять обновление прошивки, а также изменять параметры защищённого доступа к хранилищу.

На этом мы завершаем рассмотрение возможностей веб-интерфейса сетевого хранилища Buffalo TeraStation 5600 и переходим к тестированию.

Тестирование

Первым традиционным тестом, с которого мы обычно начинаем данный раздел, является определение времени загрузки устройства, под которым мы понимаем интервал времени, прошедший с момента подачи питания на устройство до получения первого эхо-ответа по протоколу ICMP. Сетевое хранилище Buffalo TeraStation 5600 загружается за 107 секунд. Мы считаем это приемлемым результатом.

Вторым традиционным тестом стала проверка защищённости устройства, проводимая с помощью сканера сетевой безопасности Positive Techologies XSpider 7.7 (Demo build 3100). Всего было обнаружено 13 открытых портов: TCP-22 (SSH), TCP-80 (HTTP), UDP-137 (NetBIOS Name), TCP-139 (NetBIOS Samba), TCP-443 (HTTP SSL), TCP-445 (Microsoft DS), TCP-548 (afpovertcp), TCP-873 (RSync), TCP-3260 (iscsi-target), TCP-8873 (unknown), TCP-9050 (HTTP), TCP-22939 (unknown) и TCP-33456 (unknown). Наиболее интересные из обнаруженных данных представлены ниже.

Перед началом нагрузочных тестов мы решили предоставить читателям основные параметры нашего тестового стенда.

| Компонент | ПК |

| Материнская плата | ASUS Maximus V Extreme |

| Процессор | Intel Core i7 3770K 3.5 ГГц |

| Оперативная память | DDR3 PC3-10700 SEC 32 Гбайта |

| Сетевая карта | Intel Gigabit CT Desktop Adapter Intel Gigabit 82579V |

| Операционная система | Windows 7 x64 SP1 Rus |

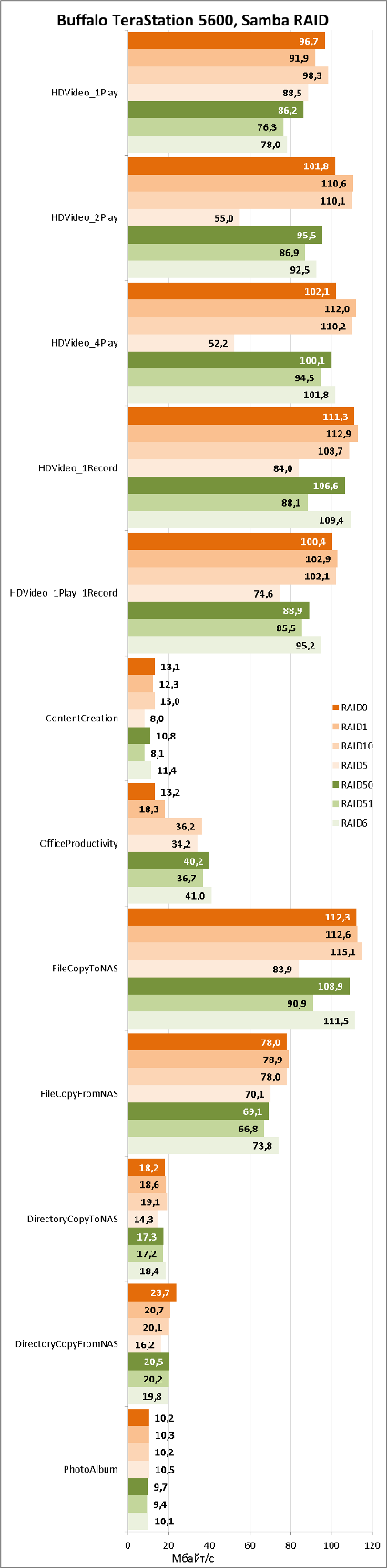

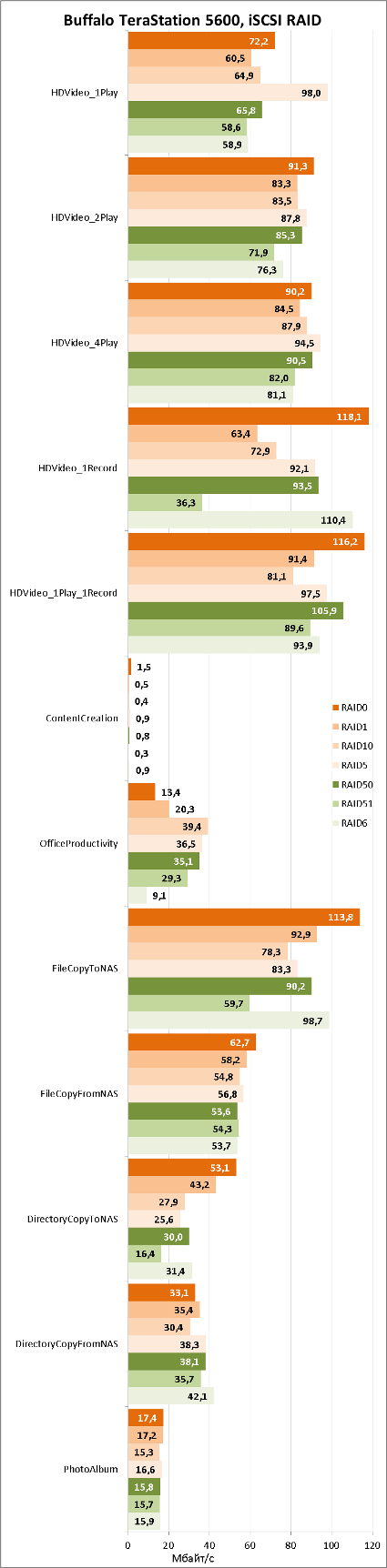

Настала пора, пожалуй, самой ожидаемой части нашего обзора – тестированию производительности сетевого хранилища Buffalo TeraStation 5600. Сначала мы решили измерить скорости доступа к данным, хранящимся на разных RAID-массивах, с помощью протоколов SMB и iSCSI. Измерения проводились с помощью утилиты Intel NASPT 1.7.1.

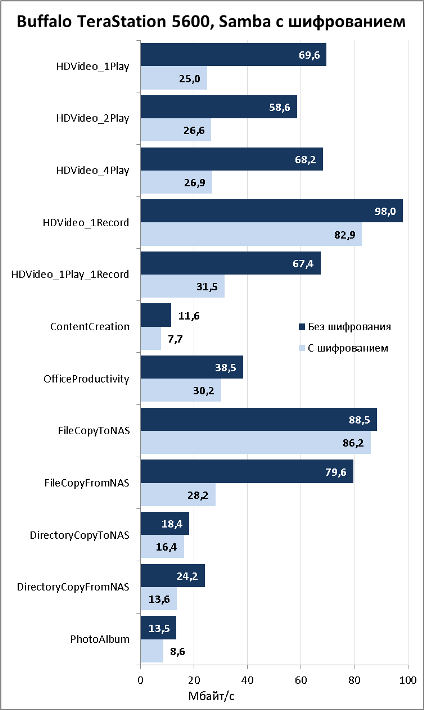

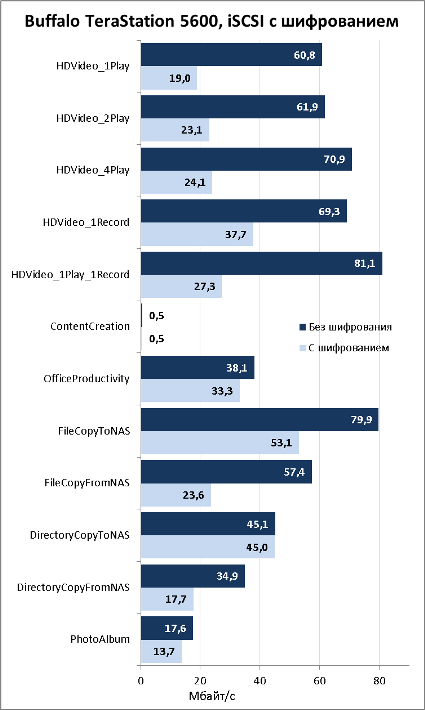

Так как тестируемое сетевое хранилище позволяет шифровать данные, размещённые на жёстких дисках, мы решили установить скорость доступа к зашифрованным данным по тем же протоколам – SMB и iSCSI.

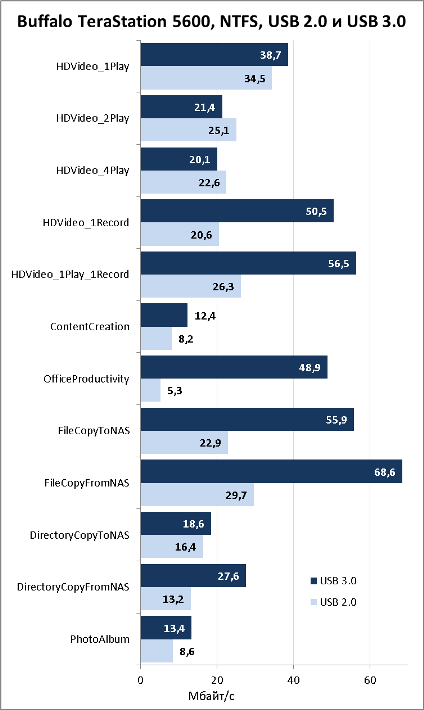

К USB-портам TeraStation 5600 можно подключать внешние жёсткие диски. Мы последовательно подключили наш накопитель Transcend StoreJet 25M3 объёмом 750 Гбайт с разделом, отформатированным в файловую систему NTFS сначала в порт USB 3.0, а затем в USB 2.0. Результаты измерений скорости представлены на диаграмме ниже.

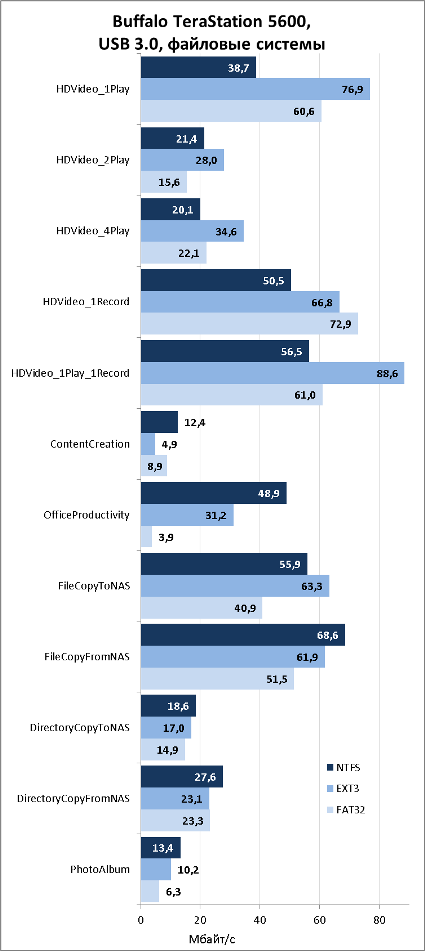

Также мы решили выяснить, как влияет файловая система на скорости доступа к данным, размещённым на внешнем жёстком диске, для чего подключили наш накопитель к порту USB 3.0 и последовательно форматировали его в разные файловые системы.

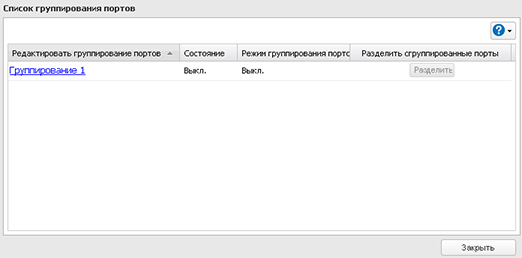

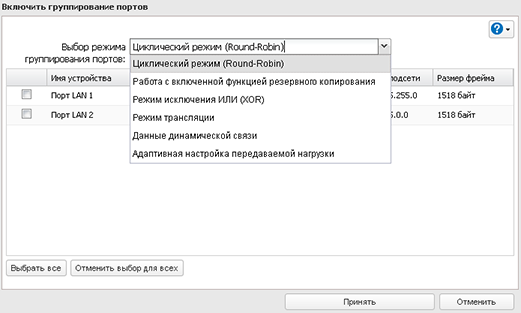

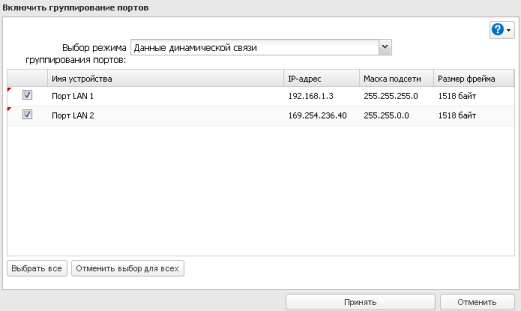

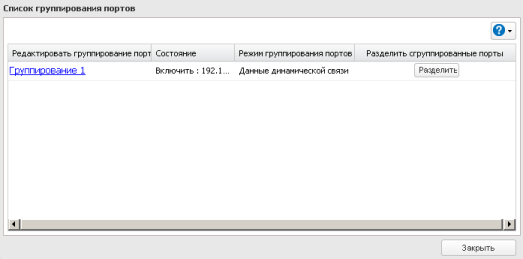

Ещё одним тестом, который мы решили провести с данным сетевым хранилищем, стала проверка работоспособности функции агрегации сетевых интерфейсов. Buffalo TeraStation 5600 оснащён двумя физическими гигабитными интерфейсами, которые могут быть объединены в один логический с полосой пропускания до 4 Гбит/с в режиме полного дуплекса, то есть по 2 Гбит/с в каждую сторону. Мы подключили тестируемое сетевое хранилище обоими интерфейсами к коммутатору Cisco Catalyst 2960, имеющемуся в нашей тестовой лаборатории, и произвели группирование портов на стороне хранилища. В качестве режима объединения был выбран «Данные динамической связи» (Dynamic link aggregation) с использованием протокола LACP. Наверное, это наиболее распространённый способ агрегирования физических интерфейсов. Из русскоязычного названия нам было совершенно не ясно, о каком точно методе агрегирования идёт речь.

Соответствующая настройка потребовалась и со стороны коммутатора. Ниже приведены настройки одного из физических портов, участвующих в агрегации.

interface GigabitEthernet0/1

switchport access vlan 2

switchport mode access

channel-protocol lacp

channel-group 1 mode active

Теперь нам хотелось бы предостеречь наших читателей от необдуманного использования агрегации с помощью LACP, пояснив некоторые принципы его работы. При необходимости передачи кадра через логический интерфейс, построенный с помощью LACP, не происходит разбивки кадра на части, но выбор одного физического канала для отправки. Выбор такого канала производится на основе хеш-таблицы, построенный на базе адресов отправителя, получателя или пары отправителя-получателя. Но что это за адреса? Сетевое хранилище Buffalo TeraStation не позволяет выбрать, какие именно адреса будут использоваться. Для построения хеш-таблицы могут быть использованы MAC-адреса, IP-адреса или же номера портов TCP или UDP.

Соответствующая настройка доступна и на коммутаторе. В зависимости от модели и версии микропрограммного обеспечения используемого коммутатора могут быть доступны те или иные варианты построения хеш-таблицы. Так, например, для имеющегося у нас сетевого устройства Cisco Catalyst 2960 построение хеш-таблицы возможно лишь на основании MAC или IP-адресов.

Switch#sho etherchannel load-balance

EtherChannel Load-Balancing Configuration:

src-dst-ip

EtherChannel Load-Balancing Addresses Used Per-Protocol:

Non-IP: Source XOR Destination MAC address

IPv4: Source XOR Destination IP address

IPv6: Source XOR Destination IP address

Switch(config)#port-channel load-balance ?

dst-ip Dst IP Addr

dst-mac Dst Mac Addr

src-dst-ip Src XOR Dst IP Addr

src-dst-mac Src XOR Dst Mac Addr

src-ip Src IP Addr

src-mac Src Mac Addr

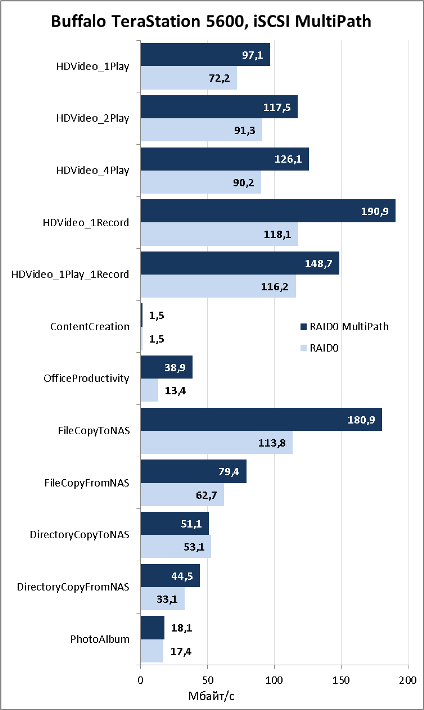

Агрегация канала с использованием протокола LACP обеспечивает статистическую балансировку, то есть она будет хорошо работать при наличии большого количества источников и получателей трафика. Поэтому в следующем тесте мы использовали iSCSI MultiPath, а не агрегацию с помощью LACP, для преодоления возможностей одного физического сетевого интерфейса, чтобы исключить некоторую неопределённость, вносимую агрегацией.

При размещении сетевого хранилища TeraStation 5600 в одной виртуальной сети с конечными пользователями можно использовать балансировку как по MAC-адресам, так и по IP-адресам. Однако если конечные пользователи отделены от хранилища маршрутизатором, то использование балансировки на основе MAC-адресов уже не может быть названо эффективным, так как проходящие через агрегированный канал кадры будут иметь MAC-адреса хранилища и маршрутизатора, то есть всегда будет выбираться один физический интерфейс для передачи. Выяснить, какой физический интерфейс будет выбран коммутатором для передачи реальных пользовательских данных можно с помощью команды test. К сожалению, соответствующей команды на хранилище не предусмотрено.

Switch#test etherchannel load-balance interface port-channel 1 ip 192.168.2.5 192.168.2.3

Would select Gi0/1 of Po1

Мы создали массив RAID0 и решили сравнить скорости доступа к нему по протокол iSCSI в режиме одного пути и с использованием iSCSI MultiPath. Из приведённой ниже диаграммы видно, что на некоторые тесты iSCSI MultiPath оказывает существенное влияние, заметно повышая скорость передачи данных, однако в некоторых других тестах (например, FileCopyFromNAS) прирост скорости не столь значительный, что, вероятно, вызвано уже не ограничениями физического интерфейса.

На этом мы завершаем раздел тестирования и переходим к подведению итогов.

Заключение

Протестированное сетевое хранилище Buffalo TeraStation 5600 продемонстрировало хорошие скорости передачи данных и в целом произвело приятное впечатление, однако ряд ситуаций всё-таки вызвал у нас недоумение. Речь, например, идёт о запрете производителем пользователю самостоятельно заменять жёсткие диски. Нам кажется излишней строгостью подобный запрет, к тому же мы впервые сталкиваемся с подобным ограничением, так как все протестированные нами ранее модели сетевых хранилищ других производителей позволяли устанавливать любые совместимые жёсткие диски.

Сильные стороны Buffalo TeraStation 5600 перечислены ниже.

- Высокие скорости доступа к данным.

- Возможность горячего резервирования всего устройства.

- Использованы крупные вентиляторы.

- Возможность управления как с помощью HTTP, так и с помощью HTTPS.

- Наличие модуля антивирусной проверки (ознакомительная версия).

- Поддержка доменов Windows.

- Возможность опроса как локального, так и удалённого ИБП.

- Поддержка агрегирования сетевых интерфейсов.

- Наличие контекстной справки для каждой страницы веб-интерфейса.

- Поддержка работы в пиринговых сетях.

К сожалению, мы не можем не указать и на обнаруженные недостатки.

- Незначительно расползается русскоязычный веб-интерфейс.

- Неправильные часовые пояса для стран СНГ.

- Не полностью переведён веб-интерфейс.

- Отсутствие поддержки IPv6.

- Длительная процедура обновления прошивки.

- Отсутствие гибкости при выборе жёстких дисков для замены.

На момент написания статьи рекомендованная розничная цена на TeraStation 5600 значительно зависела от модели: TS5600D0606-EU (с шестью дисками по 1 Тбайту) стоила 59290 руб., TS5600D1206-EU (шесть дисков по 2 Тбайта) – 74490 руб., TS5600D1806-EU (шесть дисков по 3 Тбайта) – 88590 руб., TS5600D2406-EU (шесть дисков по 4 Тбайта) – 116990 руб.

Страница 16 из 32